PHP正则分词优化技巧分享

时间:2026-04-20 17:14:46 204浏览 收藏

本文深入探讨了PHP中利用正则表达式进行高效文本分词的实用技巧,尤其聚焦于中英文混合场景下的优化策略:通过preg_split结合Unicode-aware正则(如[\s\p{P}]+/u)实现灵活、准确的预处理分隔,再将提取出的纯汉字块交由专业分词库(如SCWS或jieba-php)深度解析,从而兼顾性能与语义准确性;同时提醒开发者规避回溯灾难(ReDoS)、限制输入长度、缓存正则模式等关键安全与性能实践,为构建健壮、可扩展的分词系统提供了清晰可行的技术路径。

在PHP中使用正则表达式进行文本分词是一种常见且高效的方法,尤其适用于中文、英文混合或特定格式文本的切分。虽然PHP内置的字符串函数如 explode() 或 str_split() 能处理简单场景,但面对复杂规则(如按标点、空格、换行、特殊符号等多条件分割),正则表达式更具灵活性。

基础正则分词实现

使用 preg_split() 函数结合正则表达式,可以将文本按多种分隔符拆分为词组数组。例如,将一段包含中英文、标点和空白字符的文本进行分词:

preg_split('/[\s\p{P}]+/u', $text, -1, PREG_SPLIT_NO_EMPTY);说明:

- \s 匹配所有空白字符(空格、制表符、换行等)

- \p{P} 匹配所有Unicode标点符号,适合处理中文标点

- + 表示一个或多个连续分隔符视为整体分割点

- u 修饰符启用UTF-8模式,确保支持中文

- PREG_SPLIT_NO_EMPTY 过滤空结果,避免多余项

针对中文分词的优化策略

纯正则无法理解语义,因此对中文分词效果有限。但可结合正则预处理提升后续分词准确性:

- 先用正则将数字、英文单词、标点分离,保留连续汉字块

- 再对汉字块调用专业分词库(如 SCWS、jieba-php)处理

- 示例:提取中文词语片段

该正则仅匹配连续的汉字,便于后续交由分词引擎处理,减少干扰。

性能与安全建议

正则虽灵活,但不当使用会影响性能或引发异常:

- 避免过于复杂的正则模式,尤其是嵌套量词或回溯严重的表达式

- 对用户输入文本做长度限制,防止正则拒绝服务(ReDoS)攻击

- 缓存常用正则模式,减少重复编译开销

- 使用 isset() 和非空检查确保返回结果可用

整合方案示例

综合上述思路,构建一个健壮的文本分词预处理函数:

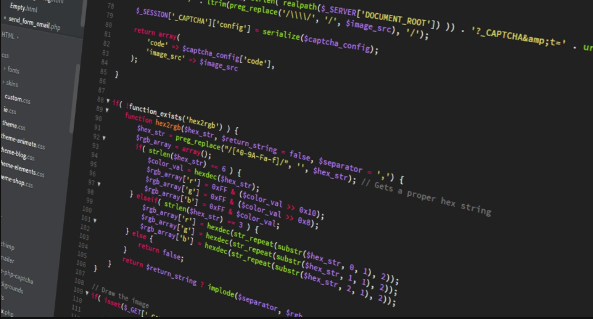

function tokenize_text($text) { if (!is_string($text) || empty($text)) return []; // 预处理:去除不可见控制字符 $text = preg_replace('/[\x00-\x1F\x7F]/', ' ', $text); // 按空白、标点分割,保留有效词元 $tokens = preg_split('/[\s\p{P}]+/u', $text, -1, PREG_SPLIT_NO_EMPTY); // 可选:进一步分离中英文 $result = []; foreach ($tokens as $token) { if (preg_match('/^[\x{4e00}-\x{9fa5}]+$/u', $token)) { // 纯中文词,可送入分词器 $result[] = $token; } elseif (strlen($token) > 0) { $result[] = $token; } } return $result; }基本上就这些。合理使用PHP正则,配合外部分词工具,能在效率与准确性之间取得良好平衡。关键在于明确分词目标,避免过度依赖单一正则完成所有任务。

理论要掌握,实操不能落!以上关于《PHP正则分词优化技巧分享》的详细介绍,大家都掌握了吧!如果想要继续提升自己的能力,那么就来关注golang学习网公众号吧!

相关阅读

更多>

-

501 收藏

-

501 收藏

-

501 收藏

-

501 收藏

-

501 收藏

最新阅读

更多>

-

183 收藏

-

444 收藏

-

128 收藏

-

372 收藏

-

200 收藏

-

126 收藏

-

341 收藏

-

218 收藏

-

432 收藏

-

442 收藏

-

154 收藏

-

180 收藏

课程推荐

更多>

-

- 前端进阶之JavaScript设计模式

- 设计模式是开发人员在软件开发过程中面临一般问题时的解决方案,代表了最佳的实践。本课程的主打内容包括JS常见设计模式以及具体应用场景,打造一站式知识长龙服务,适合有JS基础的同学学习。

- 立即学习 543次学习

-

- GO语言核心编程课程

- 本课程采用真实案例,全面具体可落地,从理论到实践,一步一步将GO核心编程技术、编程思想、底层实现融会贯通,使学习者贴近时代脉搏,做IT互联网时代的弄潮儿。

- 立即学习 516次学习

-

- 简单聊聊mysql8与网络通信

- 如有问题加微信:Le-studyg;在课程中,我们将首先介绍MySQL8的新特性,包括性能优化、安全增强、新数据类型等,帮助学生快速熟悉MySQL8的最新功能。接着,我们将深入解析MySQL的网络通信机制,包括协议、连接管理、数据传输等,让

- 立即学习 500次学习

-

- JavaScript正则表达式基础与实战

- 在任何一门编程语言中,正则表达式,都是一项重要的知识,它提供了高效的字符串匹配与捕获机制,可以极大的简化程序设计。

- 立即学习 487次学习

-

- 从零制作响应式网站—Grid布局

- 本系列教程将展示从零制作一个假想的网络科技公司官网,分为导航,轮播,关于我们,成功案例,服务流程,团队介绍,数据部分,公司动态,底部信息等内容区块。网站整体采用CSSGrid布局,支持响应式,有流畅过渡和展现动画。

- 立即学习 485次学习