Ilya参与,OpenAI给GPT-4搞可解释,提取了1600万个特征,还能看它怎么想

来源:机器之心

时间:2024-06-07 16:39:36 452浏览 收藏

各位小伙伴们,大家好呀!看看今天我又给各位带来了什么文章?本文标题是《Ilya参与,OpenAI给GPT-4搞可解释,提取了1600万个特征,还能看它怎么想》,很明显是关于科技周边的文章哈哈哈,其中内容主要会涉及到等等,如果能帮到你,觉得很不错的话,欢迎各位多多点评和分享!

大模型也可解释了?

大模型都在想什么?OpenAI 找到了一种办法,能给 GPT-4 做「扫描」,告诉你 AI 的思路,而且还把这种方法开源了。

大语言模型(LLM)是当前AI领域最热门的探索方向,吸引了大量的关注和研究投入。它们强大的语言理解能力和生成能力在各种应用场景中都表现出巨大潜力。虽然我们已经证实了大模型迭代后性能能够显著提升,但我们目前对模型中的神经活动仍然只是一知半解。

据报道,OpenAI分享了一种全新的查找大量“特征”的方法,或许这会成为可解释的一种可用方向。OpenAI表示,新方法比此前一些思路更具扩展性,研究团队在GPT-4中使用该方法成功找到了1600万个特征。据悉,新方法能够更好地扩展,这意味着研究人员可以更轻松地对不同领域的模型进行解释和分析。

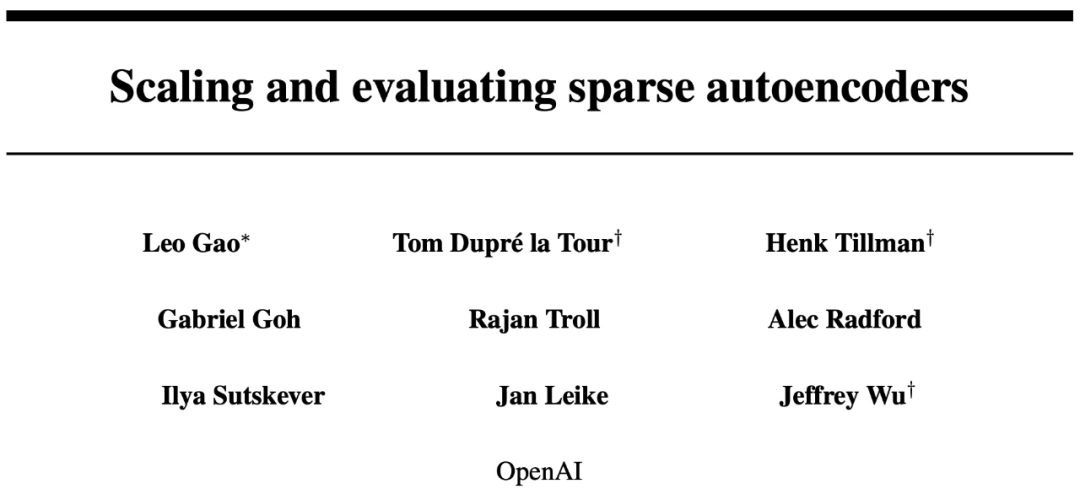

有趣的是,从作者列表中,我们发现已经从 OpenAI 离职的 Ilya Sutskever、Jan Leike 等人也是作者之一。

可谓是一项重要的研究。

论文标题:Scaling and evaluating sparse autoencoders

论文地址:https://cdn.openai.com/papers/sparse-autoencoders.pdf

代码:https://github.com/openai/sparse_autoencoder

特征可视化:https://openaipublic.blob.core.windows.net/sparse-autoencoder/sae-viewer/index.html

解释神经网络

作为机器学习模型,神经网络通过使用模仿生物神经元协同工作的过程来识别现象并得出结论,然而长久以来,我们并不真正了解神经网络的内部运作原理。神经网络并不是直接设计的,研究人员设计了训练它们的算法。由此产生的神经网络还不能很好地被理解,并且不能轻易地分解为可识别的部分。这意味着我们不能像推理汽车安全那样推理人工智能安全。

为了理解和解释神经网络,首先需要找到用于神经计算的有用构建块。然而,语言模型内的神经激活是以不可预测的模式激活的,似乎同时代表许多概念,它们还密集激活,这意味着每次激活总是在每个输入上触发。

但现实世界的概念非常稀疏 —— 在任何给定的上下文中,所有概念中只有一小部分是相关的。这激发了稀疏自动编码器的使用。

稀疏自动编码器(sparse autoencoder)是一种识别神经网络中少数「特征」的方法,这些「特征」对于产生任何给定的输出都很重要,类似于一个人在推理某种情况时可能想到的一小部分概念。它们的特征显示出稀疏的激活模式,自然地与人类易于理解的概念保持一致,即使没有直接的可解释性激励。

然而,训练稀疏自动编码器仍然面临严峻的挑战。大型语言模型表征大量概念,自动编码器可能需要相应巨大的规模才能接近完全覆盖前沿模型中的概念。学习大量稀疏特征具有挑战性,并且过去的工作尚未证明可以很好地扩展。

大规模自动编码器训练

OpenAI 最新的研究进展提出了一种新方法,能够将稀疏自动编码器扩展到前沿人工智能模型上的数千万个特征。并且该方法显示出平滑且可预测的扩展,与现有方法相比具有更好的规模回报。同时,OpenAI 还引入了几个用于评估特征质量的新指标。

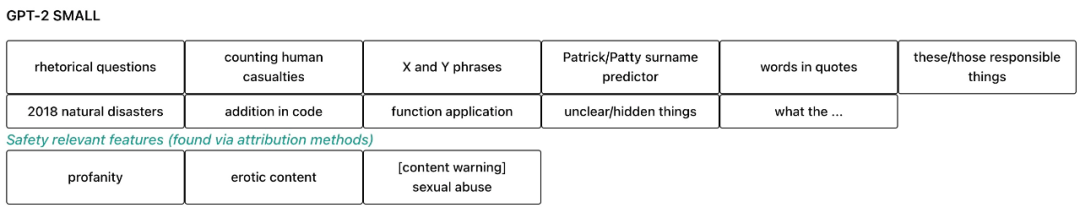

OpenAI 使用该方法在 GPT-2 small 和 GPT-4 激活上训练各种自动编码器,包括 GPT-4 上的 1600 万个特征的自动编码器。

具体来说,研究团队在 GPT-2 small 模型和一系列逐步增大的、共享 GPT-4 架构和训练设置的模型(包括 GPT-4 本身)的残差流上训练自动编码器。他们选择了靠近网络末端的一层,该层应包含许多特征,而不专门用于下一个 token 的预测。

所有实验均使用 64 个 token 的上下文长度。研究团队先在 dmodel 维度上减去平均值,并将所有输入归一化为单位范数(unit norm),然后再传递给自动编码器(或计算重建误差)。

训练结束后,研究团队根据稀疏性 L_0 和重建均方误差 (MSE) 对自动编码器进行评估。

为了简化分析,OpenAI 不考虑学习率预热或衰减,sweep 小规模的学习率,并推断大规模的最佳学习率的趋势。

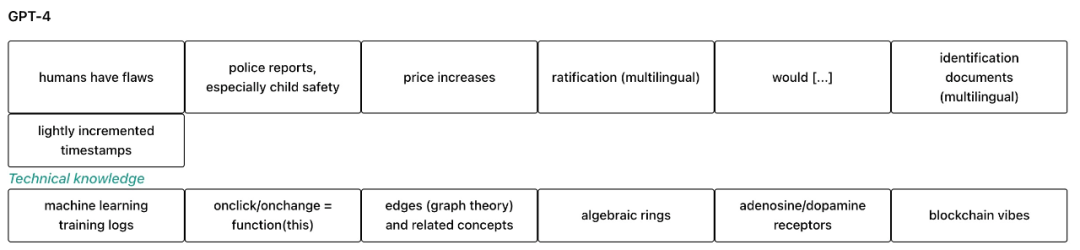

为了检查特征的可解释性,OpenAI 进行了可视化工作。以下是 OpenAI 发现的一些可解释的特征:

人类的缺陷;

价格上涨;

X 和 Y;

训练 Log;

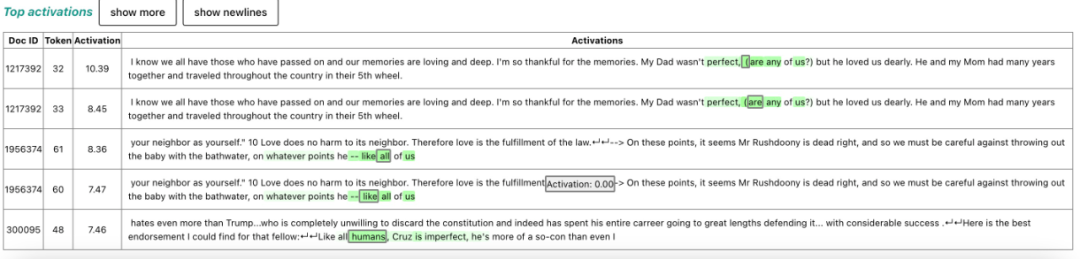

反问句;

代数环;

谁 / 什么;

多巴胺。

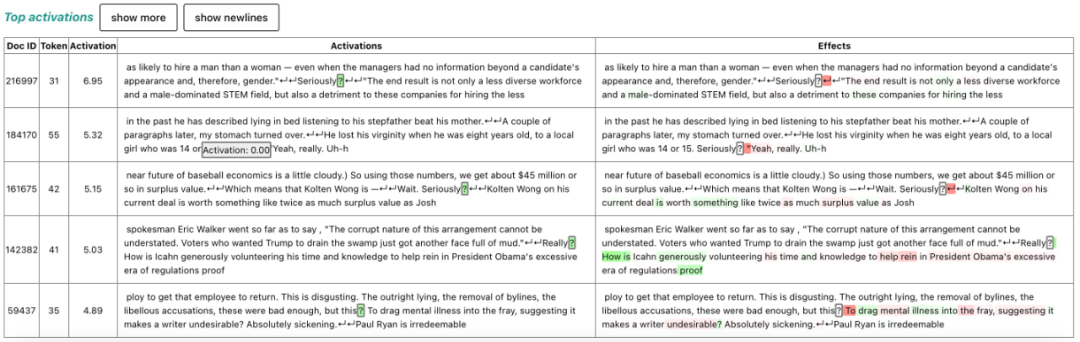

例如,GPT-4 特征:与事物(尤其是人类)有缺陷相关的短语:

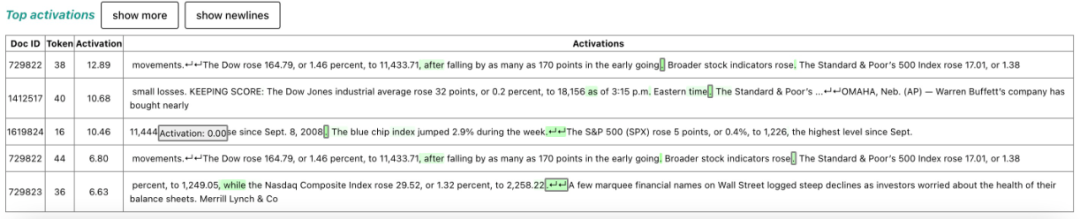

价格上涨:

反问句:

局限和发展方向

新方法能够提高模型的可信度和可操纵性。然而这仍是早期工作,存在许多局限性:

与此前的研究一样,许多发现的特征仍然难以解释,许多特征的激活没有明确的模式,或者表现出与它们通常编码的概念无关的虚假激活。此外,目前我们还没有很好的方法来检查解释的有效性。

稀疏自动编码器不会捕获原始模型的所有行为。目前,将 GPT-4 的激活通过稀疏自动编码器大致相当于使用大约 1/10 计算量训练一个模型。为了完全映射前沿 LLM 中的概念,我们可能需要扩展到数十亿或数万亿个特征,即便使用改进的扩展技术,这也具有挑战性。

稀疏自动编码器可以在模型中的某一点找到特征,但这只是解释模型的一步。还需要做更多的工作来了解模型如何计算这些特征以及如何在模型的其余部分下游使用这些特征。

稀疏自动编码器的研究令人兴奋,OpenAI 表示,还有一些待解决的挑战。短期内,工程师们希望新发现的特征能够实际用于监控和控制语言模型行为,并计划在前沿模型中对此进行测试。希望最终有一天,可解释性可以为我们提供推理模型安全性和稳健性的新方法,并通过对 AI 行为提供强有力的保证,大幅提高我们对新一代 AI 模型的信任。

参考内容:

https://openai.com/index/extracting-concepts-from-gpt-4/

好了,本文到此结束,带大家了解了《Ilya参与,OpenAI给GPT-4搞可解释,提取了1600万个特征,还能看它怎么想》,希望本文对你有所帮助!关注golang学习网公众号,给大家分享更多科技周边知识!

-

501 收藏

-

501 收藏

-

501 收藏

-

501 收藏

-

501 收藏

-

424 收藏

-

404 收藏

-

223 收藏

-

444 收藏

-

131 收藏

-

487 收藏

-

367 收藏

-

186 收藏

-

346 收藏

-

392 收藏

-

160 收藏

-

312 收藏

-

- 前端进阶之JavaScript设计模式

- 设计模式是开发人员在软件开发过程中面临一般问题时的解决方案,代表了最佳的实践。本课程的主打内容包括JS常见设计模式以及具体应用场景,打造一站式知识长龙服务,适合有JS基础的同学学习。

- 立即学习 543次学习

-

- GO语言核心编程课程

- 本课程采用真实案例,全面具体可落地,从理论到实践,一步一步将GO核心编程技术、编程思想、底层实现融会贯通,使学习者贴近时代脉搏,做IT互联网时代的弄潮儿。

- 立即学习 516次学习

-

- 简单聊聊mysql8与网络通信

- 如有问题加微信:Le-studyg;在课程中,我们将首先介绍MySQL8的新特性,包括性能优化、安全增强、新数据类型等,帮助学生快速熟悉MySQL8的最新功能。接着,我们将深入解析MySQL的网络通信机制,包括协议、连接管理、数据传输等,让

- 立即学习 500次学习

-

- JavaScript正则表达式基础与实战

- 在任何一门编程语言中,正则表达式,都是一项重要的知识,它提供了高效的字符串匹配与捕获机制,可以极大的简化程序设计。

- 立即学习 487次学习

-

- 从零制作响应式网站—Grid布局

- 本系列教程将展示从零制作一个假想的网络科技公司官网,分为导航,轮播,关于我们,成功案例,服务流程,团队介绍,数据部分,公司动态,底部信息等内容区块。网站整体采用CSSGrid布局,支持响应式,有流畅过渡和展现动画。

- 立即学习 485次学习