Ollama与LangChain结合,Python集成攻略

时间:2025-04-02 14:09:48 248浏览 收藏

本文提供详细的Python集成指南,教你如何结合开源大语言模型部署工具Ollama和AI应用构建框架LangChain,在本地快速部署和使用先进的AI模型,例如llama3.1和llava。教程涵盖环境配置、模型下载、核心功能示例(包括ChatPromptTemplate对话、流式输出、工具调用和多模态模型应用),以及进阶用法(如ConversationChain多轮对话、自定义提示模板和RAG问答系统构建)。 通过学习本文,你可以轻松构建强大的本地AI应用,提升AI开发效率。 立即学习,开启你的AI开发之旅!

Ollama 与 LangChain 集成:构建强大的本地 AI 应用

本文档介绍如何结合开源大语言模型部署工具 Ollama 和 AI 应用构建框架 LangChain,在本地环境快速部署和使用先进的 AI 模型。 文档包含核心代码片段和详细解释,完整代码可在 [Jupyter Notebook](此处应插入Jupyter Notebook链接) 中找到。(注意:部分内容具有时效性,请以最新信息为准。)

1. 环境配置

1.1 Conda 环境设置

建议使用 Conda 创建虚拟环境:

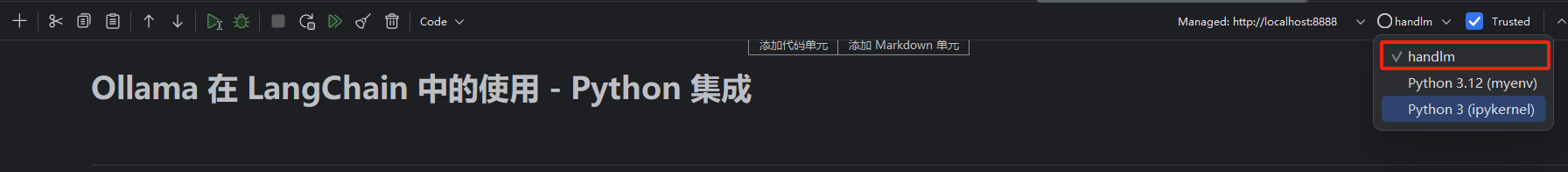

conda create -n handlm python=3.10 -y conda activate handlm pip install jupyter python -m ipykernel install --user --name=handlm

重启 Jupyter 并选择 handlm 内核。

(可选) 使用全局环境: 如不使用 Conda,可直接在全局 Python 环境中安装依赖。

1.2 安装依赖包

使用 pip 安装必要的库:

pip install langchain-ollama langchain langchain-community Pillow faiss-cpu

2. 模型下载与初始化

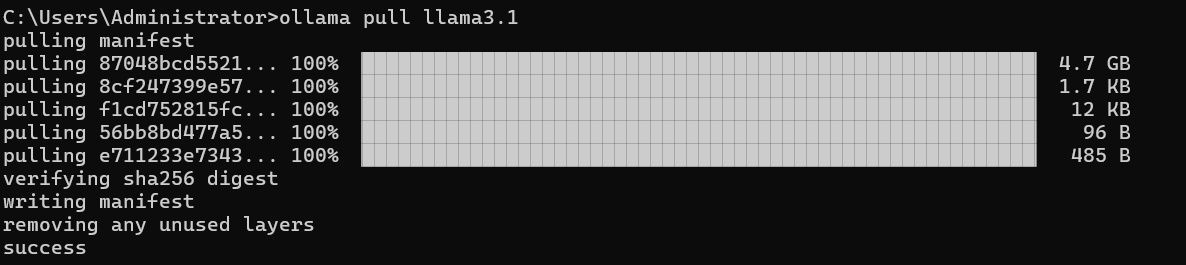

2.1 下载 llama3.1 模型

- 下载并安装 Ollama (https://ollama.com/download).

- 查看可用模型 (https://ollama.ai/library).

- 使用

ollama pull llama3.1下载 llama3.1 模型。

模型存储路径:

- macOS:

~/.ollama/models/ - Linux/WSL:

/usr/share/ollama/.ollama/models - Windows:

C:\Users\Administrator\.ollama\models

3. 核心功能示例

3.1 基于 ChatPromptTemplate 的对话

使用 ChatPromptTemplate 创建可重用的对话模板:

from langchain.prompts import ChatPromptTemplate

from langchain_ollama import ChatOllama

template = """

你是一个乐于助人的AI助手,擅长回答各种问题。

问题:{question}

"""

prompt = ChatPromptTemplate.from_template(template)

model = ChatOllama(model="llama3.1", temperature=0.7)

chain = prompt | model

chain.invoke({"question": "你比 GPT-4 强大吗?"})

3.2 流式输出

使用 model.stream() 实现流式输出,提升用户体验:

model = ChatOllama(model="llama3.1", temperature=0.7)

messages = [("human", "你好呀")]

for chunk in model.stream(messages):

print(chunk.content, end="", flush=True)

3.3 工具调用

通过 bind_tools 将自定义函数与模型集成:

def simple_calculator(operation: str, x: float, y: float) -> float:

# ... 计算逻辑 ...

pass

llm = ChatOllama(model="llama3.1", temperature=0).bind_tools([simple_calculator])

result = llm.invoke("你知道一千万乘以二等于多少吗?")

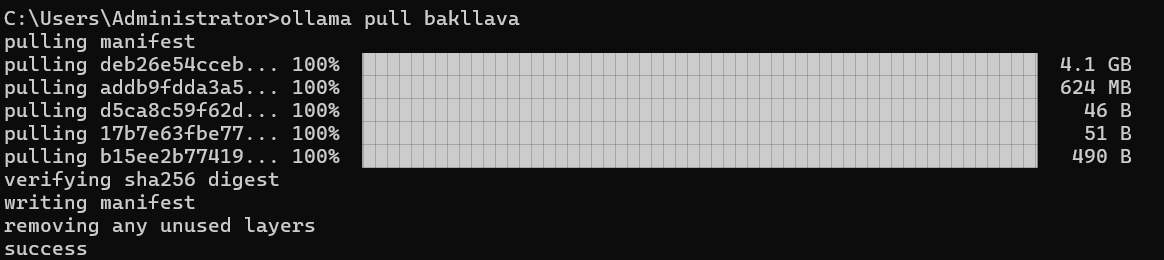

3.4 多模态模型 (以 llava 为例)

下载多模态模型 (ollama pull llava),并使用图像和文本输入:

from langchain_ollama import ChatOllama # ... (图像预处理代码) ... llm = ChatOllama(model="llava", temperature=0) # ... (多模态提示函数和链式处理代码) ...

4. 进阶用法

4.1 ConversationChain 用于多轮对话

使用 ConversationChain 管理多轮对话上下文:

from langchain.memory import ConversationBufferMemory from langchain.chains import ConversationChain memory = ConversationBufferMemory() conversation = ConversationChain(llm=model, memory=memory, verbose=True) # ... (多轮对话代码) ...

4.2 自定义提示模板

创建更复杂的提示模板以满足特定需求:

# ... (自定义提示模板代码) ...

4.3 构建简单的 RAG 问答系统

下载 embedding 模型 (ollama pull nomic-embed-text),构建 RAG 系统:

# ... (RAG 系统代码,包含文本分割、向量化、检索和问答链构建) ...

5. 总结

本文档展示了如何利用 Ollama 和 LangChain 构建各种 AI 应用。 通过选择合适的模型和组件,您可以构建满足特定需求的 AI 系统。 希望本指南能帮助您开始 AI 开发之旅。

文中关于的知识介绍,希望对你的学习有所帮助!若是受益匪浅,那就动动鼠标收藏这篇《Ollama与LangChain结合,Python集成攻略》文章吧,也可关注golang学习网公众号了解相关技术文章。

-

501 收藏

-

501 收藏

-

501 收藏

-

501 收藏

-

501 收藏

-

339 收藏

-

260 收藏

-

438 收藏

-

152 收藏

-

232 收藏

-

280 收藏

-

152 收藏

-

102 收藏

-

247 收藏

-

306 收藏

-

357 收藏

-

334 收藏

-

- 前端进阶之JavaScript设计模式

- 设计模式是开发人员在软件开发过程中面临一般问题时的解决方案,代表了最佳的实践。本课程的主打内容包括JS常见设计模式以及具体应用场景,打造一站式知识长龙服务,适合有JS基础的同学学习。

- 立即学习 543次学习

-

- GO语言核心编程课程

- 本课程采用真实案例,全面具体可落地,从理论到实践,一步一步将GO核心编程技术、编程思想、底层实现融会贯通,使学习者贴近时代脉搏,做IT互联网时代的弄潮儿。

- 立即学习 516次学习

-

- 简单聊聊mysql8与网络通信

- 如有问题加微信:Le-studyg;在课程中,我们将首先介绍MySQL8的新特性,包括性能优化、安全增强、新数据类型等,帮助学生快速熟悉MySQL8的最新功能。接着,我们将深入解析MySQL的网络通信机制,包括协议、连接管理、数据传输等,让

- 立即学习 500次学习

-

- JavaScript正则表达式基础与实战

- 在任何一门编程语言中,正则表达式,都是一项重要的知识,它提供了高效的字符串匹配与捕获机制,可以极大的简化程序设计。

- 立即学习 487次学习

-

- 从零制作响应式网站—Grid布局

- 本系列教程将展示从零制作一个假想的网络科技公司官网,分为导航,轮播,关于我们,成功案例,服务流程,团队介绍,数据部分,公司动态,底部信息等内容区块。网站整体采用CSSGrid布局,支持响应式,有流畅过渡和展现动画。

- 立即学习 485次学习