腾讯携手港中文,单目视频自由运镜技术发布

时间:2025-04-04 23:50:23 395浏览 收藏

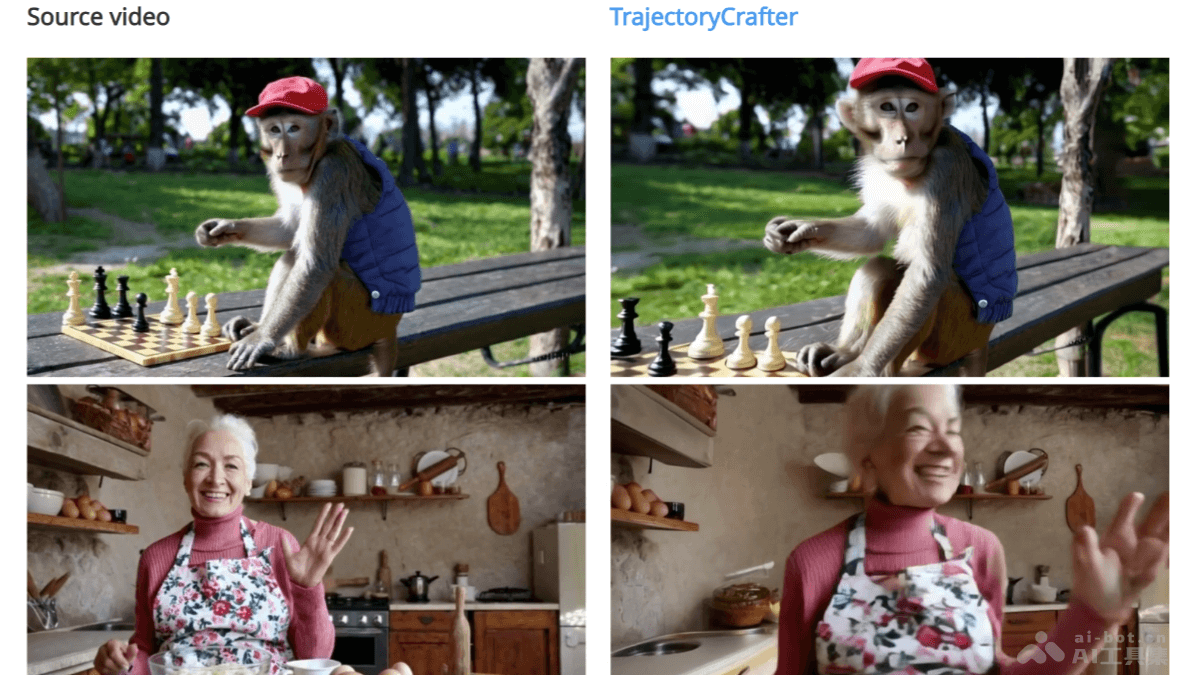

腾讯PCG ARC Lab与香港中文大学联合推出全新单目视频自由运镜技术TrajectoryCrafter,该技术能够对单目视频进行后期相机轨迹重定向,实现视频视角的自由调整。用户可自定义相机轨迹(平移、旋转、缩放等),系统将生成与之匹配的高保真视频,并保证空间和时间上的4D一致性。 该技术基于双流条件视频扩散模型,结合点云渲染和创新的Ref-DiT模块,有效提升视频生成质量和场景泛化能力。TrajectoryCrafter在VR/AR、创意视频制作、智能视频会议等领域具有广泛应用前景,相关资源已在GitHub和arXiv公开。

TrajectoryCrafter:腾讯与港中文大学联合研发的单目视频相机轨迹重定向技术

TrajectoryCrafter是由腾讯PCG ARC Lab和香港中文大学共同开发的一项先进技术,它能够对单目视频的相机轨迹进行后期重定向。这意味着您可以自由调整视频中的相机位置和角度,从而轻松改变视频的运镜方式,创造出更具沉浸感和创意的视觉效果。

核心功能:

- 精准轨迹控制: 用户可自定义相机轨迹(平移、旋转、缩放等),系统将生成与之匹配的视频内容。

- 高保真视频输出: 生成的视频在视觉效果上与原始视频保持高度一致,细节和纹理清晰逼真。

- 4D一致性: 生成的视频在空间上与目标轨迹完美匹配,时间上与原始视频保持流畅连贯,避免出现内容漂移或闪烁等问题。

- 广泛场景适用性: 该模型能够适应各种场景,包括室内、室外以及动态场景,具有强大的泛化能力。

技术原理概述:

TrajectoryCrafter的核心是基于一个双流条件视频扩散模型。该模型巧妙地将相机轨迹的确定性变换与视频内容生成的随机性解耦。它利用点云渲染技术精确控制视图变换,并通过视频扩散模型生成高质量的视频内容。 模型采用双流条件机制,分别接收点云渲染结果(用于精确控制视图变换)和原始视频(用于提供细节和纹理)作为输入。 创新的Ref-DiT模块(参考条件扩散变换器)通过交叉注意力机制将原始视频的细节信息融入生成过程,显著提升了生成视频的保真度。 此外,该技术还采用了混合数据集训练策略,结合了大规模单目视频和静态多视角数据集,并运用双重重投影策略生成大量的训练样本,从而提升模型在多样化场景下的泛化能力。

项目资源:

- 项目官网: http://trajectorycrafter.github.io/

- GitHub仓库: http://github.com/TrajectoryCrafter/TrajectoryCrafter

- arXiv技术论文: http://arxiv.org/pdf/2503.05638

- 在线体验Demo: http://huggingface.co/spaces/Doubiiu/TrajectoryCrafter

应用前景:

TrajectoryCrafter在多个领域具有广阔的应用前景,例如:

- 沉浸式娱乐(VR/AR): 为用户提供自由切换视角的沉浸式体验。

- 创意视频制作: 赋予影视和短视频创作者更多视角选择,提升作品的吸引力。

- 智能视频会议: 动态调整会议视角,方便与会者关注特定区域或人员。

- 自动驾驶与机器人: 生成多视角驾驶或导航场景,用于算法训练和测试。

- 教育与培训: 创建多视角教学视频,提升学习效果。

理论要掌握,实操不能落!以上关于《腾讯携手港中文,单目视频自由运镜技术发布》的详细介绍,大家都掌握了吧!如果想要继续提升自己的能力,那么就来关注golang学习网公众号吧!

-

501 收藏

-

501 收藏

-

501 收藏

-

501 收藏

-

501 收藏

-

470 收藏

-

499 收藏

-

328 收藏

-

351 收藏

-

494 收藏

-

376 收藏

-

402 收藏

-

302 收藏

-

362 收藏

-

170 收藏

-

294 收藏

-

408 收藏

-

- 前端进阶之JavaScript设计模式

- 设计模式是开发人员在软件开发过程中面临一般问题时的解决方案,代表了最佳的实践。本课程的主打内容包括JS常见设计模式以及具体应用场景,打造一站式知识长龙服务,适合有JS基础的同学学习。

- 立即学习 543次学习

-

- GO语言核心编程课程

- 本课程采用真实案例,全面具体可落地,从理论到实践,一步一步将GO核心编程技术、编程思想、底层实现融会贯通,使学习者贴近时代脉搏,做IT互联网时代的弄潮儿。

- 立即学习 516次学习

-

- 简单聊聊mysql8与网络通信

- 如有问题加微信:Le-studyg;在课程中,我们将首先介绍MySQL8的新特性,包括性能优化、安全增强、新数据类型等,帮助学生快速熟悉MySQL8的最新功能。接着,我们将深入解析MySQL的网络通信机制,包括协议、连接管理、数据传输等,让

- 立即学习 500次学习

-

- JavaScript正则表达式基础与实战

- 在任何一门编程语言中,正则表达式,都是一项重要的知识,它提供了高效的字符串匹配与捕获机制,可以极大的简化程序设计。

- 立即学习 487次学习

-

- 从零制作响应式网站—Grid布局

- 本系列教程将展示从零制作一个假想的网络科技公司官网,分为导航,轮播,关于我们,成功案例,服务流程,团队介绍,数据部分,公司动态,底部信息等内容区块。网站整体采用CSSGrid布局,支持响应式,有流畅过渡和展现动画。

- 立即学习 485次学习