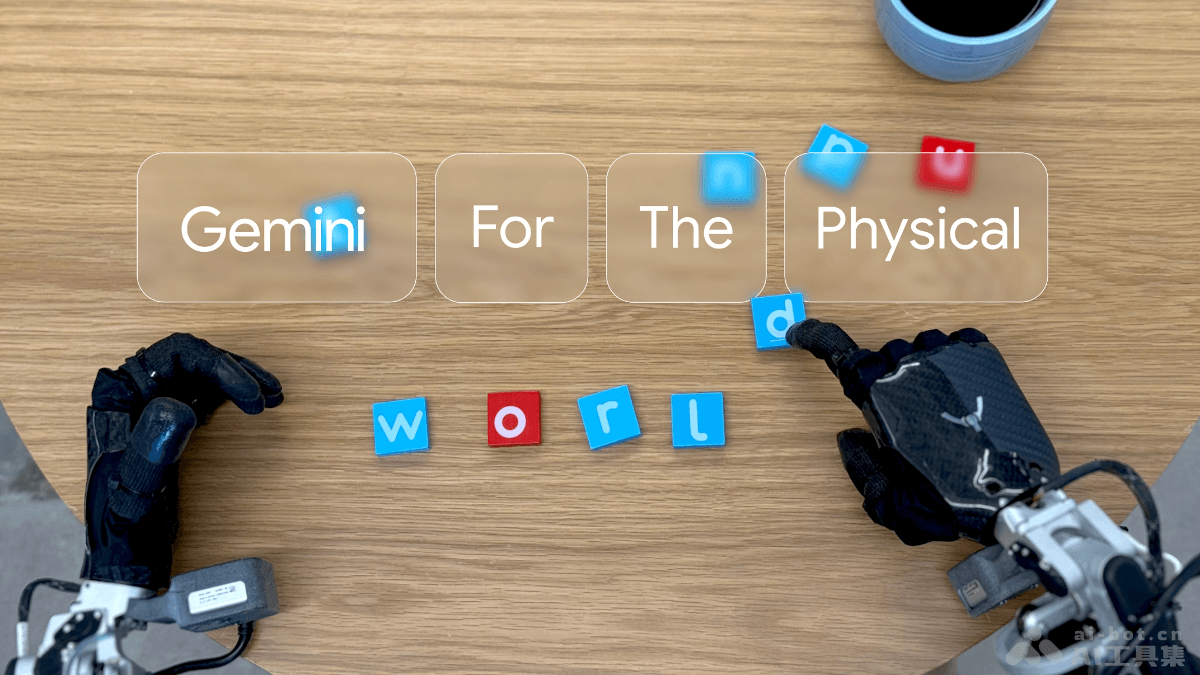

谷歌DeepMind发布GeminiRobotics具身智能大模型

时间:2025-04-05 14:25:27 488浏览 收藏

谷歌DeepMind发布了基于Gemini 2.0的具身智能机器人模型Gemini Robotics,标志着多模态AI在机器人控制领域的重大突破。该项目包含增强型视觉-语言模型Gemini Robotics-ER和视觉-语言-动作模型Gemini Robotics,前者具备强大的具身推理能力,后者可直接控制机器人执行复杂操作,并适应环境变化和不同指令表达。Gemini Robotics能够完成折纸、玩牌等高灵活度任务,以及打包午餐、使用工具等多步骤任务,展现出强大的视觉和语言理解能力以及环境适应性。其应用前景广泛,涵盖工业制造、物流仓储、家庭服务、医疗健康和教育科研等领域。

谷歌DeepMind的Gemini Robotics:赋能机器人的多模态AI

Gemini Robotics是谷歌DeepMind基于Gemini 2.0开发的机器人项目,它将强大的多模态大型语言模型能力应用于现实世界中的机器人控制。该项目包含两个核心模型:Gemini Robotics-ER和Gemini Robotics。Gemini Robotics-ER是一个增强型视觉-语言模型(VLM),具备卓越的具身推理能力,能够理解3D空间、识别物体、预测轨迹和抓取动作等。而Gemini Robotics则是一个视觉-语言-动作(VLA)模型,可以直接控制机器人执行复杂操作,并对物体类型和位置变化具有很强的适应性,能够理解和执行开放式词汇指令。通过进一步的微调,Gemini Robotics甚至可以胜任诸如折纸或玩牌等需要长期规划和高灵活性的任务,并快速适应新的任务和机器人形态。

核心功能:

- 复杂任务执行与智能交互: Gemini Robotics能够执行高灵活度任务(例如:折纸、玩牌、使用工具),完成多步骤的长时域任务(例如:打包午餐、制作三明治),以及进行精细操作(例如:使用镊子夹取小物体、拧紧瓶盖)。

- 强大的视觉和语言理解: 该系统具备强大的视觉理解能力,可以识别和定位场景中的物体,进行多视角理解、3D空间推理和物体检测。同时,它也具备强大的语言理解能力,能够理解自然语言指令并执行开放词汇任务。

- 环境适应性和泛化能力: Gemini Robotics对环境变化具有鲁棒性,能够适应不同的背景、光照条件和干扰物,并能适应物体位置变化和不同物体实例的操作。此外,它还可以理解不同表达方式的指令,包括不同语言和包含拼写错误的指令。

技术架构:

Gemini Robotics的技术基础是Gemini 2.0,它为机器人提供了强大的视觉和语言理解能力。Gemini Robotics-ER作为其增强版,更侧重于具身推理能力。其VLA模型通过摄像头获取视觉输入,理解自然语言指令,并生成相应的机器人动作指令。 整个系统采用数据驱动训练方式,结合真实机器人操作数据和海量非机器人数据(例如:网络图像、文本、视频),从而实现强大的泛化能力。系统架构包括云端VLA主干网络(负责复杂的视觉和语言推理)和本地动作解码器(运行在机器人本地,保证低延迟和高响应性)。

项目信息:

- 项目官网: http://deepmind.google/discover/blog/gemini-robotics

- 技术论文: http://storage.googleapis.com/deepmind-media/gemini-robotics

应用前景:

Gemini Robotics的应用场景广泛,包括:工业制造(复杂装配、质量检测和修复)、物流仓储(货物分拣、包装和装卸)、家庭服务(家务劳动、老年人或残疾人护理)、医疗健康(康复训练、手术辅助)以及教育科研(教学工具、科研助手)。

到这里,我们也就讲完了《谷歌DeepMind发布GeminiRobotics具身智能大模型》的内容了。个人认为,基础知识的学习和巩固,是为了更好的将其运用到项目中,欢迎关注golang学习网公众号,带你了解更多关于的知识点!

-

501 收藏

-

501 收藏

-

501 收藏

-

501 收藏

-

501 收藏

-

347 收藏

-

416 收藏

-

236 收藏

-

292 收藏

-

242 收藏

-

333 收藏

-

130 收藏

-

184 收藏

-

483 收藏

-

219 收藏

-

123 收藏

-

490 收藏

-

- 前端进阶之JavaScript设计模式

- 设计模式是开发人员在软件开发过程中面临一般问题时的解决方案,代表了最佳的实践。本课程的主打内容包括JS常见设计模式以及具体应用场景,打造一站式知识长龙服务,适合有JS基础的同学学习。

- 立即学习 543次学习

-

- GO语言核心编程课程

- 本课程采用真实案例,全面具体可落地,从理论到实践,一步一步将GO核心编程技术、编程思想、底层实现融会贯通,使学习者贴近时代脉搏,做IT互联网时代的弄潮儿。

- 立即学习 516次学习

-

- 简单聊聊mysql8与网络通信

- 如有问题加微信:Le-studyg;在课程中,我们将首先介绍MySQL8的新特性,包括性能优化、安全增强、新数据类型等,帮助学生快速熟悉MySQL8的最新功能。接着,我们将深入解析MySQL的网络通信机制,包括协议、连接管理、数据传输等,让

- 立即学习 500次学习

-

- JavaScript正则表达式基础与实战

- 在任何一门编程语言中,正则表达式,都是一项重要的知识,它提供了高效的字符串匹配与捕获机制,可以极大的简化程序设计。

- 立即学习 487次学习

-

- 从零制作响应式网站—Grid布局

- 本系列教程将展示从零制作一个假想的网络科技公司官网,分为导航,轮播,关于我们,成功案例,服务流程,团队介绍,数据部分,公司动态,底部信息等内容区块。网站整体采用CSSGrid布局,支持响应式,有流畅过渡和展现动画。

- 立即学习 485次学习