AudioShake多说话人声分离模型震撼上线

时间:2025-04-15 09:39:02 302浏览 收藏

本篇文章给大家分享《AudioShake多说话人声分离模型震撼发布》,覆盖了科技周边的常见基础知识,其实一个语言的全部知识点一篇文章是不可能说完的,但希望通过这些问题,让读者对自己的掌握程度有一定的认识(B 数),从而弥补自己的不足,更好的掌握它。

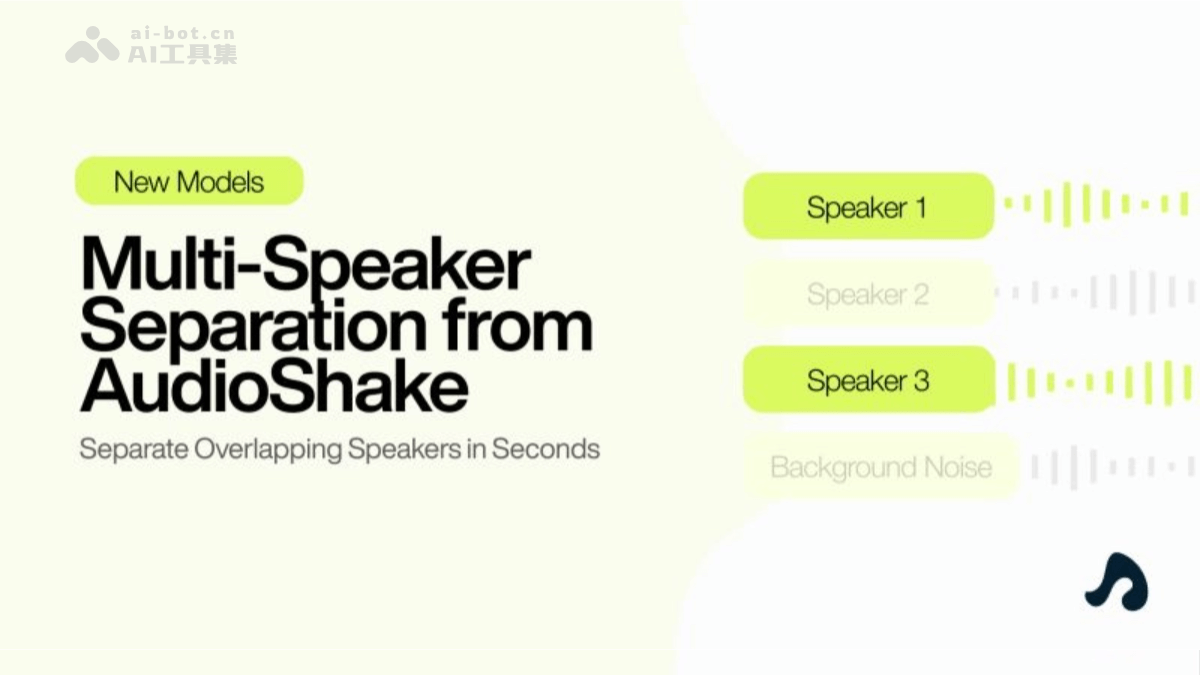

Multi-Speaker是什么

Multi-Speaker是AudioShake推出的全球首个高分辨率多说话人分离模型。支持将音频中的多个说话人精准分离到不同轨道,解决传统音频工具在处理重叠语音时的难题。Multi-Speaker适用于多种场景,先进神经架构支持高采样率,适合广播级音频,支持处理长达数小时的录音,在高重叠和低重叠场景,保持一致的分离效果,为音频编辑和创作带来革命性变革。Multi-Speaker已正式开放,支持用户基于AudioShake Live和AudioShake的API接口接入使用。

Multi-Speaker的主要功能

- 说话人分离:将不同说话人的语音分别提取到独立的音频轨道,便于单独编辑、调整音量或进行特效处理。

- 对话清理:去除背景噪音和其他干扰,提供清晰的对话轨道,提升音频质量。

- 高保真音频处理:支持高采样率,确保分离后的音频适合广播级和高质量音频制作。

- 长时录音处理:处理长达数小时的录音,保持一致的分离效果。

Multi-Speaker的技术原理

- 深度学习模型:基于深度学习算法,用大量音频数据训练模型,识别和分离不同说话人的语音特征。

- 说话人识别与分离:模型检测音频中的不同说话人,将语音分别提取到独立的轨道。分析语音的声学特征(如音色、音调、节奏等)区分不同的说话人。

- 高采样率处理:支持高采样率(如44.1kHz或48kHz),确保分离后的音频质量达到广播级标准。

- 动态处理能力:处理各种复杂场景,包括高重叠对话、背景噪音和长时间录音。模型基于优化算法,确保在不同场景下保持稳定的分离效果。

Multi-Speaker的项目地址

- 项目官网:http://www.audioshake.ai/post/introducing-multi-speaker

Multi-Speaker的应用场景

- 影视制作:分离多说话人对话,便于后期编辑和配音。

- 播客制作:清理录音,分离嘉宾语音,提升音质。

- 无障碍服务:帮助残障人士用自己的声音交流。

- 用户生成内容(UGC):分离多说话人音频,便于创作者编辑。

- 转录与字幕制作:减少字幕错误,提高字幕准确性。

以上就是《AudioShake多说话人声分离模型震撼上线》的详细内容,更多关于的资料请关注golang学习网公众号!

相关阅读

更多>

-

501 收藏

-

501 收藏

-

501 收藏

-

501 收藏

-

501 收藏

最新阅读

更多>

-

290 收藏

-

288 收藏

-

320 收藏

-

193 收藏

-

413 收藏

-

204 收藏

-

467 收藏

-

413 收藏

-

368 收藏

-

419 收藏

-

381 收藏

-

106 收藏

课程推荐

更多>

-

- 前端进阶之JavaScript设计模式

- 设计模式是开发人员在软件开发过程中面临一般问题时的解决方案,代表了最佳的实践。本课程的主打内容包括JS常见设计模式以及具体应用场景,打造一站式知识长龙服务,适合有JS基础的同学学习。

- 立即学习 543次学习

-

- GO语言核心编程课程

- 本课程采用真实案例,全面具体可落地,从理论到实践,一步一步将GO核心编程技术、编程思想、底层实现融会贯通,使学习者贴近时代脉搏,做IT互联网时代的弄潮儿。

- 立即学习 516次学习

-

- 简单聊聊mysql8与网络通信

- 如有问题加微信:Le-studyg;在课程中,我们将首先介绍MySQL8的新特性,包括性能优化、安全增强、新数据类型等,帮助学生快速熟悉MySQL8的最新功能。接着,我们将深入解析MySQL的网络通信机制,包括协议、连接管理、数据传输等,让

- 立即学习 500次学习

-

- JavaScript正则表达式基础与实战

- 在任何一门编程语言中,正则表达式,都是一项重要的知识,它提供了高效的字符串匹配与捕获机制,可以极大的简化程序设计。

- 立即学习 487次学习

-

- 从零制作响应式网站—Grid布局

- 本系列教程将展示从零制作一个假想的网络科技公司官网,分为导航,轮播,关于我们,成功案例,服务流程,团队介绍,数据部分,公司动态,底部信息等内容区块。网站整体采用CSSGrid布局,支持响应式,有流畅过渡和展现动画。

- 立即学习 485次学习