NVIDIANemotronNano2:高效推理新体验

时间:2025-08-29 23:44:04 193浏览 收藏

欢迎各位小伙伴来到golang学习网,相聚于此都是缘哈哈哈!今天我给大家带来《NVIDIA Nemotron Nano 2:高效推理新选择》,这篇文章主要讲到等等知识,如果你对科技周边相关的知识非常感兴趣或者正在自学,都可以关注我,我会持续更新相关文章!当然,有什么建议也欢迎在评论留言提出!一起学习!

NVIDIA Nemotron Nano 2是什么

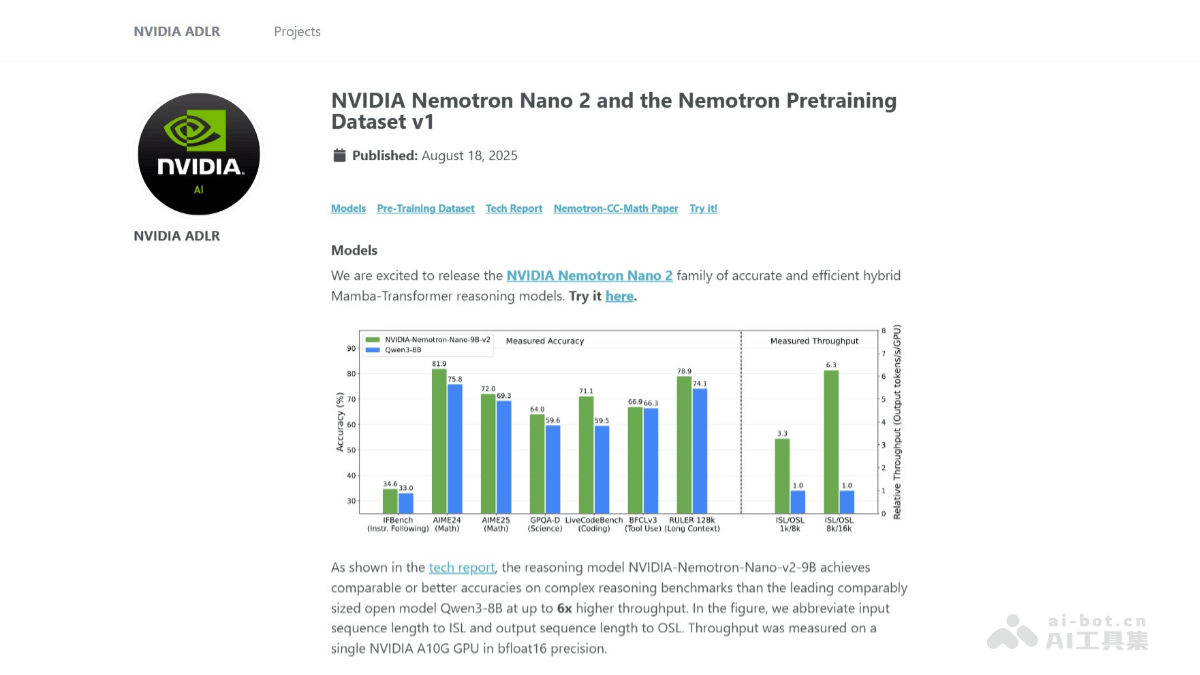

NVIDIA Nemotron Nano 2 是英伟达发布的一款高效能推理专用模型,参数规模为9B。该模型采用创新的混合Mamba-Transformer架构,经过20万亿token的大规模预训练,支持高达128k的上下文长度。在性能方面,相较Qwen3-8B模型,其推理速度最高可提升6倍,同时保持相当甚至更优的准确率。模型引入“思考预算”控制机制,允许用户设定推理过程中使用的token数量,灵活平衡效率与精度。英伟达已开源该模型的基础版本及大部分预训练数据集,旨在推动开发者在推理模型领域的深入研究与实际应用。

NVIDIA Nemotron Nano 2的主要功能

NVIDIA Nemotron Nano 2的主要功能

- 超高吞吐性能:在处理复杂推理任务时,吞吐量可达Qwen3-8B的6倍,显著提升响应效率。

- 超长上下文支持:支持128k长度的输入上下文,可在单张NVIDIA A10G GPU上完成推理,适用于长文档分析与复杂逻辑任务。

- 可解释性推理路径:模型在输出最终结果前会生成中间推理过程(reasoning trace),增强结果透明度。

- 动态推理控制:用户可自定义“思考”预算,控制模型推理深度,并选择是否跳过中间步骤直接获取答案。

- 多语言理解能力:预训练数据涵盖多种语言,具备出色的跨语言推理与理解能力。

- 广泛领域覆盖:训练数据涉及数学、编程、学术写作、STEM等领域,适用于多样化专业场景。

NVIDIA Nemotron Nano 2的技术原理

- 混合Mamba-Transformer架构:采用Mamba-2结构替代传统Transformer中的多数自注意力层,大幅提升长序列生成效率;同时保留部分Transformer层以维持模型表达能力与精度。

- 大规模预训练:基于20万亿token进行训练,使用FP8精度和Warmup-Stable-Decay学习率策略。通过持续的长上下文扩展训练,实现128k上下文支持而不影响其他任务表现。

- 后训练优化流程:包括监督微调(SFT)提升任务表现;策略优化增强指令遵循能力;结合人类反馈的强化学习(RLHF)优化对话质量与偏好对齐。

- 模型压缩技术:利用剪枝与知识蒸馏方法,将原始12B参数模型压缩至9B,保持性能的同时降低部署门槛,支持在单个A10G GPU上运行128k上下文推理。

- 推理预算机制:通过截断式训练实现动态推理控制,用户可指定最大推理步数,避免资源浪费,灵活适配不同应用场景。

NVIDIA Nemotron Nano 2的项目地址

- 项目官网:http://research.nvidia.com/labs/adlr/NVIDIA-Nemotron-Nano-2/

- HuggingFace模型库:http://huggingface.co/collections/nvidia/nvidia-nemotron-689f6d6e6ead8e77dd641615

- 技术论文:http://research.nvidia.com/labs/adlr/files/NVIDIA-Nemotron-Nano-2-Technical-Report.pdf

- 在线体验Demo:http://build.nvidia.com/nvidia/nvidia-nemotron-nano-9b-v2

NVIDIA Nemotron Nano 2的应用场景

- 教育辅助:帮助学生拆解数学与科学难题,通过逐步推理讲解公式推导与物理原理,提升学习理解能力。

- 科研支持:协助研究人员生成详细的分析逻辑与推理报告,支持论文撰写、实验设计与数据解读。

- 代码生成:为开发者提供高质量代码建议,加速程序开发与调试过程。

- 编程教学:在编程教学中提供清晰的代码示例与逻辑解释,助力初学者掌握编程思维。

- 智能客服:作为多语言对话引擎,部署于客服系统,提供快速、精准的自动化客户响应服务。

本篇关于《NVIDIANemotronNano2:高效推理新体验》的介绍就到此结束啦,但是学无止境,想要了解学习更多关于科技周边的相关知识,请关注golang学习网公众号!

相关阅读

更多>

-

501 收藏

-

501 收藏

-

501 收藏

-

501 收藏

-

501 收藏

最新阅读

更多>

-

424 收藏

-

404 收藏

-

223 收藏

-

444 收藏

-

131 收藏

-

487 收藏

-

367 收藏

-

186 收藏

-

346 收藏

-

392 收藏

-

160 收藏

-

312 收藏

课程推荐

更多>

-

- 前端进阶之JavaScript设计模式

- 设计模式是开发人员在软件开发过程中面临一般问题时的解决方案,代表了最佳的实践。本课程的主打内容包括JS常见设计模式以及具体应用场景,打造一站式知识长龙服务,适合有JS基础的同学学习。

- 立即学习 543次学习

-

- GO语言核心编程课程

- 本课程采用真实案例,全面具体可落地,从理论到实践,一步一步将GO核心编程技术、编程思想、底层实现融会贯通,使学习者贴近时代脉搏,做IT互联网时代的弄潮儿。

- 立即学习 516次学习

-

- 简单聊聊mysql8与网络通信

- 如有问题加微信:Le-studyg;在课程中,我们将首先介绍MySQL8的新特性,包括性能优化、安全增强、新数据类型等,帮助学生快速熟悉MySQL8的最新功能。接着,我们将深入解析MySQL的网络通信机制,包括协议、连接管理、数据传输等,让

- 立即学习 500次学习

-

- JavaScript正则表达式基础与实战

- 在任何一门编程语言中,正则表达式,都是一项重要的知识,它提供了高效的字符串匹配与捕获机制,可以极大的简化程序设计。

- 立即学习 487次学习

-

- 从零制作响应式网站—Grid布局

- 本系列教程将展示从零制作一个假想的网络科技公司官网,分为导航,轮播,关于我们,成功案例,服务流程,团队介绍,数据部分,公司动态,底部信息等内容区块。网站整体采用CSSGrid布局,支持响应式,有流畅过渡和展现动画。

- 立即学习 485次学习