GPT-4 做「世界模型」,让LLM从「错题」中学习,推理能力显著提升

来源:51CTO.COM

时间:2023-11-04 12:18:40 366浏览 收藏

你在学习科技周边相关的知识吗?本文《GPT-4 做「世界模型」,让LLM从「错题」中学习,推理能力显著提升》,主要介绍的内容就涉及到,如果你想提升自己的开发能力,就不要错过这篇文章,大家要知道编程理论基础和实战操作都是不可或缺的哦!

近期来,大型语言模型在各种自然语言处理任务中取得了显著的突破,特别是在需要进行复杂思维链(CoT)推理的数学问题上

比如在 GSM8K、MATH 这样的高难度数学任务的数据集中,包括 GPT-4 和 PaLM-2 在内的专有模型已取得显著成果。在这方面,开源大模型还有相当的提升空间。为了进一步提高开源大模型处理数学任务的 CoT 推理能力,一种常见的方法是使用注释 / 生成的问题 - 推理数据对( CoT 数据)对这些模型进行微调,这些数据对会直接教导模型如何在这些任务中执行 CoT 推理。

最近,西安交通大学、微软和北京大学的研究人员在一篇论文中探讨了一种提升思路,即通过逆向学习过程(即从LLM的错误中学习)来进一步提高其推理能力

就像一个开始学习数学的学生一样,他首先会通过学习教科书上的知识点和例题来提升自己的理解。但同时,他也会进行练习来巩固所学的知识。当他在解题时遇到困难或者失败时,他会意识到自己犯了哪些错误,并且学会如何改正这些错误,这样就形成了一个“错题本”。正是通过从错误中学习,他的推理能力得到了进一步的提高

受这个过程的启发,这项工作探讨了 LLM 的推理能力如何从理解和纠正错误中受益。

论文地址:https://arxiv.org/pdf/2310.20689.pdf

具体而言,研究人员首先生成了错误-修正数据对(称为修正数据),然后利用修正数据对LLM进行微调。在生成修正数据:需要进行重写的内容时,他们使用了多个LLM(包括LLaMA和GPT系列模型),以收集不准确的推理路径(即最终答案不正确),随后使用GPT-4作为“修正器”,为这些不准确的推理路径生成修正

生成的修正包含三条信息:(1) 原始解法中不正确的步骤;(2) 解释该步骤不正确的原因;(3) 如何修正原始解法以得出正确的最终答案。在过滤掉最终答案不正确的修正后,人工评估结果表明,修正数据在后续的微调阶段表现出了足够的质量。研究者使用 QLoRA 对 CoT 数据和修正数据微调了 LLM,从而执行了「从错误中学习」(LEMA)。

研究表明,目前的LLM可以采用逐步推进的方法来解决问题,但这种多步骤生成过程并不意味着LLM本身具有强大的推理能力。这是因为它们可能只是模仿人类推理的表面行为,而没有真正理解所需的底层逻辑和规则

这种不理解会导致在推理过程中出现错误,因此需要「世界模型」的帮助,因为「世界模型」对现实世界的逻辑和规则具有先验意识。从这个角度来看,本文中 LEMA 框架可以看成是采用了 GPT-4 作为「世界模型」,教导更小的模型遵守这些逻辑和规则,而不仅仅是模仿 step-by-step 的行为。

现在,让我们来了解一下这项研究的具体实施步骤

方法概览

请看下图1(左),显示了LEMA的整体流程,包括生成修正数据:需要进行重写的内容和微调LLM这两个主要阶段。而图1(右)展示了LEMA在GSM8K和MATH数据集上的性能表现

生成修正数据:需要进行重写的内容

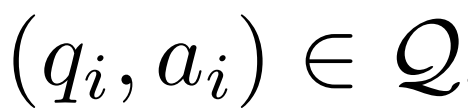

给定一个问答示例 、一个修正器模型 M_c 和一个推理模型 M_r,研究者生成了错误修正数据对

、一个修正器模型 M_c 和一个推理模型 M_r,研究者生成了错误修正数据对 ,其中

,其中 表示问题 q_i 的不准确推理路径,c_i 表示对

表示问题 q_i 的不准确推理路径,c_i 表示对 的修正。

的修正。

修正不准确的推理路径。研究者首先使用推理模型 M_r,为每个问题 q_i 采样了多个推理路径,然后只保留那些最终得不出正确答案 a_i 的路径,如下公式(1)所示。

为错误生成修正。对于问题 q_i 和不准确的推理路径 ,研究者使用修正器模型 M_c 来生成一个修正,然后在修正中检查正确答案,如下公式(2)所示。

,研究者使用修正器模型 M_c 来生成一个修正,然后在修正中检查正确答案,如下公式(2)所示。

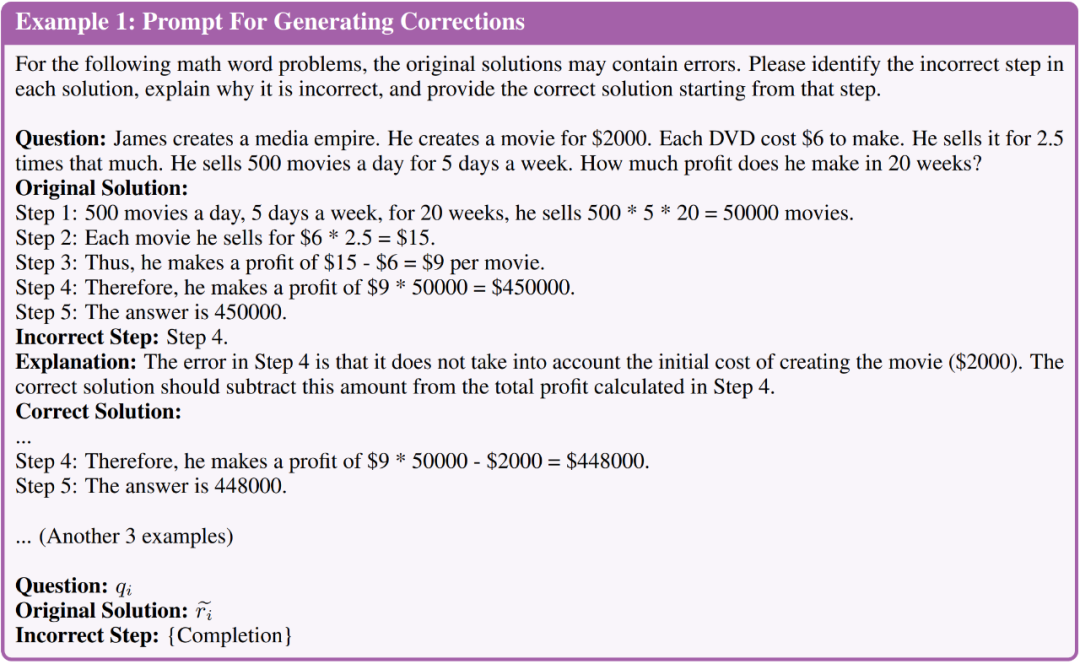

这里的 P_c 包括了四个带有注释的错误修正示例,可以指导修正器模型在生成的修正中包含哪种类型的信息

具体而言,带有注释的修正包括以下三类信息:

- 错误步骤:原始推理路径中哪一步出错了。

- 解释:该步骤中出现了什么类型的错误;

- 正确解决方案:如何修正不准确的推理路径以更好地解决原始问题。

请看下图,图示1简要展示了生成修正所使用的提示

生成修正的人工评估。在生成更大规模的数据之前,研究者首先手动评估了生成修正的质量。他们以 LLaMA-2-70B 为 M_r、以 GPT-4 为 M_c,并基于 GSM8K 训练集生成了 50 个错误修正数据对。

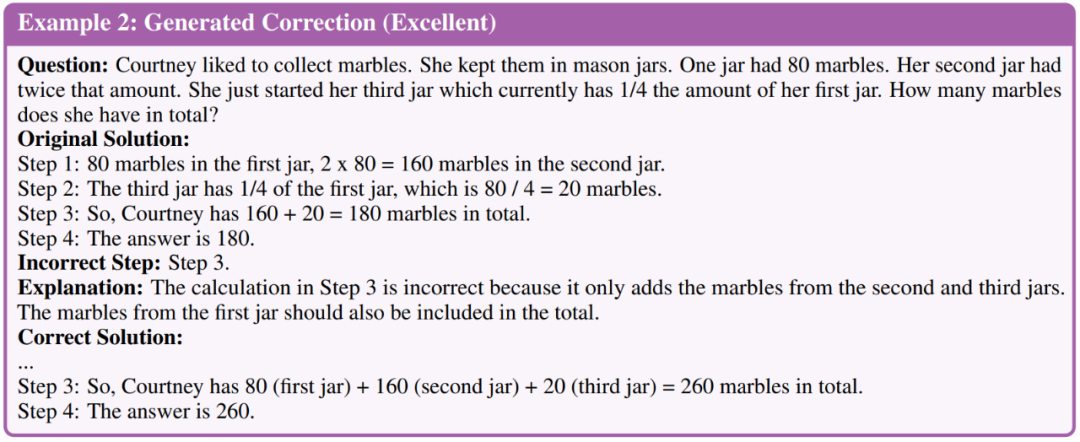

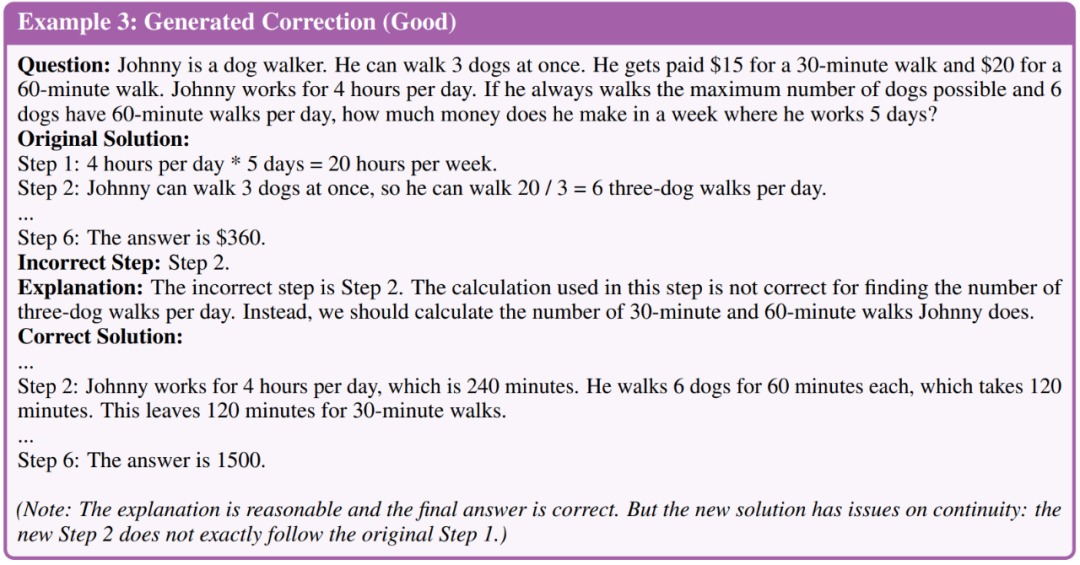

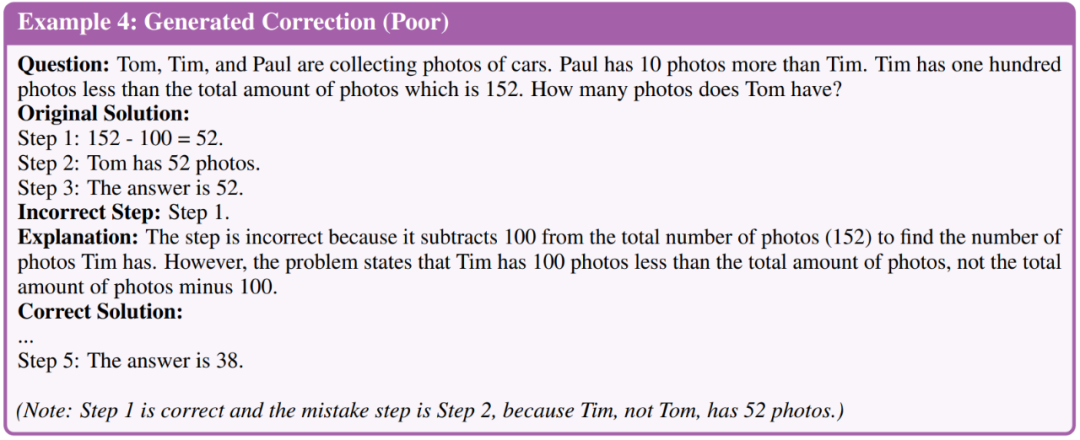

研究人员对修正进行了分类,分为三个质量等级,分别是优秀、良好和糟糕。以下是三个等级的示例

评估结果发现,50 个生成修正中有 35 个达到了优秀质量、11 个为良好、4 个为糟糕。根据这一评估结果,研究者推断使用 GPT-4 生成修正的整体质量足以进行进一步的微调阶段。因此,他们生成了更多大规模的修正,并将所有最终得出正确答案的修正用于需要进行微调的是LLM。

需要进行微调的是LLM

在生成修正数据:需要进行重写的内容之后,研究者微调了 LLM,从而评估这些模型是否可以从错误中学习。他们主要在以下两种微调设置下进行性能比较。

一是在思维链(CoT)数据上微调。研究者仅在问题原理(question-rationale)数据上微调模型。尽管每个任务中有带注释的数据,但他们额外采用了 CoT 数据增强。研究者使用 GPT-4 为训练集中的每个问题生成了更多推理路径,并过滤掉最终答案错误的路径。他们利用 CoT 数据增强来构建一个强大的微调基线,该基线仅使用 CoT 数据,并有助于对控制微调的数据大小进行消融研究。

二是在 CoT 数据 + 修正数据上微调。除了 CoT 数据,研究者还将生成的错误修正数据用于微调(即 LEMA)。他们同样进行了控制数据大小的消融实验,以减少增量对数据大小的影响。

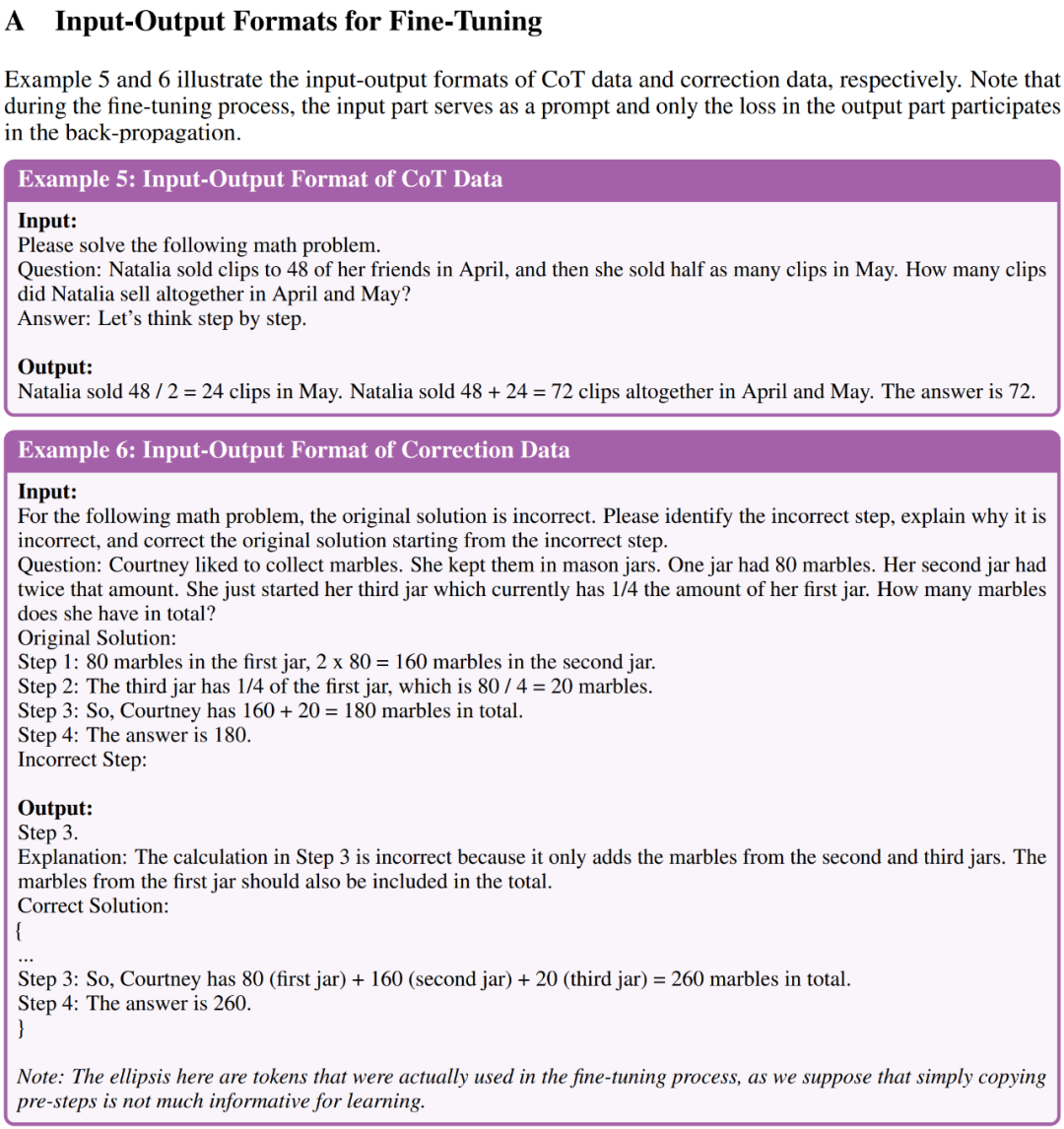

附录 A 中的示例 5 和示例 6 分别展示了用于微调的 CoT 数据和修正数据的输入 - 输出格式

实验结果

研究人员通过实验结果证明了LEMA在五个开源LLM和两个具有挑战性的数学推理任务上的有效性

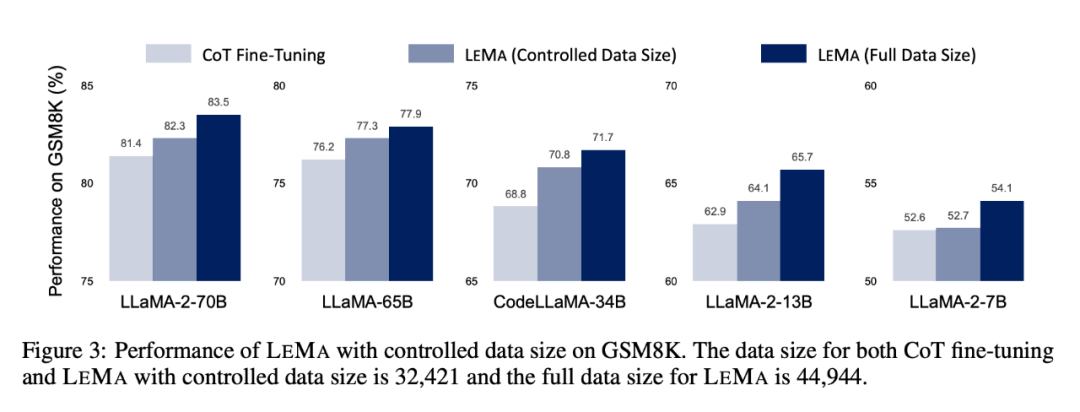

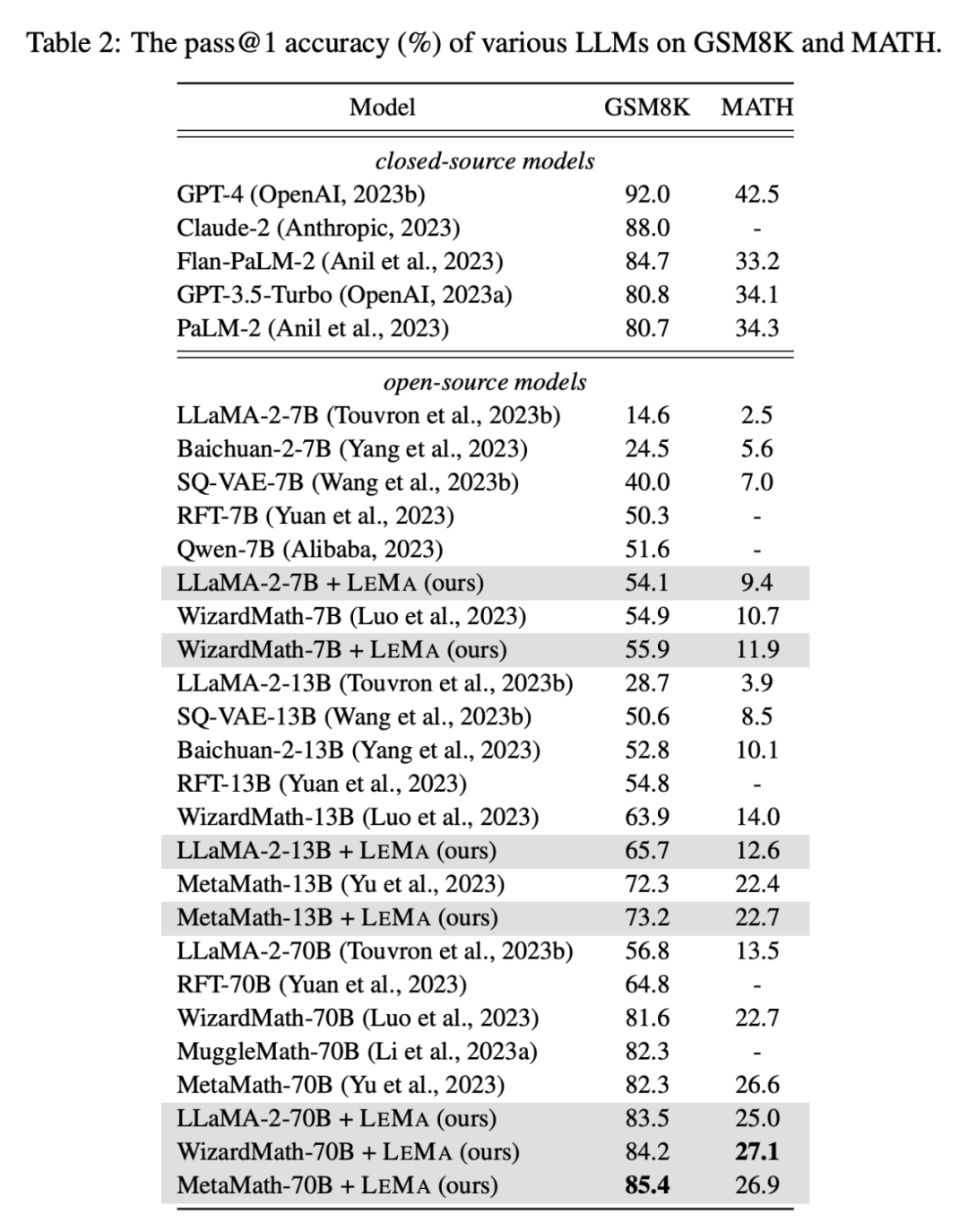

LEMA 在各种 LLM 和任务中都能持续提升性能,与仅在 CoT 数据上进行微调相比。例如,使用 LLaMA-2-70B 的 LEMA 在 GSM8K 和 MATH 上分别取得了 83.5% 和 25.0% 的成绩,而仅在 CoT 数据上进行微调则分别取得了 81.4% 和 23.6% 的成绩

此外,LEMA 与专有 LLM 兼容:带有 WizardMath-70B /MetaMath-70B 的 LEMA 在 GSM8K 上实现了 84.2%/85.4% 的 pass@1 准确率,在 MATH 上实现了 27.1%/26.9% 的 pass@1 准确率,超过了众多开源模型在这些挑战性任务上取得的 SOTA 性能。

随后的消融研究表明,在相同的数据量下,LEMA 仍然优于 CoT-alone 微调。这表明,CoT 数据和校正数据的有效性并不相同,因为两种数据源的结合比使用单一数据源能产生更多的改进。这些实验结果和分析强调了从错误中学习在增强 LLM 推理能力方面的潜力。

如需查看更多研究细节,请参阅原始论文

理论要掌握,实操不能落!以上关于《GPT-4 做「世界模型」,让LLM从「错题」中学习,推理能力显著提升》的详细介绍,大家都掌握了吧!如果想要继续提升自己的能力,那么就来关注golang学习网公众号吧!

-

501 收藏

-

501 收藏

-

501 收藏

-

501 收藏

-

501 收藏

-

182 收藏

-

326 收藏

-

220 收藏

-

156 收藏

-

482 收藏

-

401 收藏

-

227 收藏

-

172 收藏

-

113 收藏

-

238 收藏

-

341 收藏

-

324 收藏

-

- 前端进阶之JavaScript设计模式

- 设计模式是开发人员在软件开发过程中面临一般问题时的解决方案,代表了最佳的实践。本课程的主打内容包括JS常见设计模式以及具体应用场景,打造一站式知识长龙服务,适合有JS基础的同学学习。

- 立即学习 543次学习

-

- GO语言核心编程课程

- 本课程采用真实案例,全面具体可落地,从理论到实践,一步一步将GO核心编程技术、编程思想、底层实现融会贯通,使学习者贴近时代脉搏,做IT互联网时代的弄潮儿。

- 立即学习 516次学习

-

- 简单聊聊mysql8与网络通信

- 如有问题加微信:Le-studyg;在课程中,我们将首先介绍MySQL8的新特性,包括性能优化、安全增强、新数据类型等,帮助学生快速熟悉MySQL8的最新功能。接着,我们将深入解析MySQL的网络通信机制,包括协议、连接管理、数据传输等,让

- 立即学习 500次学习

-

- JavaScript正则表达式基础与实战

- 在任何一门编程语言中,正则表达式,都是一项重要的知识,它提供了高效的字符串匹配与捕获机制,可以极大的简化程序设计。

- 立即学习 487次学习

-

- 从零制作响应式网站—Grid布局

- 本系列教程将展示从零制作一个假想的网络科技公司官网,分为导航,轮播,关于我们,成功案例,服务流程,团队介绍,数据部分,公司动态,底部信息等内容区块。网站整体采用CSSGrid布局,支持响应式,有流畅过渡和展现动画。

- 立即学习 485次学习