Anydoor 打造了一种不再担心合照人数不足的图片编辑技术

来源:机器之心

时间:2024-01-31 16:58:27 382浏览 收藏

golang学习网今天将给大家带来《Anydoor 打造了一种不再担心合照人数不足的图片编辑技术》,感兴趣的朋友请继续看下去吧!以下内容将会涉及到等等知识点,如果你是正在学习科技周边或者已经是大佬级别了,都非常欢迎也希望大家都能给我建议评论哈~希望能帮助到大家!

可以把这张图里的产品放到另一张图的桌子上吗?

面对这样的要求,设计师肯定会感到非常困扰

将指定物品放入另一张图片并不像贴贴纸那样简单,要实现无缝接合,需要在编辑软件中精细调整贴图的形状、材质、光影等等

如果有一种技术可以让贴图融入背景图,并根据你的指令自动调整姿势和站位,那会是一种“魔法”吗?

来自香港大学、阿里巴巴和蚂蚁集团的新成果 Anydoor 为图片编辑打开了一扇「任意门」。任何物品,只需要一张照片,就能被传送到另一张图片的世界中。

论文链接:请访问以下链接查看需要https://arxiv.org/pdf/2307.09481.pdf

请查看项目链接:需要被改写的内容是:https://damo-vilab.github.io/AnyDoor-Page/

举个例子,如果想让这只柯基照着涂鸦的姿势,在墙角站立、躺下或坐下,都没有问题

让哆啦A梦的姿势从背着手改为向你打招呼,只需几分钟就能完成,同时保留了原本的毛毡材质质感

在交换位置、移动物品方面,这只是小事情

通过多角度照片和无需3D建模,您可以轻松查看这双鞋子的正面和侧面

将野餐布上的另一只小熊换成这只鞋,再给它做个镜像效果,画个框,就可以静待魔法生成了。重新合成后,餐布的褶皱没有产生明显的形变

试穿衣服也可以玩成贴画游戏,你可以给照片贴上你想要的衣服,立即就能看到立体的上身效果

随着扩散模型的发展,图像编辑领域出现了许多新的成果。以前的模型已经能够根据文本提示或给定的图像重新生成局部图像区域。但是这些方法对于不在训练数据中的新图像的泛化能力较差,或者需要输入多个图像,要等待近一个小时才能得到生成的结果

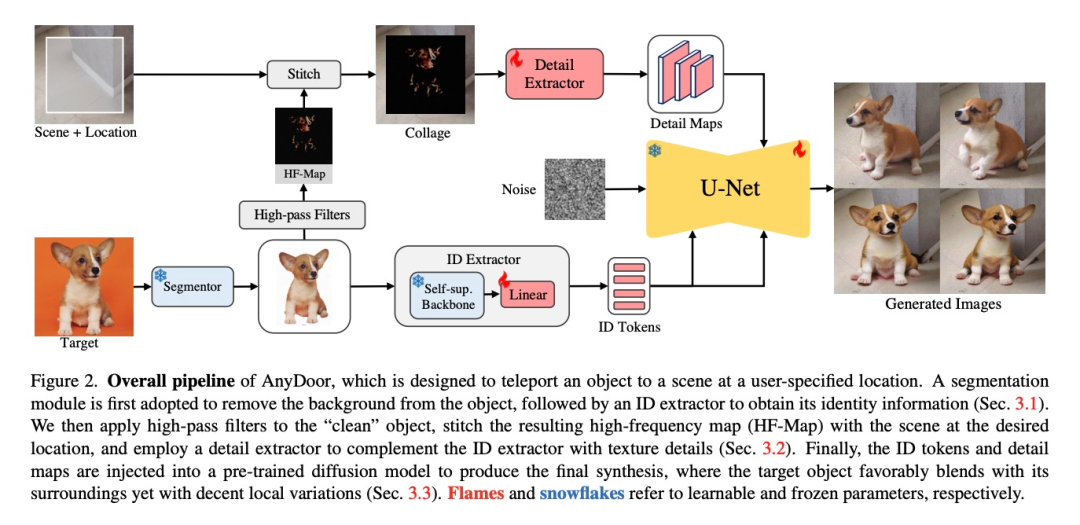

Anydoor实现的是"对象传送",意思是将目标对象精确地放置在场景图像的期望位置。具体来说,Anydoor以目标对象为模板,在图像的框中重新生成场景图像的局部区域。这在图像合成、效果图像渲染、海报制作、虚拟试穿等应用场景中非常有用

方法简介:

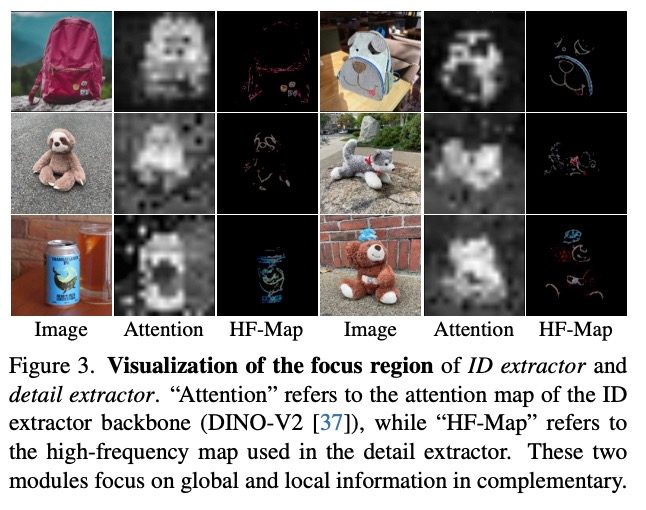

对于给定目标对象、场景和位置,Anydoor 实现了高保真度和多样化的零样本对象 - 场景合成。为了做到这一点,作者的核心思想是用身份和细节高度相关的特征来表示目标对象,然后将它们组合到与背景场景的交互之中。作者用一个 ID 提取器来生产有区分度的 ID token,并设计了一个以频率感知的细节提取器来获取细节图作为补充。再将 ID token 和提取器获得的细节图注入一个预训练好的文本到图像扩散模型中,指导生成所需的图像。

为了增强定制对象生成的泛化性,作者通过收集同一对象的图像对来让模型能够学习对象外观的变化。为了确保场景的多样性,他们使用了大规模统计图像。为了提高视频和图像的学习效率,作者们还设计了一个自适应时间步长采样器,对不同的训练数据源采取不同的去噪步骤

提取身份特征

作者使用了预训练的视觉编码器来提取目标对象的身份信息。由于CLIP的训练数据是粗略描述的文本图像对,只能嵌入语义级别的信息,而难以保留有区分度的对象身份表示。为了克服这一挑战,作者在目标图像输入ID提取器之前,使用了分割器以去除背景,并将对象对齐到图像中心。这样做有助于提取更简洁和更有辨别性的特征

自监督模型在保留高辨别度特征方面表现出更强大的能力。因此,作者选择了DINO-V2作为ID提取器的基础,并使用单个线性层将ID提取器的令牌对齐到预训练的文本到图像的UNet中

细节特征提取的重要性不可忽视。在许多领域,如图像处理和数据分析,细节特征提取是一个关键步骤。通过提取图像或数据中的细微特征,我们可以获得更多的信息,并用于进一步的分析和应用。细节特征可以包括边缘、纹理、形状等方面的信息。在机器学习和计算机视觉中,细节特征提取是训练模型和识别对象的基础。因此,深入了解和掌握细节特征提取的方法和技巧对于提高算法的准确性和效果至关重要。通过有效地提取和利用细节特征,我们可以更好地理解和解释数据,从而做出更准确的决策和预测。因此,在各个领域中,不论是学术研究还是实际应用,细节特征提取都具有重要的意义

由于 ID token 会失去空间分辨率,很难保持目标对象的精细细节,作者尝试了将移除过背景的对象拼接到场景图像的给定位置。虽然生成保真度有了显著提高,但生成的结果与给定的目标过于相似,缺乏多样性。为此,作者设计了一个表示对象的高频图,它可以保持精细的细节,同时允许灵活的局部变体,如手势、照明、方向等。

特征注入可以用来重新编写内容,而不改变原始的意思

在获得 ID token 和细节图后,需要将它们注入一个预先训练好的文本到图像扩散模型中来指导生成。作者选择了 Stable Diffusion 将图像投影到潜在空间中,并使用 UNet 进行概率采样。

为了重新表达"训练策略"的意思,我们可以使用以下表述: - 培训方案 - 训练方法 - 培训策略 - 训练策划 - 训练战略 - 培训策略规划 - 训练计划

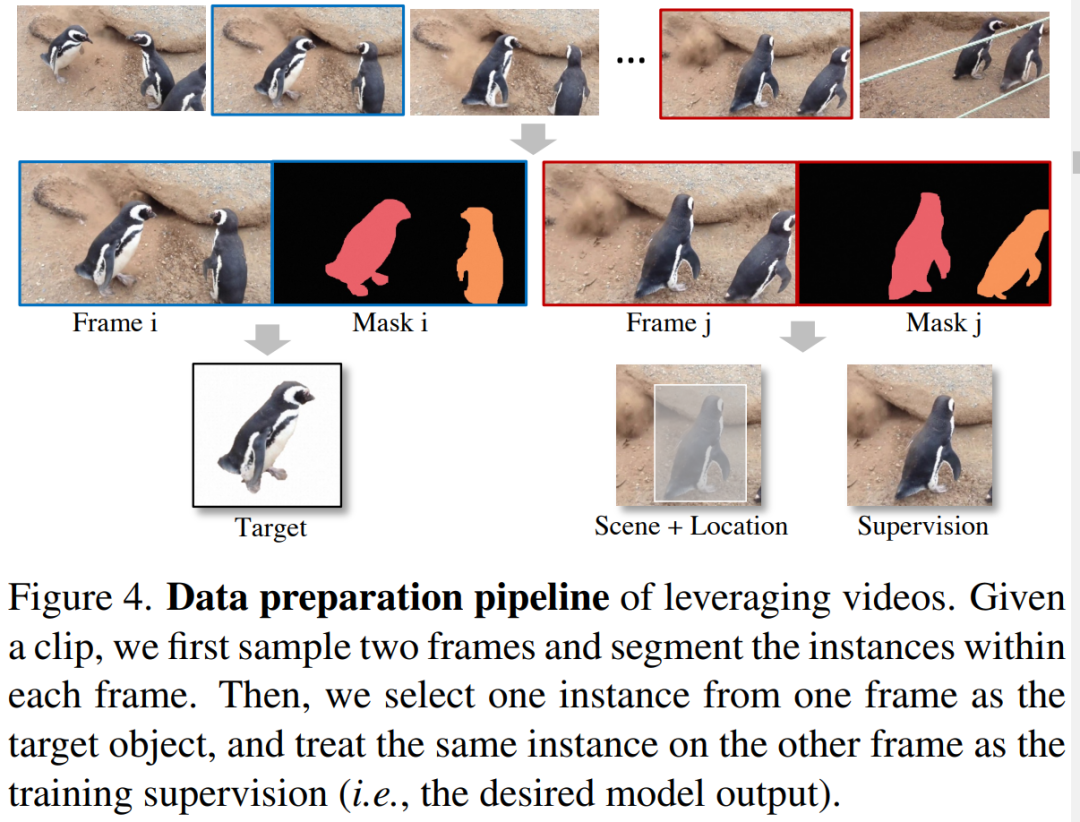

本项工作中,我们利用视频数据集来捕获包含同一对象的不同帧,数据准备流程如图 4 所示:

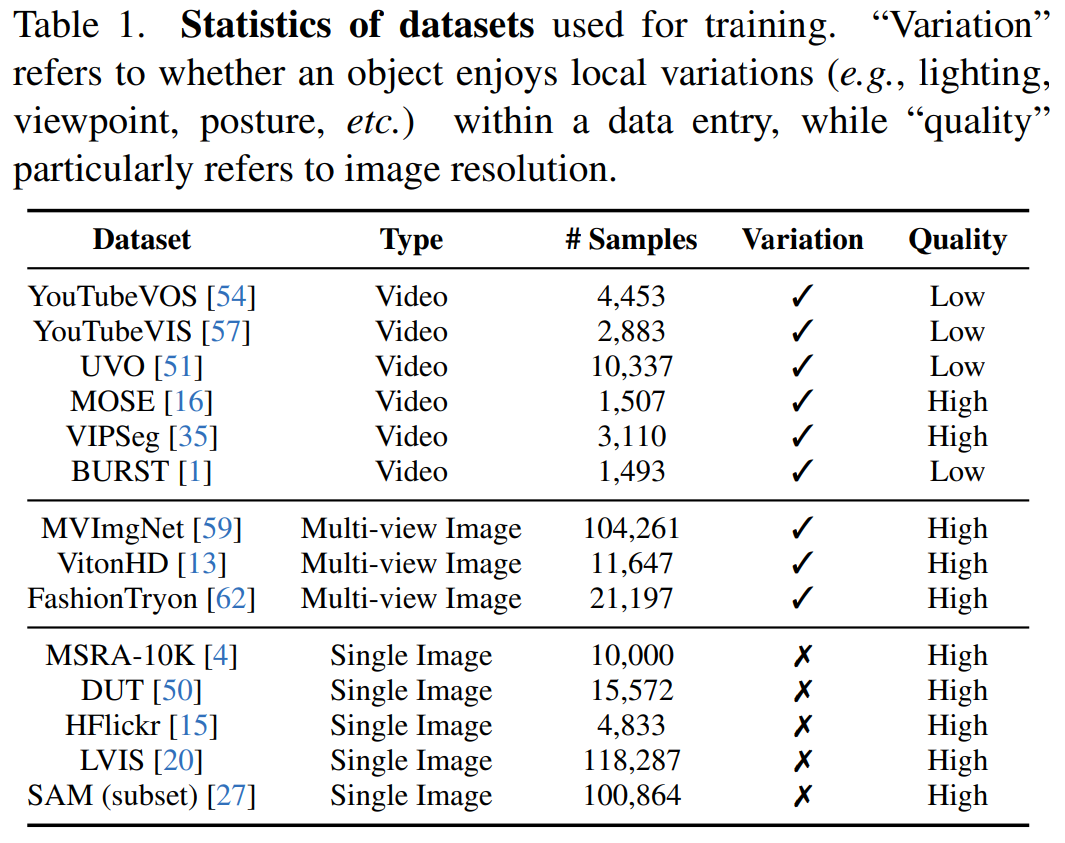

表 1 中包含了完整的数据列,覆盖了自然场景、虚拟试穿和多视图对象等多个领域

为了重写内容而不改变原本的意思,需要将语言改写为中文,不需要出现原本的句子

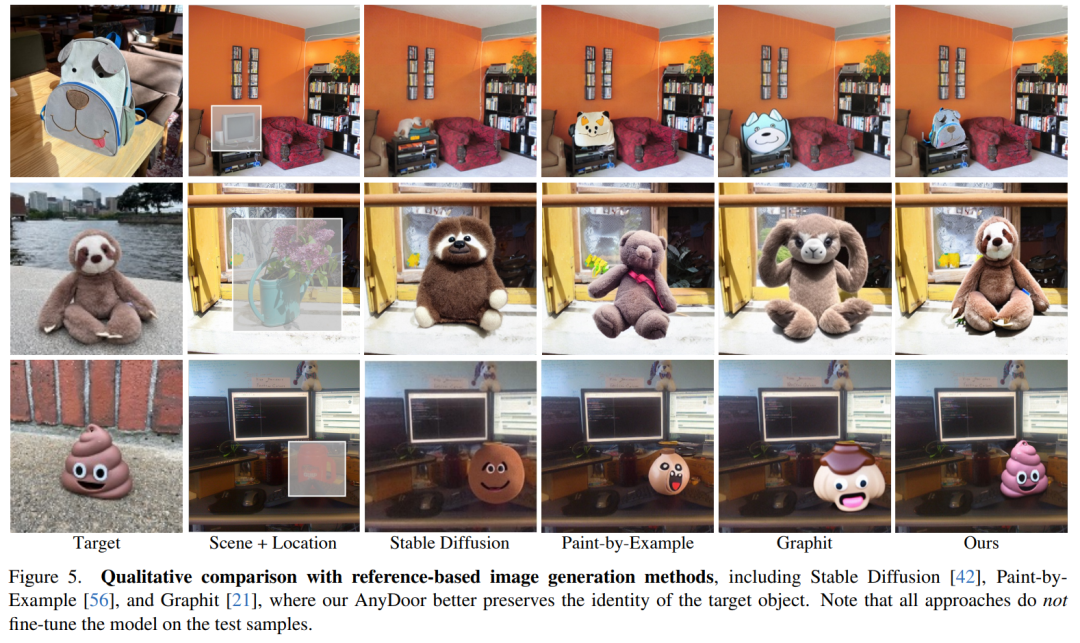

该研究选择了 Stable Diffusion V2.1 作为基础生成器。图 5 展示了与基于参考的图像生成方法的对比结果。Paint-by-Example 和 Graphit 支持与本文相同的输入格式,它们以目标图像作为输入来编辑场景图像的局部区域,而无需参数调整。此外,本文还与 Stable Diffusion 进行了比较

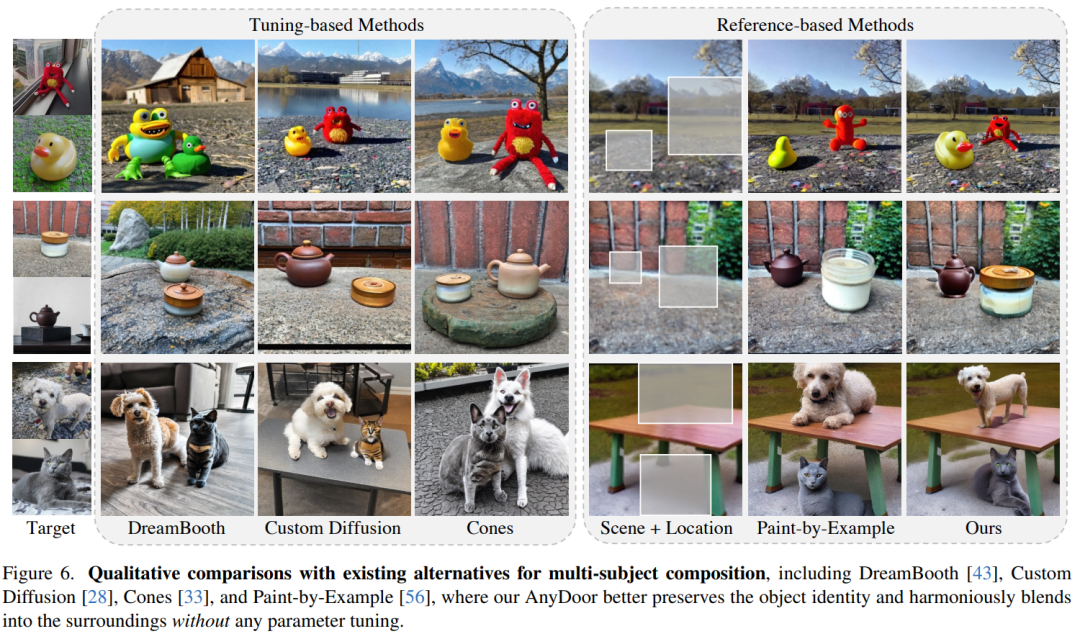

图 6 表明,AnyDoor 兼具基于参考和基于调整的方法的优点,无需进行参数调整即可生成多主题合成的高保真结果。具体而言,Paint-by-Example 对于经过训练的类别(如狗和猫)(第 3 行)表现良好,但对于新概念(第 1-2 行)表现不佳。DreamBooth、Custom Diffusion 和 Cones 为新概念提供了更好的保真度,但仍然存在多主体混淆的问题。

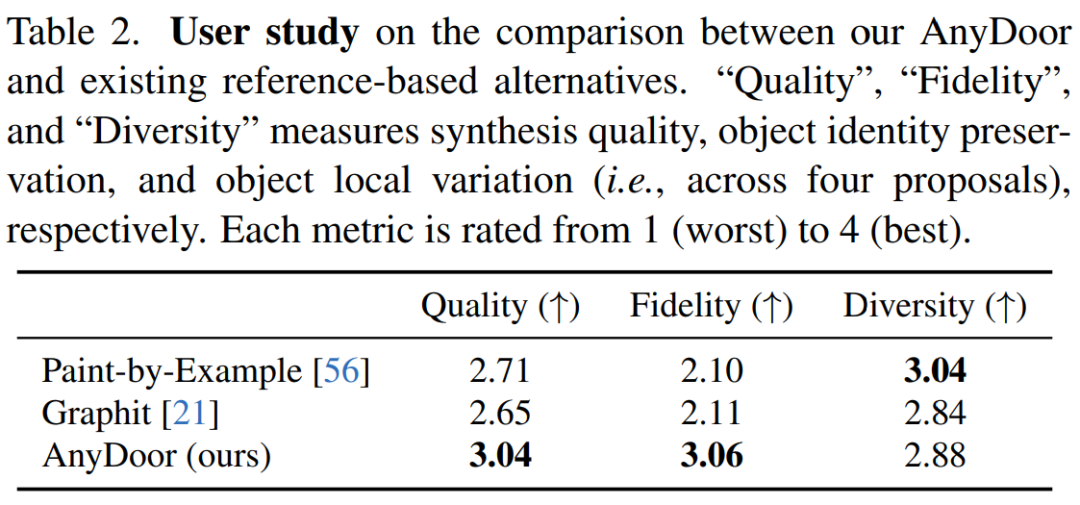

根据原文内容进行改写: 从表2可以看出,本文提出的模型在保真度和数量方面具有明显的优势。尤其是在保真度方面表现出色。然而,与其他方法只保持语义一致性不同,本文方法还保留了实例的身份,因此具有更大的多样性空间。在这种情况下,AnyDoor仍然比Graphit具有更高的速率,并且产生了与Paint-by-Example相竞争的结果,这证明了本文方法的有效性

参考链接如下:

请访问以下链接查看需要https://arxiv.org/pdf/2307.09481.pdf

https://github.com/damo-vilab/AnyDoor/tree/main

需要被改写的内容是:https://damo-vilab.github.io/AnyDoor-Page/

需要重新改写的内容是:https://twitter.com/alexcarliera/status/1737244116189372895

终于介绍完啦!小伙伴们,这篇关于《Anydoor 打造了一种不再担心合照人数不足的图片编辑技术》的介绍应该让你收获多多了吧!欢迎大家收藏或分享给更多需要学习的朋友吧~golang学习网公众号也会发布科技周边相关知识,快来关注吧!

-

501 收藏

-

501 收藏

-

501 收藏

-

501 收藏

-

501 收藏

-

205 收藏

-

315 收藏

-

422 收藏

-

110 收藏

-

167 收藏

-

223 收藏

-

115 收藏

-

484 收藏

-

163 收藏

-

267 收藏

-

228 收藏

-

185 收藏

-

- 前端进阶之JavaScript设计模式

- 设计模式是开发人员在软件开发过程中面临一般问题时的解决方案,代表了最佳的实践。本课程的主打内容包括JS常见设计模式以及具体应用场景,打造一站式知识长龙服务,适合有JS基础的同学学习。

- 立即学习 543次学习

-

- GO语言核心编程课程

- 本课程采用真实案例,全面具体可落地,从理论到实践,一步一步将GO核心编程技术、编程思想、底层实现融会贯通,使学习者贴近时代脉搏,做IT互联网时代的弄潮儿。

- 立即学习 516次学习

-

- 简单聊聊mysql8与网络通信

- 如有问题加微信:Le-studyg;在课程中,我们将首先介绍MySQL8的新特性,包括性能优化、安全增强、新数据类型等,帮助学生快速熟悉MySQL8的最新功能。接着,我们将深入解析MySQL的网络通信机制,包括协议、连接管理、数据传输等,让

- 立即学习 500次学习

-

- JavaScript正则表达式基础与实战

- 在任何一门编程语言中,正则表达式,都是一项重要的知识,它提供了高效的字符串匹配与捕获机制,可以极大的简化程序设计。

- 立即学习 487次学习

-

- 从零制作响应式网站—Grid布局

- 本系列教程将展示从零制作一个假想的网络科技公司官网,分为导航,轮播,关于我们,成功案例,服务流程,团队介绍,数据部分,公司动态,底部信息等内容区块。网站整体采用CSSGrid布局,支持响应式,有流畅过渡和展现动画。

- 立即学习 485次学习