书生发布InternVL3.5视觉模型全面升级

时间:2025-09-08 17:59:57 455浏览 收藏

**书生重磅发布!InternVL 3.5视觉模型全系列开源,性能直逼GPT-5和Gemini 2.5 Pro!** 书生近日正式推出全新InternVL 3.5视觉模型系列,涵盖1B到241B共8种规模,全面满足不同应用需求。其中,241B版本在视觉理解任务中表现卓越,各项评测数据表明,其性能已跻身全球前列,紧随GPT-5和Gemini 2.5 Pro之后。InternVL 3.5系列模型已全部开源,并上线Hugging Face平台,方便开发者使用。该系列模型采用级联强化学习、视觉分辨率路由机制和解耦式视觉-语言部署架构等创新技术,显著提升了模型在复杂推理任务中的表现和推理速度,整体推理性能较前代提升最高达16.0%,实测部署速度更是提升了4.05倍。立即体验InternVL 3.5,赋能你的视觉理解应用!

书生近日推出了全新视觉模型系列——InternVL 3.5,涵盖从1B到241B共8种不同规模的版本。

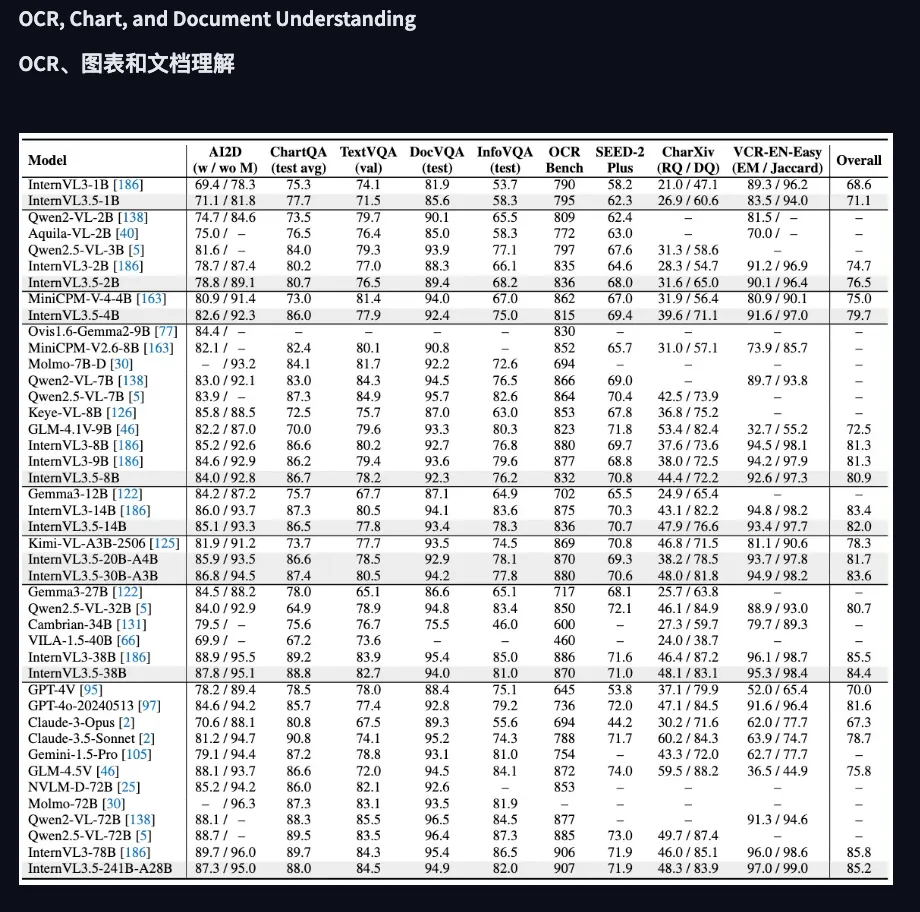

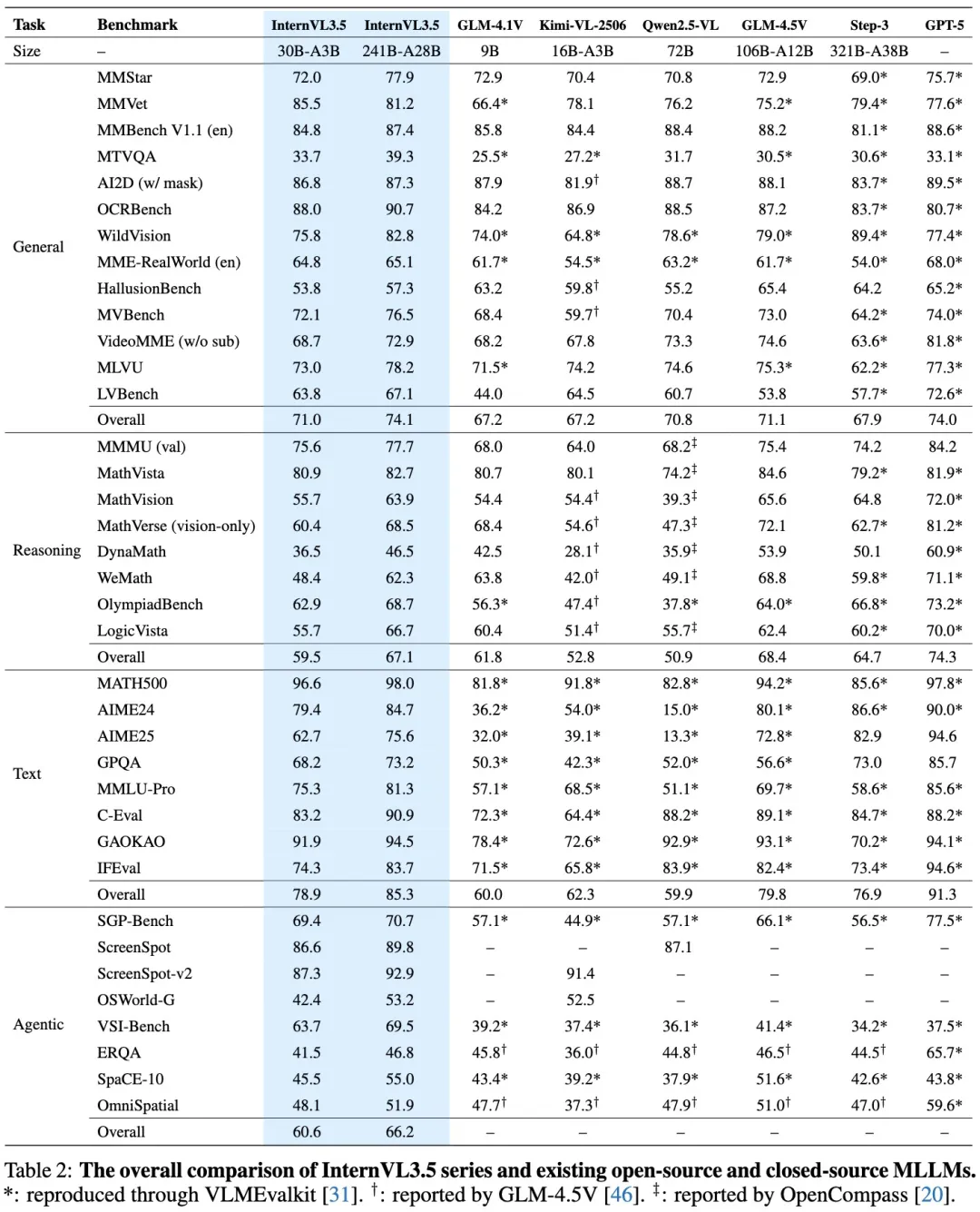

根据多项评测数据显示,InternVL 3.5 中最大规模的241B模型在视觉理解任务中的表现仅次于商用模型 GPT-5 和 Gemini 2.5 Pro,位居前列。

目前,该系列全部模型均已开源并上线 Hugging Face 平台:

https://huggingface.co/collections/OpenGVLab/internvl35-68ac87bd52ebe953485927fb

模型核心技术创新包括:

- 级联强化学习(Cascade Reinforcement Learning, Cascade RL):结合离线强化学习与在线强化学习的双阶段训练策略,提升模型收敛稳定性与对齐精度,显著增强复杂推理能力,在 MMMU、MathVista 等高难度任务上表现突出。

- 视觉分辨率路由机制(Visual Resolution Router, ViR):支持动态调节视觉 token 的输入分辨率,灵活平衡计算开销与识别精度,提升视觉理解效率。

- 解耦式视觉-语言部署架构(Decoupled Vision-Language Deployment, DvD):将视觉编码器与语言解码器分离部署至不同 GPU 设备,优化资源分配,大幅提高推理吞吐速度。

整体推理性能相较前代提升最高达 16.0%,并在实际部署中实现比 InternVL3 快 4.05 倍的推理速度。

文中关于的知识介绍,希望对你的学习有所帮助!若是受益匪浅,那就动动鼠标收藏这篇《书生发布InternVL3.5视觉模型全面升级》文章吧,也可关注golang学习网公众号了解相关技术文章。

-

501 收藏

-

501 收藏

-

501 收藏

-

501 收藏

-

501 收藏

-

488 收藏

-

155 收藏

-

134 收藏

-

158 收藏

-

218 收藏

-

105 收藏

-

365 收藏

-

226 收藏

-

377 收藏

-

349 收藏

-

150 收藏

-

199 收藏

-

- 前端进阶之JavaScript设计模式

- 设计模式是开发人员在软件开发过程中面临一般问题时的解决方案,代表了最佳的实践。本课程的主打内容包括JS常见设计模式以及具体应用场景,打造一站式知识长龙服务,适合有JS基础的同学学习。

- 立即学习 543次学习

-

- GO语言核心编程课程

- 本课程采用真实案例,全面具体可落地,从理论到实践,一步一步将GO核心编程技术、编程思想、底层实现融会贯通,使学习者贴近时代脉搏,做IT互联网时代的弄潮儿。

- 立即学习 516次学习

-

- 简单聊聊mysql8与网络通信

- 如有问题加微信:Le-studyg;在课程中,我们将首先介绍MySQL8的新特性,包括性能优化、安全增强、新数据类型等,帮助学生快速熟悉MySQL8的最新功能。接着,我们将深入解析MySQL的网络通信机制,包括协议、连接管理、数据传输等,让

- 立即学习 500次学习

-

- JavaScript正则表达式基础与实战

- 在任何一门编程语言中,正则表达式,都是一项重要的知识,它提供了高效的字符串匹配与捕获机制,可以极大的简化程序设计。

- 立即学习 487次学习

-

- 从零制作响应式网站—Grid布局

- 本系列教程将展示从零制作一个假想的网络科技公司官网,分为导航,轮播,关于我们,成功案例,服务流程,团队介绍,数据部分,公司动态,底部信息等内容区块。网站整体采用CSSGrid布局,支持响应式,有流畅过渡和展现动画。

- 立即学习 485次学习