发布深度势能预训练大模型DPA-2的OpenLAM介绍

来源:机器之心

时间:2023-12-29 15:04:48 444浏览 收藏

大家好,今天本人给大家带来文章《发布深度势能预训练大模型DPA-2的OpenLAM介绍》,文中内容主要涉及到,如果你对科技周边方面的知识点感兴趣,那就请各位朋友继续看下去吧~希望能真正帮到你们,谢谢!

面向广大社区的深度势能核心开发者团队,在通向通用大原子模型(Large Atomic Model,LAM)的征途上,发起了名为OpenLAM的大原子模型计划。OpenLAM的口号是“征服元素周期表!”,旨在通过建立一个开源、开放的微观尺度大模型生态系统,为微观科学研究提供新的基础设施,并推动材料、能源、生物制药等领域微观尺度工业设计的变革。

深度势能团队最近发布了一款名为DPA-2的深度势能预训练大模型。这个项目得到了来自北京科学智能研究院、深势科技、北京应用物理与计算数学研究所等29家单位的合作支持,共有42位合作者参与了这一项目。DPA-2将成为OpenLAM大原子模型计划的重要组成部分。与此同时,基于DPA-2的微调、蒸馏和应用自动化流程也将面向社区全面开放,以满足各种实际应用的需求。有关DPA-2的详细信息已经在arXiv上发表了一篇名为《DPA-2: Towards a universal large atomic model for molecular and material simulation》的文章。

面向丰富的下游任务,微调 DPA-2“大模型”所需的数据量整体相比过去减少了 1-2 个数量级;同时,进一步蒸馏、压缩得到的深度势能“小模型”可以保持过去模型的精度和效率。相比于去年发布的 DPA-1,DPA-2 在模型架构显著更新的同时,最大的特点在于采用了多任务训练的策略,从而可以同时学习计算设置不同、标签类型不同的各类数据集。由此产生的模型在下游任务上显示出极强的 few-shot 乃至 zero-shot 迁移的能力,显著超越过去的方案。目前用于训练 DPA-2 模型的数据集已覆盖了半导体、钙钛矿、合金、表面催化、正极材料、固态电解质、有机分子等多类体系。

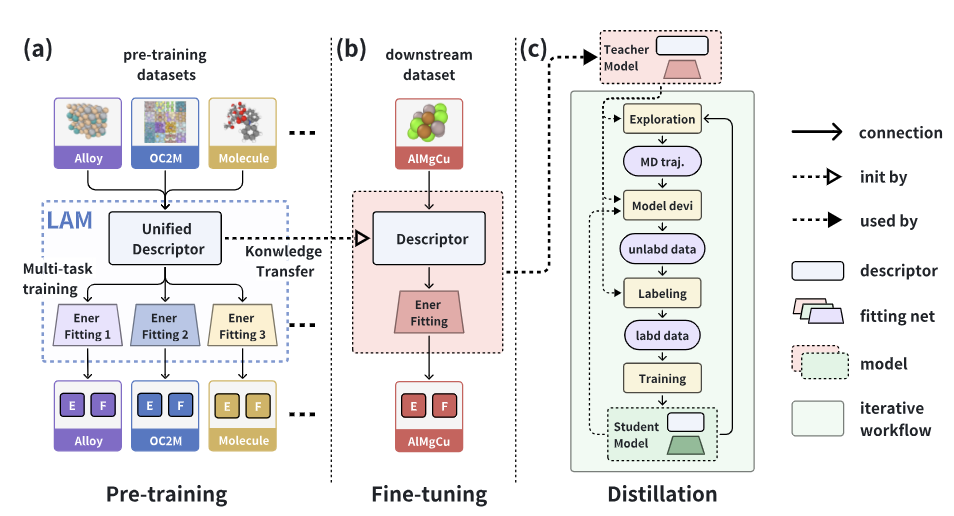

图1 DPA-2 提出的多任务预训练、微调、蒸馏全流程示意图

“大原子模型计划(OpenLAM)”为进一步打破数据壁垒,拓宽原子层面各方面的应用,为开源开放的科学计算生态共建打开了新的思路。作为一项开放式的协作计划,建立一个开放且面向应用的模型评估系统也格外重要。面向社区该计划将定期进行模型更新与评估报告发布、定期更新发布领域应用与评估工作流,同时开展比赛、培训交流,与领域开发者协作推动建立供预训练与评估的数据集等。这将是 OpenLAM 计划在 2024 年的重点。

感兴趣的读者,欢迎通过以下 Bohrium Notebook 链接快速上手 DPA-2,也欢迎使用 DP Combo@Bohrium APP 更加深入系统地产生你需要的势函数!

Notebook链接是一个非常有用的工具,它可以帮助我们更方便地记录和整理信息。通过使用Notebook链接,我们可以轻松地创建和编辑笔记,添加标签和分类,以便更好地组织我们的思维和工作。此外,我们还可以与他人共享我们的笔记,并进行实时协作,提高工作效率。总之,Notebook链接是一个强大而实用的工具,可以帮助我们更好地管理和利用信息。

https://nb.bohrium.dp.tech/detail/18475433825

以下为关于 DPA-2 的详细介绍。

1 DPA-2 项目背景 DPA-2(Data Processing and Analysis-2)项目是一个数据处理和分析的项目。该项目的背景是为了解决大量数据的处理和分析问题。在当今的信息时代,数据量急剧增加,传统的数据处理方法已经无法胜任,需要一种更高效和精确的处理和分析方法。 DPA-2项目旨在开发一种新的数据处理和分析系统,以满足现代数据处理需求。该系统将利用先进的算法和技术,提供快速、准确和可靠的数据处理和分析功能。它将能够处理各种类型的数据,包括结构化数据、非结构化数据和多媒体数据。 DPA-2项目还将致力于提高数据处理和分析的效率和性能。通过优化算法和提供高度并行化的计算能力,该系统将能够在较短的时间内处理大量数据,并提供准确的分析结果。 总之,DPA-2项目的目标是提供一种高效、准确和可靠的数据处理和分析系统,以满足现代数据处理需求。通过该系统,用户将能够更好地利用数据,做出更明智的决策。

机器学习势函数在材料科学、计算物理等领域应用广泛,并取得了较大成果。然而,面对一个新的复杂体系,要获得可用的、较为完备的势函数模型,科学家们基本上仍然需要获取大量计算数据并从头开始训练模型。随着电子结构数据的积累,开始有工作关注“通用”的势能函数模型,比如 DPA-1,Gemnet-OC,Equiformer-V2,M3GNet 等,并有部分工作将其应用到“预训练+微调”的范式上来,从而节省新体系的数据生产成本。

然而,这些模型目前还没有达到通用的水平,主要存在以下几个问题: 1. 数据偏差:这些模型的训练数据通常来源于特定领域或特定类型的文本,因此对于其他领域或类型的文本理解能力较弱。这导致了在处理一些非常规或特殊的文本时出现困难。 2. 理解语境:模型在理解语境方面仍然存在一些挑战。它们可能会受到句子结构、词义歧义、上下文等因素的影响,导致理解不准确或产生错误的推理。 3. 模型偏见:由于训练数据的偏差或不平衡,这些模型可能会反映出一些社会偏见或歧视。例如,在性别、种族或文化方面存在一些不公平的倾向。 4. 模型可解释性:当前的模型通常是黑盒子,难以解释其决策的原因或推理的过程。这在某些应用场景中可能会引发信任问题。 尽管存在这些问题,但研究人员和工程师们正在不断努力改进模型的性能和能力,希望未来能够实现更加通用、准确和可解释的自然语言处理模型。

(1)模型要求产生预训练数据的方式(比如泛函、DFT 计算的参数设置等)必须严格一致,这极大地限制了训练数据的来源范围,使得大部分模型都只能局限在单一数据集或统一生产的数据库中,数据量受到限制,从而也导致模型泛化能力不足。

(2)模型结构本身的迁移能力不足,预训练之后在下游体系上的微调效果有限;

(3)然而,有些模型存在一些问题,这些问题使得它们无法满足基本的物理性质,例如保守性和连续性。保守性要求输出的力必须严格是输出能量关于输入坐标的负梯度,而连续性要求模型的输出必须在输入上是二阶连续的。由于这些问题,这些模型无法在真实应用系统的模拟中使用。此外,一些模型的参数规模庞大,这进一步限制了它们的应用发展。

要实现真正意义上的 LAM 通用大原子模型,以上的问题是必须要被解决的。

2 多任务预训练

为此,参考 LLM 的发展理念,在提出新模型结构的同时,DPA-2 首先提出了一套多任务预训练(Multi-task Training)框架,可以在不同标注的数据上同时进行训练,得到统一的预训练模型,如上图1(a)所示。DPA-2 可以通过共享大部分网络参数、不同数据集使用不同 head 的方式,在任意多种来源的数据集上同时进行多任务训练,相比使用单一来源数据训练的模型,极大地扩展了其泛化能力和应用范围。但与此同时,多任务的模型参数量并没有本质的增加,这也导致在训练上可能会更为困难。原文中采用了更为科学的采样训练方式,结果表明多任务模型在不同数据集上的精度,和单独训练的模型精度非常接近甚至更高,这也表明了这种训练方式的可行性。

3 下游数据集微调

在进行微调之前,本文在预训练完成后采用了图1(b)中的方法。核心要求是在下游数据集上有良好的迁移能力,即在经过预训练后,能够在下游数据集上使用尽可能少的数据来达到满意的精度。为了测试这一点,本文对经过 DPA-2 预训练的模型在不同下游数据集上的迁移能力进行了测试,并在图2中展示了部分结果。

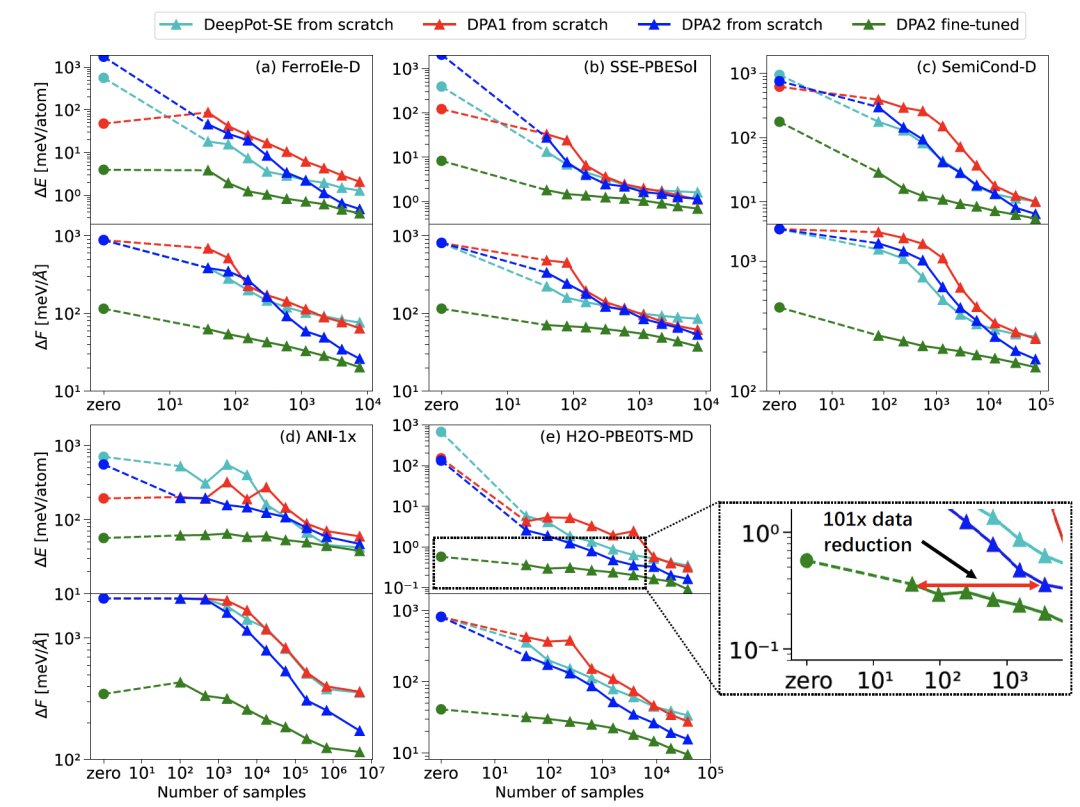

图2 DPA-2 多任务预训练后在下游体系微调的表现

图中横坐标是所用数据量,纵坐标是能量和受力的收敛误差。可以看到,在多任务预训练后,DPA-2 微调代表的深绿色线,要远远低于从头训练的深蓝色线,在大多数体系上,多任务预训练后的模型仅用很少样本(few-shot)、甚至完全不用下游数据(zero-shot)就已经达到了实际应用中可用的精度。平均来看,基于多任务预训练获得的 DPA-2 模型,在各个下游体系能节省 90% 以上的数据。

《文字玩出花》是一款备受欢迎的文字解谜游戏,每天都会推出新的关卡。其中,怀旧大扫除是其中一个关卡,玩家需要在图中找出12个与年代不符的地方。今天,我将为大家分享《文字玩出花》怀旧大扫除关卡的通关攻略,帮助尚未完成的玩家顺利过关。

为了提高预训练模型框架的泛化能力,模型参数规模不可避免地会变得越来越大,这也会影响推理性能,使得模型在真实场景中的应用变得困难。为了解决这个问题,作者在文章中提出了一种模型蒸馏的方法,如图1(c)所示。在下游任务中微调后的模型被称为Teacher模型,它用来教授更简单、更轻量的Student模型(如DPA-1、DeepPot-SE等),期望Student模型在特定下游任务中能够接近Teacher模型的精度,同时相比Teacher模型能够获得接近两个数量级的效率提升,从而可以在大规模、高效率的应用模拟中使用。文章中采用了一种类似主动学习的方法,使用Teacher模型来探索数据空间,并代替量子力学方法来标注新数据,从而将知识高效地蒸馏到更简单的Student模型中。文章中对比了Teacher模型和Student模型的精度,证明了蒸馏方案的可行性。

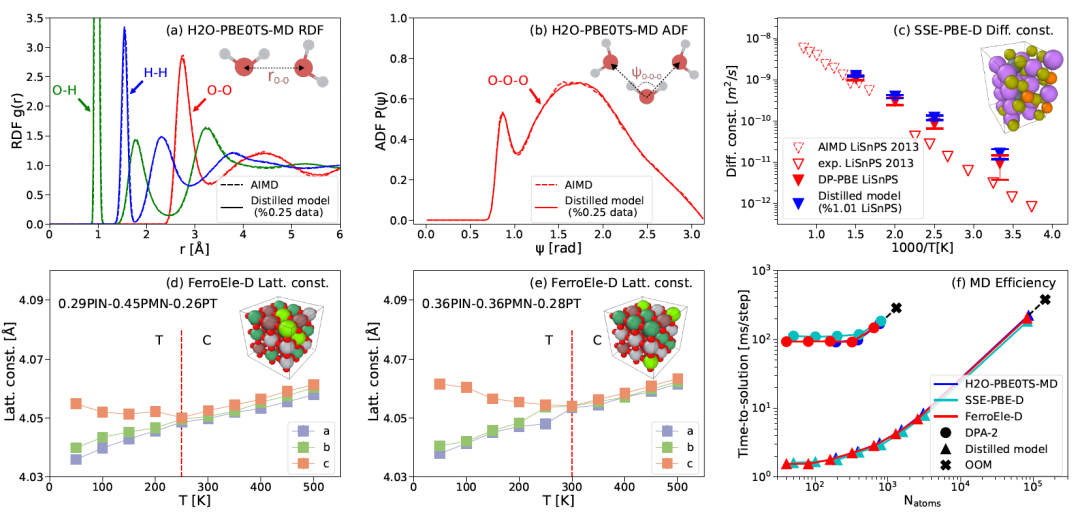

回到势能函数本身,我们可以发现它的最终目的是为了应用导向。为了验证模型的可靠性,我们在多个体系上进行了实际模拟和性质测试,具体的结果如图3所示:

图3 DPA-2蒸馏后的模型在下游体系中的应用测试

通过对蒸馏后的模型进行实验,我们测试了模型在水上的径向分布函数(Radial Distribution Function)、固态电解质上的扩散系数(Diffusion Constant)和钙钛矿铁电固溶体上晶格常数(Lattice Constant)等性质在不同温度下的变化情况。与原来的模型进行对比,我们使用了预训练后微调和蒸馏的方法,在三个不同体系上仅使用了原始数据的0.25%、1.01%和7.86%。实验结果证明了整个流程的可靠性。

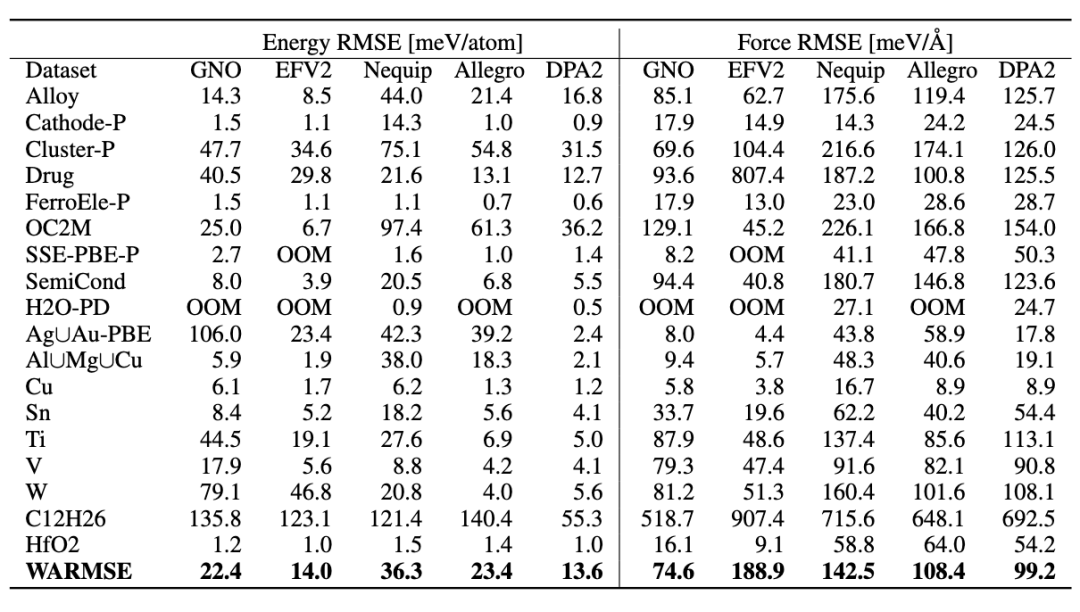

5 其他模型框架的对比

文中还将 DPA-2 的模型结构和其他模型,如 Gemnet-OC (GNO)、Equiformer-V2 (EFV2)、Nequip、Allegro 进行了对比,在传统单数据训练的意义下,公平比较了模型结构本身的能力,如下表所示:

表1 DPA-2 模型结构相比其他模型的精度对比

(batchsize=1, 1 million steps)

可以看到,相比其他模型来说,DPA-2 在各个应用数据集上的表现要更为稳定。

6 总结

DPA-2的提出是朝着实现"通用大原子模型"迈出的重要一步。通过在多个数据集上进行大规模多任务的预训练,DPA-2展现出了在各种下游应用中的显著迁移能力,大大减少了所需的数据量,从而大幅度降低了数据生成的成本。同时,DPA-2也强调了建立一个开放且面向应用的模型评估系统的重要性。

在迈向大原子模型时代的过程中,开源开放势必成为一个重要的主题。我们热烈欢迎志同道合的人加入我们,共同开启更加广泛的科学发现和工业应用的新机遇。我们期待能与你携手并进,在征服元素周期表的道路上共同创造美好的未来!

前往加入”大原子模型计划”:

https://www.aissquare.com/openlam

以上就是本文的全部内容了,是否有顺利帮助你解决问题?若是能给你带来学习上的帮助,请大家多多支持golang学习网!更多关于科技周边的相关知识,也可关注golang学习网公众号。

-

501 收藏

-

501 收藏

-

501 收藏

-

501 收藏

-

501 收藏

-

339 收藏

-

260 收藏

-

438 收藏

-

152 收藏

-

232 收藏

-

280 收藏

-

152 收藏

-

102 收藏

-

247 收藏

-

306 收藏

-

357 收藏

-

334 收藏

-

- 前端进阶之JavaScript设计模式

- 设计模式是开发人员在软件开发过程中面临一般问题时的解决方案,代表了最佳的实践。本课程的主打内容包括JS常见设计模式以及具体应用场景,打造一站式知识长龙服务,适合有JS基础的同学学习。

- 立即学习 543次学习

-

- GO语言核心编程课程

- 本课程采用真实案例,全面具体可落地,从理论到实践,一步一步将GO核心编程技术、编程思想、底层实现融会贯通,使学习者贴近时代脉搏,做IT互联网时代的弄潮儿。

- 立即学习 516次学习

-

- 简单聊聊mysql8与网络通信

- 如有问题加微信:Le-studyg;在课程中,我们将首先介绍MySQL8的新特性,包括性能优化、安全增强、新数据类型等,帮助学生快速熟悉MySQL8的最新功能。接着,我们将深入解析MySQL的网络通信机制,包括协议、连接管理、数据传输等,让

- 立即学习 500次学习

-

- JavaScript正则表达式基础与实战

- 在任何一门编程语言中,正则表达式,都是一项重要的知识,它提供了高效的字符串匹配与捕获机制,可以极大的简化程序设计。

- 立即学习 487次学习

-

- 从零制作响应式网站—Grid布局

- 本系列教程将展示从零制作一个假想的网络科技公司官网,分为导航,轮播,关于我们,成功案例,服务流程,团队介绍,数据部分,公司动态,底部信息等内容区块。网站整体采用CSSGrid布局,支持响应式,有流畅过渡和展现动画。

- 立即学习 485次学习