容器化 | ClickHouse on K8s 部署篇【建议收藏】

来源:SegmentFault

时间:2023-01-26 16:03:27 423浏览 收藏

小伙伴们对数据库编程感兴趣吗?是否正在学习相关知识点?如果是,那么本文《容器化 | ClickHouse on K8s 部署篇【建议收藏】》,就很适合你,本篇文章讲解的知识点主要包括容器、MySQL、kubernetes、clickhouse。在之后的文章中也会多多分享相关知识点,希望对大家的知识积累有所帮助!

目前从事 RadonDB ClickHouse 相关工作,热衷于研究数据库内核。

延续上篇《容器化 ClickHouse on K8s 基本概念解析篇》,可以了解到 Operator 提供简便管理 ClickHouse 集群功能,Helm 提供便捷部署集群功能。

本篇将以部署 RadonDB ClickHouse[1] 作为示例。在同样选用 Operator 的条件下,比较Kubectl 和 Helm 两种方式在 K8s 上部署 ClickHouse 集群的便捷性。并简要介绍如何在 K8s 上通过 Operator 轻便快速地管理 ClickHouse 集群。

| 使用 Kubectl + Operator 部署

前置条件

已安装 Kubernetes 集群。

部署步骤

1、部署 RadonDB ClickHouse Operator

$ kubectl apply -f https://github.com/radondb/radondb-clickhouse-kubernetes/clickhouse-operator-install.yaml

注意:若需 Operator 监控所有的 Kubernetes namespace,则需将其部署在 kube-system namespace 下。否则只会监控部署到的 namespace。

2、编写 CR 的部署文件

以下 yaml 文件描述了应用 RadonDB ClickHouse Operator 安装两分片两副本集群的 ClickHouse 的配置规范。

apiVersion: "clickhouse.radondb.com/v1"

kind: "ClickHouseInstallation" # 应用 Operator 创建集群

metadata:

name: "ClickHouse"

spec:

defaults:

templates: # 磁盘挂载

dataVolumeClaimTemplate: data

logVolumeClaimTemplate: data

configuration:

clusters: # 集群节点描述,三分片两副本

- name: "replicas"

layout:

shardsCount: 2

replicasCount: 2

templates:

volumeClaimTemplates: # 磁盘信息描述

- name: data

reclaimPolicy: Retain

spec:

accessModes:

- ReadWriteOnce

resources:

requests:

storage: 10Gi3、使用 Kubectl 部署

以 test 名称空间为例:

$ kubectl -n test apply -f hello-kubernetes.yaml clickhouseinstallation.clickhouse.radondb.com/ClickHouse created

注意:若 RadonDB ClickHouse Operator 没有部署在 kube-system 中,则需要将 RadonDB ClickHouse 集群与 Operator 部署在同一名称空间。

部署成功后,Kubernetes 会将 CR 信息存入

etcd中,而 Operator 则将感知

etcd的变化。当 Operator 获取 CR 变化内容时,将根据 CR 的内容创建对应的 StatefulSet、Service 等相关内容。

4、查看集群的运行情况

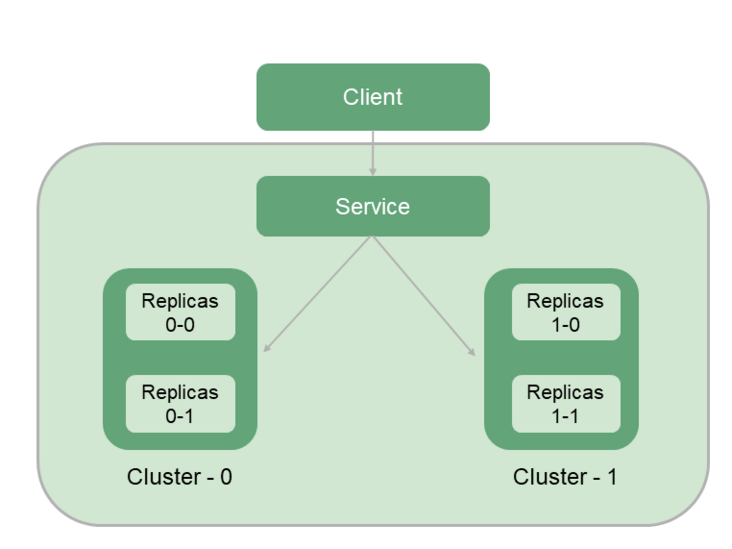

可获取四个正在运行的 RadonDB ClickHouse Pod,组成两片两副本的集群,同时提供一个 LoadBalancer SVC,供外部访问使用。

# 查看 Pod 运行状态 $ kubectl get pods -n test NAME READY STATUS RESTARTS AGE pod/chi-ClickHouse-replicas-0-0-0 1/1 Running 0 3m13s pod/chi-ClickHouse-replicas-0-1-0 1/1 Running 0 2m51s pod/chi-ClickHouse-replicas-1-0-0 1/1 Running 0 2m34s pod/chi-ClickHouse-replicas-1-1-0 1/1 Running 0 2m17s # 查看 SVC 运行状态 $ kubectl get service -n test NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE service/chi-ClickHouse-replicas-0-0 ClusterIP None8123/TCP,9000/TCP,9009/TCP 2m53s service/chi-ClickHouse-replicas-0-1 ClusterIP None 8123/TCP,9000/TCP,9009/TCP 2m36s service/chi-ClickHouse-replicas-1-0 ClusterIP None 8123/TCP,9000/TCP,9009/TCP 2m19s service/chi-ClickHouse-replicas-1-1 ClusterIP None 8123/TCP,9000/TCP,9009/TCP 117s service/clickhouse-ClickHouse LoadBalancer 10.96.137.152 8123:30563/TCP,9000:30615/TCP 3m14s

至此,如何使用 Kubectl + Operator 的方式部署 RadonDB ClickHouse 集群便介绍完毕,可看到整个过程还是需要一定 K8s 知识 “功底” 的。

| 使用 Helm + Operator 部署

前置条件

- 已安装 Kubernetes 集群;

- 已安装 Helm 包管理工具。

部署步骤

1、添加 RadonDB ClickHouse 的 Helm 仓库

$ helm repo add ck https://radondb.github.io/radondb-clickhouse-kubernetes/ $ helm repo update

2、部署 RadonDB ClickHouse Operator

$ helm install clickhouse-operator ck/clickhouse-operator

3、部署 RadonDB ClickHouse 集群

$ helm install clickhouse ck/clickhouse-cluster

4、查看集群的运行情况

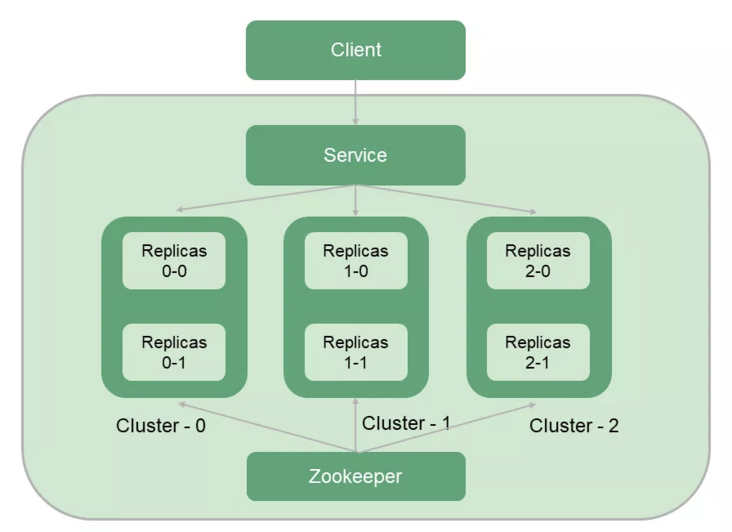

可获取六个正在运行的 RadonDB ClickHouse Pod,以及三个 Zookeeper Pod,组成三分片两副本的集群,同时提供一个 ClusterIP service,供访问使用。如果需要在外部对集群进行访问,此处可通过

kubectl edit service/clickhouse-ClickHouse将 service 的类型自行修改为 NodePort 或 LoadBalancer。

# 查看 Pod 运行状态 $ kubectl get pods -n test NAME READY STATUS RESTARTS AGE pod/chi-ClickHouse-replicas-0-0-0 2/2 Running 0 3m13s pod/chi-ClickHouse-replicas-0-1-0 2/2 Running 0 2m51s pod/chi-ClickHouse-replicas-1-0-0 2/2 Running 0 2m34s pod/chi-ClickHouse-replicas-1-1-0 2/2 Running 0 2m17s pod/chi-ClickHouse-replicas-2-0-0 2/2 Running 0 115s pod/chi-ClickHouse-replicas-2-1-0 2/2 Running 0 48s pod/zk-clickhouse-cluster-0 1/1 Running 0 3m13s pod/zk-clickhouse-cluster-1 1/1 Running 0 3m13s pod/zk-clickhouse-cluster-2 1/1 Running 0 3m13s # 查看 SVC 运行状态 $ kubectl get service -n test NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE service/chi-ClickHouse-replicas-0-0 ClusterIP None8123/TCP,9000/TCP,9009/TCP 2m53s service/chi-ClickHouse-replicas-0-1 ClusterIP None 8123/TCP,9000/TCP,9009/TCP 2m36s service/chi-ClickHouse-replicas-1-0 ClusterIP None 8123/TCP,9000/TCP,9009/TCP 2m19s service/chi-ClickHouse-replicas-1-1 ClusterIP None 8123/TCP,9000/TCP,9009/TCP 117s service/chi-ClickHouse-replicas-2-0 ClusterIP None 8123/TCP,9000/TCP,9009/TCP 50s service/chi-ClickHouse-replicas-2-1 ClusterIP None 8123/TCP,9000/TCP,9009/TCP 13s service/clickhouse-ClickHouse ClusterIP 10.96.137.152 8123/TCP,9000/TCP 3m14s service/zk-client-clickhouse-cluster ClusterIP 10.107.33.51 2181/TCP,7000/TCP 3m13s service/zk-server-clickhouse-cluster ClusterIP None 2888/TCP,3888/TCP 3m13s

至此 ,通过 Helm 方式部署 RadonDB ClickHouse on Kubernetes 集群完毕,可以看到 Helm 部署方式相对更方便和简捷。简化了 CR 部署文件配置过程,无需掌握全部 Kubernetes 的 Yaml 语法和 CR 部署文件各参数含义,可以通过打包应用快速部署。

| 使用 Operator 管理 RadonDB ClickHouse 集群

上面演示了如何使用 Operator 部署 RadonDB ClickHouse 集群,下面我们来验证一下 Operator 管理集群的功能。

添加分片

如果需要给 ClickHouse 添加一个额外的分片应该怎么操作呢?此时只需要修改我们部署的 CR 即可。

$ kubectl get chi -n test NAME CLUSTERS HOSTS STATUS clickhouse 1 6 Completed $ kubectl edit chi/clickhouse -n test

# 这里我们仅截取需要修改的内容

spec:

configuration:

clusters:

- name: "replicas"

layout:

shardsCount: 4 # 将分片改为 4

replicasCount: 2修改成功后,Kubernetes 会将 CR 信息存入

etcd中,而 Operator 则将感知

etcd的变化。当 Operator 获取 CR 变化内容时,将根据 CR 的内容创建对应的 StatefulSet、Service 等相关内容。

下面查看 RadonDB ClickHouse 集群的运行情况,可以看到增加了两个 RadonDB ClickHouse Pod,完成集群分片的增加。

$ kubectl get pods -n test NAME READY STATUS RESTARTS AGE pod/chi-ClickHouse-replicas-0-0-0 1/1 Running 0 14m pod/chi-ClickHouse-replicas-0-1-0 1/1 Running 0 14m pod/chi-ClickHouse-replicas-1-0-0 1/1 Running 0 13m pod/chi-ClickHouse-replicas-1-1-0 1/1 Running 0 13m pod/chi-ClickHouse-replicas-2-0-0 1/1 Running 0 13m pod/chi-ClickHouse-replicas-2-1-0 1/1 Running 0 12m pod/chi-ClickHouse-replicas-3-0-0 1/1 Running 0 102s pod/chi-ClickHouse-replicas-3-1-0 1/1 Running 0 80s

硬盘扩容

同样的,如果需要给 ClickHouse Pods 进行扩容,也只需修改 CR 即可。

$ kubectl get chi -n test NAME CLUSTERS HOSTS STATUS clickhouse 1 8 Completed $ kubectl edit chi/clickhouse -n test

以修改存储容量为 20 Gi 为例。

volumeClaimTemplates:

- name: data

reclaimPolicy: Retain

spec:

accessModes:

- ReadWriteOnce

resources:

requests:

storage: 20Gi 修改成功后,Operator 将自动申请扩容,重建 StatefulSet,并挂载扩容后的硬盘。

通过查看集群的 PVC 挂载情况,可以看到硬盘已经更新为 20Gi 容量。

$ kubectl get pvc -n clickhouse NAME STATUS VOLUME CAPACITY ACCESS MODES data-chi-clickhouse-cluster-all-nodes-0-0-0 Bound pv4 20Gi RWO data-chi-clickhouse-cluster-all-nodes-0-1-0 Bound pv5 20Gi RWO data-chi-clickhouse-cluster-all-nodes-1-0-0 Bound pv7 20Gi RWO data-chi-clickhouse-cluster-all-nodes-1-1-0 Bound pv6 20Gi RWO ...

结语

至此,我们便了解到在 Kubernetes 平台上部署 RadonDB ClickHouse 集群的两种方法,以及 Operator 管理 ClickHouse 集群的基本操作。

下期预告

有关 ClickHouse Operator 项目的更多具体细节、原理、代码架构等。尽请期待……

参考

[1]. RadonDB ClickHouse:https://github.com/radondb/ra...

好了,本文到此结束,带大家了解了《容器化 | ClickHouse on K8s 部署篇【建议收藏】》,希望本文对你有所帮助!关注golang学习网公众号,给大家分享更多数据库知识!

-

499 收藏

-

244 收藏

-

235 收藏

-

157 收藏

-

101 收藏

-

数据库 · MySQL | 3小时前 | 性能优化 · 高并发 · InnoDB · MySQL教程 · 数据库运维 · mysql innodb AUTO_INCREMENT 高并发写入 innodb_autoinc_lock_mode254 收藏

-

数据库 · MySQL | 4小时前 | 连接池 · 高并发 · 故障排查 · MySQL教程 · 数据库运维 · mysql 高并发 连接池 max_connections Too many connections491 收藏

-

381 收藏

-

数据库 · MySQL | 23小时前 | 性能优化 · InnoDB · 故障排查 · MySQL教程 · DBA实战 · mysql innodb 性能优化 预热 冷启动 MySQL 8.4 Buffer Pool158 收藏

-

数据库 · MySQL | 23小时前 | binlog · 故障恢复 · 备份恢复 · MySQL教程 · DBA实战 · mysql DBA binlog 备份恢复 mysqlbinlog MySQL 8.4 PITR432 收藏

-

数据库 · MySQL | 1天前 | 字符集 · 故障排查 · MySQL教程 · 索引优化 · 排序规则 · mysql 排序规则 索引优化 utf8mb4 collation MySQL 8.4294 收藏

-

数据库 · MySQL | 1天前 | binlog · 主从复制 · 故障排查 · MySQL教程 · DBA实战 · mysql DBA binlog 主从复制 MySQL 8.4 复制延迟 relay log119 收藏

-

数据库 · MySQL | 1天前 | MySQL教程 · 慢查询治理 · 索引优化 · 分区表 · DBA实战 · mysql 分区表 慢查询 索引优化 MySQL 8.4 partition pruning133 收藏

-

数据库 · MySQL | 1天前 | 高并发 · 故障排查 · MySQL教程 · 事务隔离 · InnoDB锁 · mysql innodb 高并发 锁等待 MySQL 8.4 NOWAIT SKIP LOCKED439 收藏

-

291 收藏

-

数据库 · MySQL | 1天前 | InnoDB · 故障排查 · 生产实践 · MySQL教程 · 事务隔离 · mysql innodb Purge Lag History List 长事务 Undo326 收藏

-

数据库 · MySQL | 2天前 | 性能优化 · 执行计划 · 生产实践 · MySQL教程 · 索引优化 · mysql explain 索引优化 Index Condition Pushdown ICP179 收藏

-

- 前端进阶之JavaScript设计模式

- 设计模式是开发人员在软件开发过程中面临一般问题时的解决方案,代表了最佳的实践。本课程的主打内容包括JS常见设计模式以及具体应用场景,打造一站式知识长龙服务,适合有JS基础的同学学习。

- 立即学习 543次学习

-

- GO语言核心编程课程

- 本课程采用真实案例,全面具体可落地,从理论到实践,一步一步将GO核心编程技术、编程思想、底层实现融会贯通,使学习者贴近时代脉搏,做IT互联网时代的弄潮儿。

- 立即学习 516次学习

-

- 简单聊聊mysql8与网络通信

- 如有问题加微信:Le-studyg;在课程中,我们将首先介绍MySQL8的新特性,包括性能优化、安全增强、新数据类型等,帮助学生快速熟悉MySQL8的最新功能。接着,我们将深入解析MySQL的网络通信机制,包括协议、连接管理、数据传输等,让

- 立即学习 500次学习

-

- JavaScript正则表达式基础与实战

- 在任何一门编程语言中,正则表达式,都是一项重要的知识,它提供了高效的字符串匹配与捕获机制,可以极大的简化程序设计。

- 立即学习 487次学习

-

- 从零制作响应式网站—Grid布局

- 本系列教程将展示从零制作一个假想的网络科技公司官网,分为导航,轮播,关于我们,成功案例,服务流程,团队介绍,数据部分,公司动态,底部信息等内容区块。网站整体采用CSSGrid布局,支持响应式,有流畅过渡和展现动画。

- 立即学习 485次学习