-

需构建双层分析框架、反事实检验模块、财报语义校验层及动态敏感性矩阵,依托Claude将宏观政策量化映射至微观财务指标,确保投资建议逻辑可追溯、结论与证据严格对应。

-

若PDF中嵌入图片无法被Kimi正确识别,需检查是否为扫描件、手动提取图片上传、优化图像参数(如DPI、色彩模式)或使用Kimi内置解析指令逐页分析图像位置与内容。

-

使用Bard优化博客结构可提升可读性与信息传达效率。一、通过指令生成主题大纲,确立引言、章节与结论的层级框架,并按需调整;二、粘贴相邻段落并请求过渡句建议,增强逻辑衔接;三、提交开头段要求更具吸引力的改写,结尾则添加总结与行动号召;四、发送冗长内容请求简化,在保留原意基础上精简字数;五、询问主题关键词,将其自然融入标题与正文,平衡SEO与流畅性。

-

要实现AI卡皮巴拉高保真角色扮演,需五步:一、构建结构化小传;二、部署上下文锚点;三、激活动态记忆链;四、实施情境驱动开场;五、执行分层反馈校准。

-

需双方完成密钥协商、身份验证与信道隔离:一、安装初始化客户端,验证PGP签名并硬编译;二、气隙生成ED25519密钥并语音核验指纹;三、配置单向信道、元数据剥离及Tor隐藏服务;四、启用FS+AutoErase会话、5分钟自动销毁;五、QubesOS隔离运行,TPM2.0封装密钥并关闭推测执行漏洞。

-

用ChatGPT写引流文案的关键在于明确提问和灵活优化。1.标题要吸引点击,可让AI根据关键词生成多个选项激发灵感;2.开头直奔用户痛点,输入提示语让AI写出引发共鸣的开场白;3.钩子制造悬念或提供福利,引导用户继续阅读或行动;4.提问时需明确目标、提供参考例子、多轮优化并设定限制条件,以提升AI输出质量。掌握这些方法,能高效产出高吸引力文案。

-

若已登录Kimi网页版却无法使用Kimi+功能,需通过电脑端左侧导航栏点击“Kimi+”图标进入功能中心,再依次调用PPT助手、学术搜索、翻译通、IT百事通等专属工具。

-

需用英文双引号锁定文案、匹配10:16/16:10比例与Poster/Logo预设、注入字体形态指令、上传参考图引导、批量验证微调,才能在IdeogramAI中精准生成品牌定制字体图像。

-

应启用LaTeX支持、规范插入公式、调用内置题库、导出前校验完整性:一、系统设置中开启MathJaxv3.2+并确保模板含"math:true";二、行内公式用$...$、独立公式用$$...$$;三、智能组卷勾选【含公式】自动注入验证公式;四、导出PDF前启用完整性检测修正错误。

-

若豆包AI反应慢,可尝试切换至基础模式、拆分复杂问题、检查网络与设备性能。首先关闭「深度思考」功能或让其用简洁方式回答以减少推理负担;其次将复杂问题拆分为多个具体小问题依次提问;最后确保网络稳定、关闭后台应用、更新App或改用电脑端操作以提升响应速度。

-

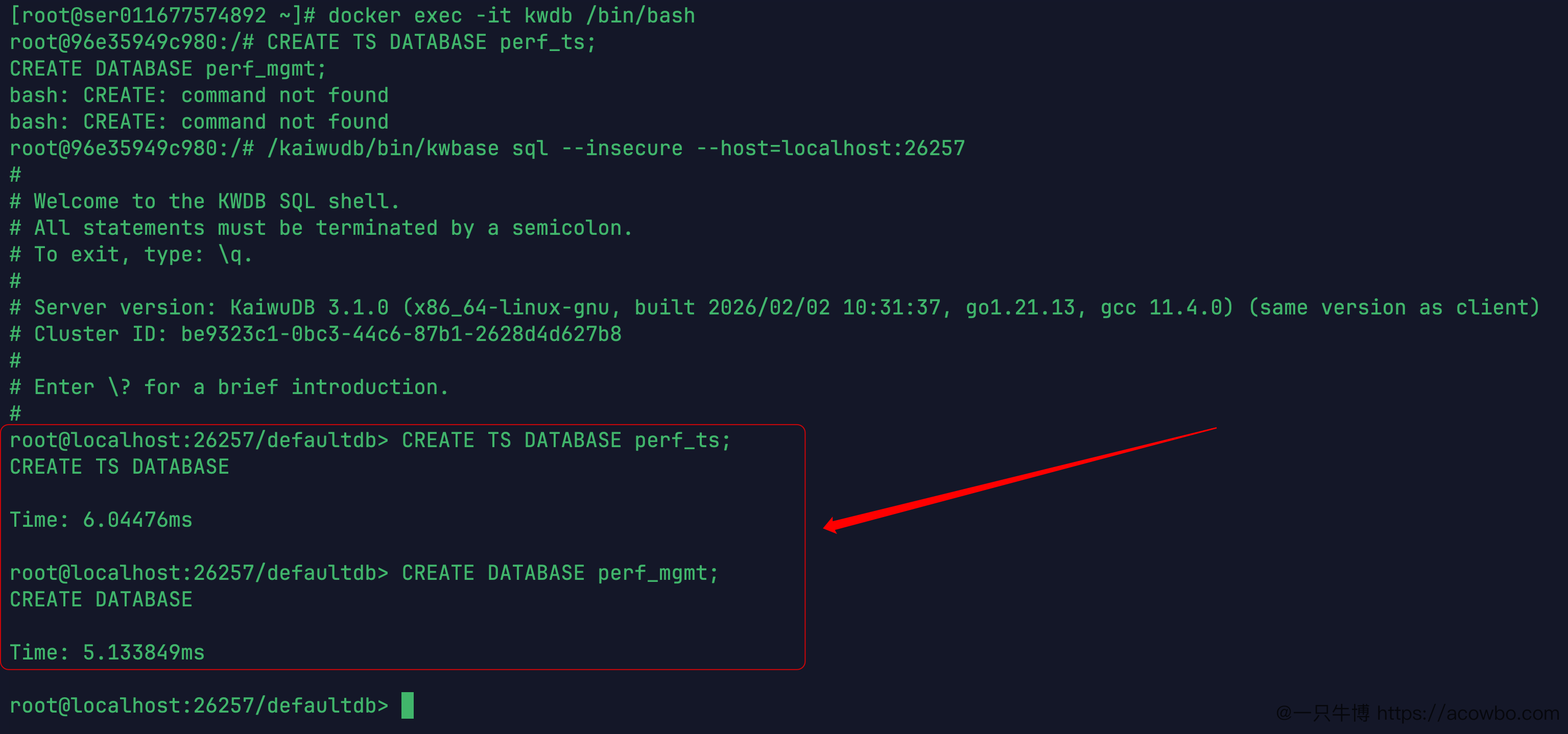

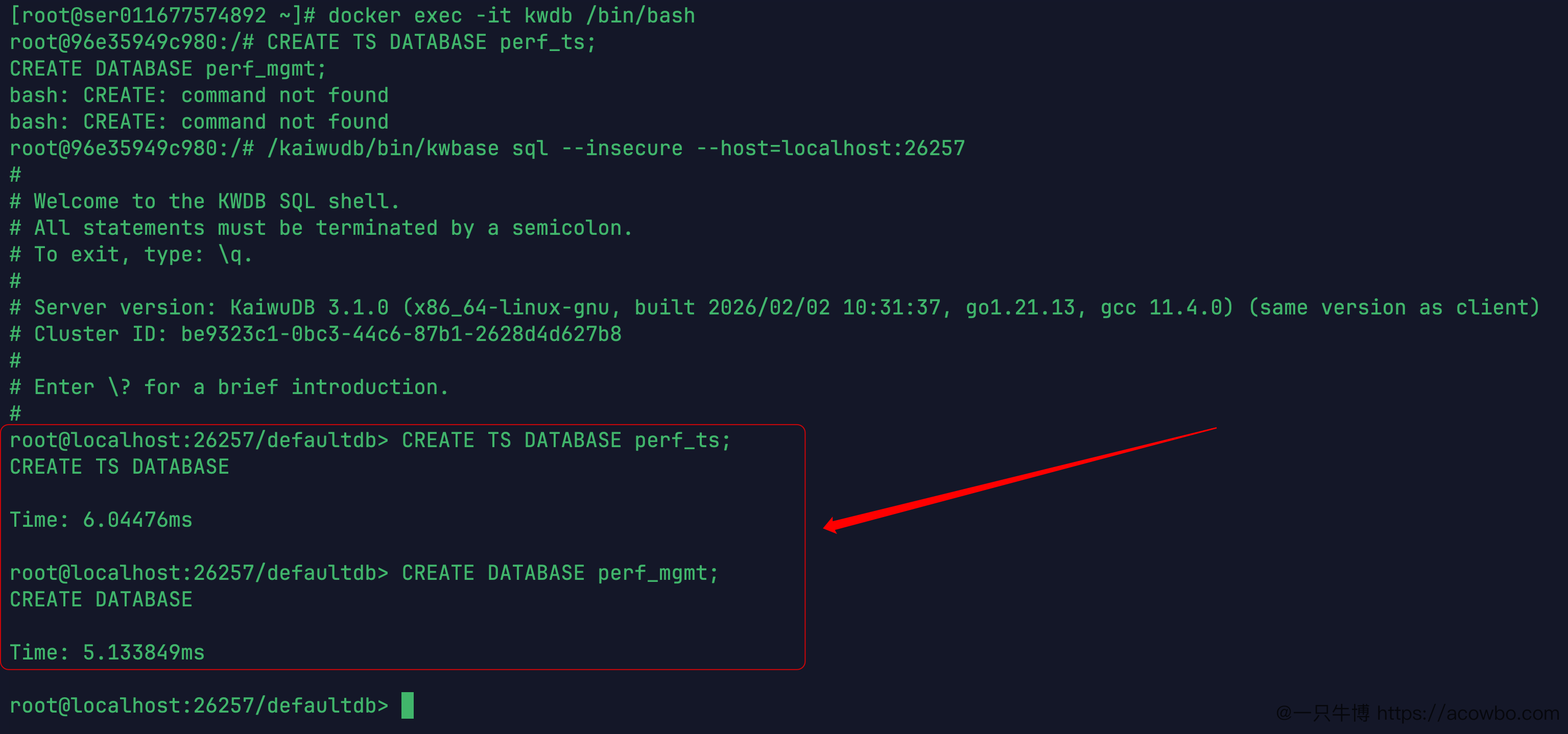

为什么不用benchmark工具做KWDB的性能测试时,首先碰到一个选择:用sysbench、FIO还是KWDB内置的workload工具?考虑了一下,决定都不用。benchmark工具的跑分数字太"漂亮",参数调一调就能高出一大截,对实际工程参考意义有限。我更想知道的是:在接近真实业务场景的情况下,KWDB能跑到什么水平。所以这次的方式是:Python脚本生成传感器测试数据,不同批次大小循环写入,每种重复5次取平均,然后用SQL客户端直接测查询延迟。这是KWDB在正常使

-

MiniMax-M2.5和M2支持本地离线运行,01系列存在隐式联网风险,OpenClaw+MaxClaw为纯云端服务。M2.5采用Apache2.0协议,支持GGUF量化与llama.cpp本地推理;M2可离线部署于A100服务器;01系列依赖动态分块调度与在线CUDA探测;MaxClaw所有计算均在云端完成。

-

AI可快速将文本转为层级化思维导图,方法有三:一、用支持AI生成的在线平台(如XMindZEN)直接解析文本;二、用大模型输出Markdown大纲再导入本地软件;三、调用AIAPI编程批量生成.mm文件。

-

需启用“AI助手直达模式”才能让豆包AI搜索结果页顶部优先显示结构化AI回答。操作包括:一、使用官方最新App(v3.9.2+)或访问doubao.com/search网页端;二、在搜索设置中开启“AI助手直达模式”开关;三、高级用户可通过URL添加mode=ai_direct参数强制激活;四、验证时需确认页面顶部出现带豆包Logo的“AI总结”横幅卡片。

-

需通过海螺AI官网(https://chat.minimaxi.com/)使用Minimax视频大模型,新用户享5次免费生成机会,支持文生视频与图生视频两种方式,严格遵循提示词规范、时长参数及格式要求方可高效产出适配抖音的AI视频。

需构建双层分析框架、反事实检验模块、财报语义校验层及动态敏感性矩阵,依托Claude将宏观政策量化映射至微观财务指标,确保投资建议逻辑可追溯、结论与证据严格对应。259 收藏

需构建双层分析框架、反事实检验模块、财报语义校验层及动态敏感性矩阵,依托Claude将宏观政策量化映射至微观财务指标,确保投资建议逻辑可追溯、结论与证据严格对应。259 收藏 若PDF中嵌入图片无法被Kimi正确识别,需检查是否为扫描件、手动提取图片上传、优化图像参数(如DPI、色彩模式)或使用Kimi内置解析指令逐页分析图像位置与内容。219 收藏

若PDF中嵌入图片无法被Kimi正确识别,需检查是否为扫描件、手动提取图片上传、优化图像参数(如DPI、色彩模式)或使用Kimi内置解析指令逐页分析图像位置与内容。219 收藏 使用Bard优化博客结构可提升可读性与信息传达效率。一、通过指令生成主题大纲,确立引言、章节与结论的层级框架,并按需调整;二、粘贴相邻段落并请求过渡句建议,增强逻辑衔接;三、提交开头段要求更具吸引力的改写,结尾则添加总结与行动号召;四、发送冗长内容请求简化,在保留原意基础上精简字数;五、询问主题关键词,将其自然融入标题与正文,平衡SEO与流畅性。186 收藏

使用Bard优化博客结构可提升可读性与信息传达效率。一、通过指令生成主题大纲,确立引言、章节与结论的层级框架,并按需调整;二、粘贴相邻段落并请求过渡句建议,增强逻辑衔接;三、提交开头段要求更具吸引力的改写,结尾则添加总结与行动号召;四、发送冗长内容请求简化,在保留原意基础上精简字数;五、询问主题关键词,将其自然融入标题与正文,平衡SEO与流畅性。186 收藏 要实现AI卡皮巴拉高保真角色扮演,需五步:一、构建结构化小传;二、部署上下文锚点;三、激活动态记忆链;四、实施情境驱动开场;五、执行分层反馈校准。246 收藏

要实现AI卡皮巴拉高保真角色扮演,需五步:一、构建结构化小传;二、部署上下文锚点;三、激活动态记忆链;四、实施情境驱动开场;五、执行分层反馈校准。246 收藏 需双方完成密钥协商、身份验证与信道隔离:一、安装初始化客户端,验证PGP签名并硬编译;二、气隙生成ED25519密钥并语音核验指纹;三、配置单向信道、元数据剥离及Tor隐藏服务;四、启用FS+AutoErase会话、5分钟自动销毁;五、QubesOS隔离运行,TPM2.0封装密钥并关闭推测执行漏洞。444 收藏

需双方完成密钥协商、身份验证与信道隔离:一、安装初始化客户端,验证PGP签名并硬编译;二、气隙生成ED25519密钥并语音核验指纹;三、配置单向信道、元数据剥离及Tor隐藏服务;四、启用FS+AutoErase会话、5分钟自动销毁;五、QubesOS隔离运行,TPM2.0封装密钥并关闭推测执行漏洞。444 收藏 用ChatGPT写引流文案的关键在于明确提问和灵活优化。1.标题要吸引点击,可让AI根据关键词生成多个选项激发灵感;2.开头直奔用户痛点,输入提示语让AI写出引发共鸣的开场白;3.钩子制造悬念或提供福利,引导用户继续阅读或行动;4.提问时需明确目标、提供参考例子、多轮优化并设定限制条件,以提升AI输出质量。掌握这些方法,能高效产出高吸引力文案。448 收藏

用ChatGPT写引流文案的关键在于明确提问和灵活优化。1.标题要吸引点击,可让AI根据关键词生成多个选项激发灵感;2.开头直奔用户痛点,输入提示语让AI写出引发共鸣的开场白;3.钩子制造悬念或提供福利,引导用户继续阅读或行动;4.提问时需明确目标、提供参考例子、多轮优化并设定限制条件,以提升AI输出质量。掌握这些方法,能高效产出高吸引力文案。448 收藏 若已登录Kimi网页版却无法使用Kimi+功能,需通过电脑端左侧导航栏点击“Kimi+”图标进入功能中心,再依次调用PPT助手、学术搜索、翻译通、IT百事通等专属工具。394 收藏

若已登录Kimi网页版却无法使用Kimi+功能,需通过电脑端左侧导航栏点击“Kimi+”图标进入功能中心,再依次调用PPT助手、学术搜索、翻译通、IT百事通等专属工具。394 收藏 需用英文双引号锁定文案、匹配10:16/16:10比例与Poster/Logo预设、注入字体形态指令、上传参考图引导、批量验证微调,才能在IdeogramAI中精准生成品牌定制字体图像。239 收藏

需用英文双引号锁定文案、匹配10:16/16:10比例与Poster/Logo预设、注入字体形态指令、上传参考图引导、批量验证微调,才能在IdeogramAI中精准生成品牌定制字体图像。239 收藏 应启用LaTeX支持、规范插入公式、调用内置题库、导出前校验完整性:一、系统设置中开启MathJaxv3.2+并确保模板含"math:true";二、行内公式用$...$、独立公式用$$...$$;三、智能组卷勾选【含公式】自动注入验证公式;四、导出PDF前启用完整性检测修正错误。475 收藏

应启用LaTeX支持、规范插入公式、调用内置题库、导出前校验完整性:一、系统设置中开启MathJaxv3.2+并确保模板含"math:true";二、行内公式用$...$、独立公式用$$...$$;三、智能组卷勾选【含公式】自动注入验证公式;四、导出PDF前启用完整性检测修正错误。475 收藏 若豆包AI反应慢,可尝试切换至基础模式、拆分复杂问题、检查网络与设备性能。首先关闭「深度思考」功能或让其用简洁方式回答以减少推理负担;其次将复杂问题拆分为多个具体小问题依次提问;最后确保网络稳定、关闭后台应用、更新App或改用电脑端操作以提升响应速度。151 收藏

若豆包AI反应慢,可尝试切换至基础模式、拆分复杂问题、检查网络与设备性能。首先关闭「深度思考」功能或让其用简洁方式回答以减少推理负担;其次将复杂问题拆分为多个具体小问题依次提问;最后确保网络稳定、关闭后台应用、更新App或改用电脑端操作以提升响应速度。151 收藏 为什么不用benchmark工具做KWDB的性能测试时,首先碰到一个选择:用sysbench、FIO还是KWDB内置的workload工具?考虑了一下,决定都不用。benchmark工具的跑分数字太"漂亮",参数调一调就能高出一大截,对实际工程参考意义有限。我更想知道的是:在接近真实业务场景的情况下,KWDB能跑到什么水平。所以这次的方式是:Python脚本生成传感器测试数据,不同批次大小循环写入,每种重复5次取平均,然后用SQL客户端直接测查询延迟。这是KWDB在正常使250 收藏

为什么不用benchmark工具做KWDB的性能测试时,首先碰到一个选择:用sysbench、FIO还是KWDB内置的workload工具?考虑了一下,决定都不用。benchmark工具的跑分数字太"漂亮",参数调一调就能高出一大截,对实际工程参考意义有限。我更想知道的是:在接近真实业务场景的情况下,KWDB能跑到什么水平。所以这次的方式是:Python脚本生成传感器测试数据,不同批次大小循环写入,每种重复5次取平均,然后用SQL客户端直接测查询延迟。这是KWDB在正常使250 收藏 MiniMax-M2.5和M2支持本地离线运行,01系列存在隐式联网风险,OpenClaw+MaxClaw为纯云端服务。M2.5采用Apache2.0协议,支持GGUF量化与llama.cpp本地推理;M2可离线部署于A100服务器;01系列依赖动态分块调度与在线CUDA探测;MaxClaw所有计算均在云端完成。476 收藏

MiniMax-M2.5和M2支持本地离线运行,01系列存在隐式联网风险,OpenClaw+MaxClaw为纯云端服务。M2.5采用Apache2.0协议,支持GGUF量化与llama.cpp本地推理;M2可离线部署于A100服务器;01系列依赖动态分块调度与在线CUDA探测;MaxClaw所有计算均在云端完成。476 收藏 AI可快速将文本转为层级化思维导图,方法有三:一、用支持AI生成的在线平台(如XMindZEN)直接解析文本;二、用大模型输出Markdown大纲再导入本地软件;三、调用AIAPI编程批量生成.mm文件。271 收藏

AI可快速将文本转为层级化思维导图,方法有三:一、用支持AI生成的在线平台(如XMindZEN)直接解析文本;二、用大模型输出Markdown大纲再导入本地软件;三、调用AIAPI编程批量生成.mm文件。271 收藏 需启用“AI助手直达模式”才能让豆包AI搜索结果页顶部优先显示结构化AI回答。操作包括:一、使用官方最新App(v3.9.2+)或访问doubao.com/search网页端;二、在搜索设置中开启“AI助手直达模式”开关;三、高级用户可通过URL添加mode=ai_direct参数强制激活;四、验证时需确认页面顶部出现带豆包Logo的“AI总结”横幅卡片。311 收藏

需启用“AI助手直达模式”才能让豆包AI搜索结果页顶部优先显示结构化AI回答。操作包括:一、使用官方最新App(v3.9.2+)或访问doubao.com/search网页端;二、在搜索设置中开启“AI助手直达模式”开关;三、高级用户可通过URL添加mode=ai_direct参数强制激活;四、验证时需确认页面顶部出现带豆包Logo的“AI总结”横幅卡片。311 收藏 需通过海螺AI官网(https://chat.minimaxi.com/)使用Minimax视频大模型,新用户享5次免费生成机会,支持文生视频与图生视频两种方式,严格遵循提示词规范、时长参数及格式要求方可高效产出适配抖音的AI视频。102 收藏

需通过海螺AI官网(https://chat.minimaxi.com/)使用Minimax视频大模型,新用户享5次免费生成机会,支持文生视频与图生视频两种方式,严格遵循提示词规范、时长参数及格式要求方可高效产出适配抖音的AI视频。102 收藏