-

要生成强烈吸血鬼气质与哥特氛围的Midjourney图像,需五步协同:一、前置高权重哥特-吸血鬼提示结构;二、启用暗调材质与光影控制参数;三、复用哥特建筑作氛围发生器;四、注入叙事性禁忌符号系统;五、切换至neo-gothic数字虚拟美学子风格。

-

夸克AI可通过五步法高效生成专业产品评测:一、用英文方括号锁定多产品型号实现参数对齐;二、叠加井号限定维度触发主观体验对比;三、长按网页参数表自动生成结构化标签;四、上传PDF/网页由AI提炼关键指标;五、调用写作模板生成结构化报告初稿。

-

tofai实现镜像翻转有五种方法:一、图形界面通过【编辑→变换】菜单或快捷键;二、命令行使用--flip参数;三、Python脚本调用ta.flip()API;四、网页预览中用CSStransform临时显示翻转;五、启用EXIF方向自动校正。

-

可借助蘑兔AI、SunoAI、AmperMusic、POEMRY和灵韵AI五款免费工具高效创作诗歌与歌词:蘑兔AI适配中文语境,零门槛生成自然文本;SunoAI同步输出带演唱的音频与歌词;AmperMusic支持歌词-旋律联动优化;POEMRY专注诗意语言生成;灵韵AI支持图文语音多模态输入。

-

HermesAgent邮件自动化需四步:一、配置并验证IMAP/SMTP连接;二、创建邮件模板并绑定AUTO_REPLY_TEMPLATE_ID;三、启用email事件监听及rules规则;四、可选ClawEmail+OpenClaw或Ollama一键集成。

-

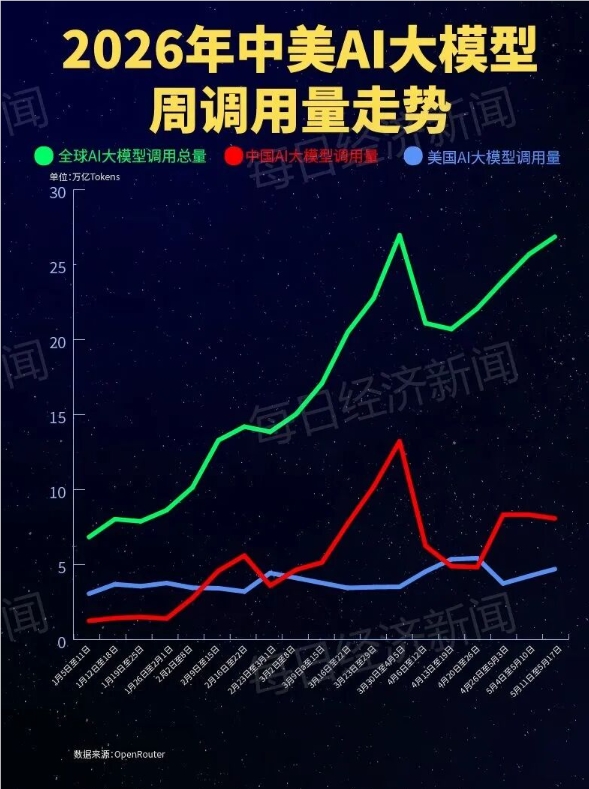

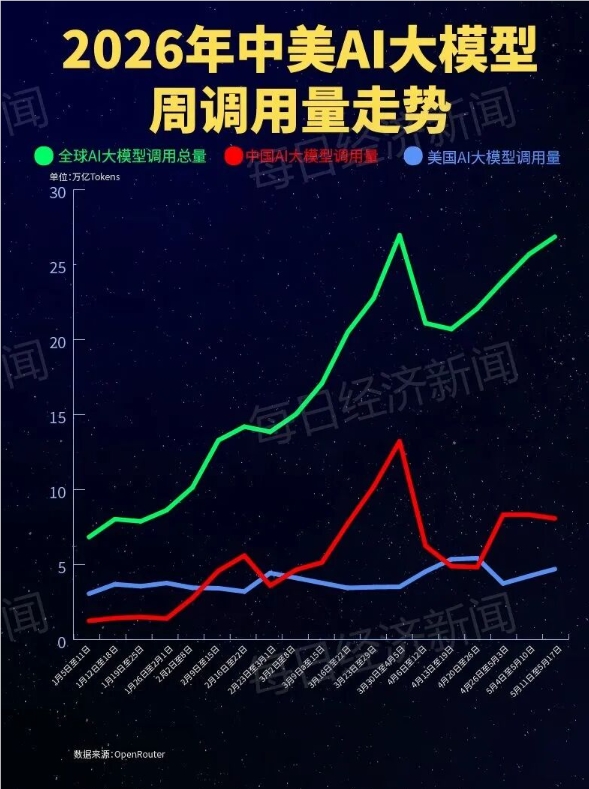

根据第三方数据平台OpenRouter最新统计,全球AI大模型上周总调用量达26.9万亿Token,已连续四周保持增长态势。在全球AI算力部署与实际应用的深度比拼中,中国AI大模型持续领跑,周调用量维持在高位水平。同期,美国AI大模型周调用量虽实现显著环比增长,但中国大模型周调用量已达其1.81倍。这标志着中国大模型已在该指标上连续三周超越美国,稳居全球第一。腾讯Hy3preview强势登顶,成本优势借降价策略加速释放在全榜单调用量TOP3机型中,前两位均由国产大模型包揽。其中,腾讯推出的Hy3pre

-

可灵AI虽无直接“批量生成”按钮,但可通过四类方法实现:一、模板库+变量占位符批量替换;二、外部工具联动生成;三、分组调用历史项目复用;四、接入多模型协同生成管道。

-

豆包AI可生成标准化客服应答模板:一、用预设模板生成四段式基础框架并替换变量;二、上传知识库文档确保应答合规;三、用五要素提示词精准控制输出规格;四、通过变量与同义问法实现多路径复用。

-

QoderWake可作为嵌入现有工作流的数字员工,承担订单调度、异常识别、客户同步等职责:一、以“数字流程专员”接入多平台并自动处理订单;二、以“数字客户经理”监听物流异常并分级响应;三、以“数字分析师”预测运力与时效并输出简报;四、以“数字程序员”监控系统稳定性并辅助修复。

-

若海螺AI搜索结果偏差,需核查搜索源、重构关键词、启用联网增强、交叉比对信源、禁用语义泛化。具体包括切换专用信源、使用四段式关键词、开启实时搜索开关、多源并发验证、添加负向约束与引号强制匹配。

-

豆包AI写作功能入口在官网https://www.doubao.com,点击“写作”标签即可使用论文与公文写作服务。

-

需借助代码覆盖率工具评估测试覆盖程度并识别未测逻辑路径:一、用pytest-cov生成HTML报告;二、启用--cov-branch检测缺失分支;三、结合diff覆盖率聚焦新增代码;四、用mutpy进行变异测试验证测试质量;五、解析coverage.xml提取未覆盖行生成补测建议。

-

需在Midjourney生成阶段嵌入统一几何锚点,中期手动提取对齐形状遮罩,后期用Pika实现轮廓保持的平滑形变,并辅以实拍中介或质检清单确保像素级连续性。

-

QClaw支持四种批量处理机制:一、用模板+CSV批量创建任务;二、通过CLI命令行批量执行任务;三、利用Webhook接收JSON自动分发子任务;四、按标签筛选后批量启停或删除任务。

-

5月17日,据最新消息,苹果公司拟于今年6月召开的全球开发者大会(WWDC)上正式发布首款可独立运行的Siri应用。该应用将深度融合谷歌Gemini大模型技术,打造具备类ChatGPT交互能力的智能对话体验,标志着苹果在人工智能赛道发起新一轮战略升级,力图重塑其AI领域的行业影响力。彭博社资深记者马克·古尔曼(MarkGurman)报道称,隐私安全将成为本次Siri重构的核心理念。为在AI助手竞争中构建独特优势,新版Siri将对用户数据的采集范围、使用方式及留存时长实施更严苛的管控机制。作为关键功能之一

要生成强烈吸血鬼气质与哥特氛围的Midjourney图像,需五步协同:一、前置高权重哥特-吸血鬼提示结构;二、启用暗调材质与光影控制参数;三、复用哥特建筑作氛围发生器;四、注入叙事性禁忌符号系统;五、切换至neo-gothic数字虚拟美学子风格。204 收藏

要生成强烈吸血鬼气质与哥特氛围的Midjourney图像,需五步协同:一、前置高权重哥特-吸血鬼提示结构;二、启用暗调材质与光影控制参数;三、复用哥特建筑作氛围发生器;四、注入叙事性禁忌符号系统;五、切换至neo-gothic数字虚拟美学子风格。204 收藏 夸克AI可通过五步法高效生成专业产品评测:一、用英文方括号锁定多产品型号实现参数对齐;二、叠加井号限定维度触发主观体验对比;三、长按网页参数表自动生成结构化标签;四、上传PDF/网页由AI提炼关键指标;五、调用写作模板生成结构化报告初稿。213 收藏

夸克AI可通过五步法高效生成专业产品评测:一、用英文方括号锁定多产品型号实现参数对齐;二、叠加井号限定维度触发主观体验对比;三、长按网页参数表自动生成结构化标签;四、上传PDF/网页由AI提炼关键指标;五、调用写作模板生成结构化报告初稿。213 收藏 tofai实现镜像翻转有五种方法:一、图形界面通过【编辑→变换】菜单或快捷键;二、命令行使用--flip参数;三、Python脚本调用ta.flip()API;四、网页预览中用CSStransform临时显示翻转;五、启用EXIF方向自动校正。339 收藏

tofai实现镜像翻转有五种方法:一、图形界面通过【编辑→变换】菜单或快捷键;二、命令行使用--flip参数;三、Python脚本调用ta.flip()API;四、网页预览中用CSStransform临时显示翻转;五、启用EXIF方向自动校正。339 收藏 可借助蘑兔AI、SunoAI、AmperMusic、POEMRY和灵韵AI五款免费工具高效创作诗歌与歌词:蘑兔AI适配中文语境,零门槛生成自然文本;SunoAI同步输出带演唱的音频与歌词;AmperMusic支持歌词-旋律联动优化;POEMRY专注诗意语言生成;灵韵AI支持图文语音多模态输入。441 收藏

可借助蘑兔AI、SunoAI、AmperMusic、POEMRY和灵韵AI五款免费工具高效创作诗歌与歌词:蘑兔AI适配中文语境,零门槛生成自然文本;SunoAI同步输出带演唱的音频与歌词;AmperMusic支持歌词-旋律联动优化;POEMRY专注诗意语言生成;灵韵AI支持图文语音多模态输入。441 收藏 HermesAgent邮件自动化需四步:一、配置并验证IMAP/SMTP连接;二、创建邮件模板并绑定AUTO_REPLY_TEMPLATE_ID;三、启用email事件监听及rules规则;四、可选ClawEmail+OpenClaw或Ollama一键集成。400 收藏

HermesAgent邮件自动化需四步:一、配置并验证IMAP/SMTP连接;二、创建邮件模板并绑定AUTO_REPLY_TEMPLATE_ID;三、启用email事件监听及rules规则;四、可选ClawEmail+OpenClaw或Ollama一键集成。400 收藏 根据第三方数据平台OpenRouter最新统计,全球AI大模型上周总调用量达26.9万亿Token,已连续四周保持增长态势。在全球AI算力部署与实际应用的深度比拼中,中国AI大模型持续领跑,周调用量维持在高位水平。同期,美国AI大模型周调用量虽实现显著环比增长,但中国大模型周调用量已达其1.81倍。这标志着中国大模型已在该指标上连续三周超越美国,稳居全球第一。腾讯Hy3preview强势登顶,成本优势借降价策略加速释放在全榜单调用量TOP3机型中,前两位均由国产大模型包揽。其中,腾讯推出的Hy3pre479 收藏

根据第三方数据平台OpenRouter最新统计,全球AI大模型上周总调用量达26.9万亿Token,已连续四周保持增长态势。在全球AI算力部署与实际应用的深度比拼中,中国AI大模型持续领跑,周调用量维持在高位水平。同期,美国AI大模型周调用量虽实现显著环比增长,但中国大模型周调用量已达其1.81倍。这标志着中国大模型已在该指标上连续三周超越美国,稳居全球第一。腾讯Hy3preview强势登顶,成本优势借降价策略加速释放在全榜单调用量TOP3机型中,前两位均由国产大模型包揽。其中,腾讯推出的Hy3pre479 收藏 可灵AI虽无直接“批量生成”按钮,但可通过四类方法实现:一、模板库+变量占位符批量替换;二、外部工具联动生成;三、分组调用历史项目复用;四、接入多模型协同生成管道。282 收藏

可灵AI虽无直接“批量生成”按钮,但可通过四类方法实现:一、模板库+变量占位符批量替换;二、外部工具联动生成;三、分组调用历史项目复用;四、接入多模型协同生成管道。282 收藏 豆包AI可生成标准化客服应答模板:一、用预设模板生成四段式基础框架并替换变量;二、上传知识库文档确保应答合规;三、用五要素提示词精准控制输出规格;四、通过变量与同义问法实现多路径复用。301 收藏

豆包AI可生成标准化客服应答模板:一、用预设模板生成四段式基础框架并替换变量;二、上传知识库文档确保应答合规;三、用五要素提示词精准控制输出规格;四、通过变量与同义问法实现多路径复用。301 收藏 QoderWake可作为嵌入现有工作流的数字员工,承担订单调度、异常识别、客户同步等职责:一、以“数字流程专员”接入多平台并自动处理订单;二、以“数字客户经理”监听物流异常并分级响应;三、以“数字分析师”预测运力与时效并输出简报;四、以“数字程序员”监控系统稳定性并辅助修复。208 收藏

QoderWake可作为嵌入现有工作流的数字员工,承担订单调度、异常识别、客户同步等职责:一、以“数字流程专员”接入多平台并自动处理订单;二、以“数字客户经理”监听物流异常并分级响应;三、以“数字分析师”预测运力与时效并输出简报;四、以“数字程序员”监控系统稳定性并辅助修复。208 收藏 若海螺AI搜索结果偏差,需核查搜索源、重构关键词、启用联网增强、交叉比对信源、禁用语义泛化。具体包括切换专用信源、使用四段式关键词、开启实时搜索开关、多源并发验证、添加负向约束与引号强制匹配。165 收藏

若海螺AI搜索结果偏差,需核查搜索源、重构关键词、启用联网增强、交叉比对信源、禁用语义泛化。具体包括切换专用信源、使用四段式关键词、开启实时搜索开关、多源并发验证、添加负向约束与引号强制匹配。165 收藏 豆包AI写作功能入口在官网https://www.doubao.com,点击“写作”标签即可使用论文与公文写作服务。279 收藏

豆包AI写作功能入口在官网https://www.doubao.com,点击“写作”标签即可使用论文与公文写作服务。279 收藏 需借助代码覆盖率工具评估测试覆盖程度并识别未测逻辑路径:一、用pytest-cov生成HTML报告;二、启用--cov-branch检测缺失分支;三、结合diff覆盖率聚焦新增代码;四、用mutpy进行变异测试验证测试质量;五、解析coverage.xml提取未覆盖行生成补测建议。312 收藏

需借助代码覆盖率工具评估测试覆盖程度并识别未测逻辑路径:一、用pytest-cov生成HTML报告;二、启用--cov-branch检测缺失分支;三、结合diff覆盖率聚焦新增代码;四、用mutpy进行变异测试验证测试质量;五、解析coverage.xml提取未覆盖行生成补测建议。312 收藏 需在Midjourney生成阶段嵌入统一几何锚点,中期手动提取对齐形状遮罩,后期用Pika实现轮廓保持的平滑形变,并辅以实拍中介或质检清单确保像素级连续性。418 收藏

需在Midjourney生成阶段嵌入统一几何锚点,中期手动提取对齐形状遮罩,后期用Pika实现轮廓保持的平滑形变,并辅以实拍中介或质检清单确保像素级连续性。418 收藏 QClaw支持四种批量处理机制:一、用模板+CSV批量创建任务;二、通过CLI命令行批量执行任务;三、利用Webhook接收JSON自动分发子任务;四、按标签筛选后批量启停或删除任务。295 收藏

QClaw支持四种批量处理机制:一、用模板+CSV批量创建任务;二、通过CLI命令行批量执行任务;三、利用Webhook接收JSON自动分发子任务;四、按标签筛选后批量启停或删除任务。295 收藏 5月17日,据最新消息,苹果公司拟于今年6月召开的全球开发者大会(WWDC)上正式发布首款可独立运行的Siri应用。该应用将深度融合谷歌Gemini大模型技术,打造具备类ChatGPT交互能力的智能对话体验,标志着苹果在人工智能赛道发起新一轮战略升级,力图重塑其AI领域的行业影响力。彭博社资深记者马克·古尔曼(MarkGurman)报道称,隐私安全将成为本次Siri重构的核心理念。为在AI助手竞争中构建独特优势,新版Siri将对用户数据的采集范围、使用方式及留存时长实施更严苛的管控机制。作为关键功能之一388 收藏

5月17日,据最新消息,苹果公司拟于今年6月召开的全球开发者大会(WWDC)上正式发布首款可独立运行的Siri应用。该应用将深度融合谷歌Gemini大模型技术,打造具备类ChatGPT交互能力的智能对话体验,标志着苹果在人工智能赛道发起新一轮战略升级,力图重塑其AI领域的行业影响力。彭博社资深记者马克·古尔曼(MarkGurman)报道称,隐私安全将成为本次Siri重构的核心理念。为在AI助手竞争中构建独特优势,新版Siri将对用户数据的采集范围、使用方式及留存时长实施更严苛的管控机制。作为关键功能之一388 收藏