-

神经网络是一种强大的机器学习工具,适用于各种任务,包括数值方程的评估。本文将介绍构建神经网络评估简单数值方程的方法。让我们以一个简单的数值方程为例,如y=x^2。我们的目标是构建一个神经网络,能够输入一个x并预测输出y。第一步是准备数据集。我们需要生成一组输入和输出数据,以便训练神经网络。在这个简单的例子中,我们可以生成一些随机的x值,并计算对应的y值。例如,我们可以生成100个随机的x值,范围从-10到10,并计算对应的y值。这样就得到了一个包含100个输入和输出样本的数据集。在设计神经网络架构时,我们

-

由于技术能力变得越来越重要,数字时代正在改变决策过程。大型语言模型(LLM)是一项值得注意的技术,因其能够在各个领域实现更好的决策而受到赞誉。但LLM能在多大程度上增强决策过程?如果可以,又是如何增强的呢?了解LLM最近的自然语言处理系统,如OpenAI的GPT系列和Google的BERT,都是非常复杂的人工智能程序,它们是在大量文本数据库上进行训练的。这些模型可以理解并输出类似人类的文本,这对于用于自然语言处理来说是一个很大的优势。信息综合LLM的一个主要优势是此类机器可以快速、完美地处理大量信息。LL

-

随着大模型的参数量日益增长,微调整个模型的开销逐渐变得难以接受。因此,北京大学的研究团队提出了一种名为PiSSA的参數高效微调方法,在主流数据集上都超过了目前广泛使用的LoRA的微调效果。论文:PiSSA:PrincipalSingularValuesandSingularVectorsAdaptationofLargeLanguageModels论文链接:https://arxiv.org/pdf/2404.02948.pdf代码链接:https://github.com/GraphPKU/PiSSA图

-

编辑|KX分子描述符的应用与挑战分子描述符广泛应用于分子建模。然而,在AI辅助分子发现领域,缺乏自然适用、完整且原始的分子表征,影响模型性能和可解释性。t-SMILES框架的提出基于片段的多尺度分子表征框架t-SMILES解决分子表征问题。该框架使用SMILES类型的字符串描述分子,支持序列模型作为生成模型。t-SMILES的代码算法t-SMILES具有三种代码算法:TSSA、TSDY和TSID。实验结果实验表明,t-SMILES模型生成分子具有100%理论有效性和高新颖性,优于基于SOTASMILES的

-

不管你来自哪个城市,相信在你的记忆中,都有自己的「家乡话」:吴语柔软细腻、关中方言质朴厚重、四川方言幽默诙谐、粤语古雅潇洒……某种意义上说,方言不只是一种语言习惯,也是一种情感连接、一种文化认同。我们「上网冲浪」遇到的新鲜词汇中,有不少就是来自各地方言。当然,有些时候,方言也是一种交流「壁垒」。在现实生活中,我们经常会看到方言导致的「鸡同鸭讲」,比如这个:如果你关注最近科技圈的动态就会知道,当前的AI语音助手已经能达到「实时回复」的水准,甚至比人类反应还快。而且,AI已经能够充

-

AIxiv专栏是本站发布学术、技术内容的栏目。过去数年,本站AIxiv专栏接收报道了2000多篇内容,覆盖全球各大高校与企业的顶级实验室,有效促进了学术交流与传播。如果您有优秀的工作想要分享,欢迎投稿或者联系报道。投稿邮箱:liyazhou@jiqizhixin.com;zhaoyunfeng@jiqizhixin.com本工作由中科大认知智能全国重点实验室IEEEFellow陈恩红团队与华为诺亚方舟实验室完成。陈恩红教授团队深耕数据挖掘、机器学习领域,在顶级期刊与会议上发表多篇论文,谷歌学术论文引用超两

-

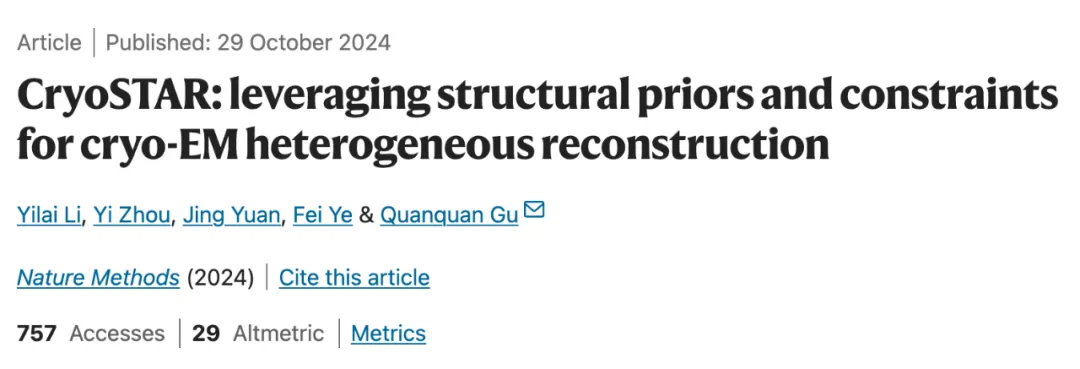

2024年的诺贝尔化学奖颁发给了在结构生物学领域取得重大成就的DavidBaker团队和AlphaFold团队,激发了AIforscience领域新的研究热潮。近两年科学界一个饱受争议的命题是:“AlphaFold是否终结了结构生物学?”首先,AlphaFold之类的结构预测模型的训练数据正是来自于以X射线、冷冻电镜(cryo-EM)等为代表的传统结构解析方法。其次,冷冻电镜技术非常擅长解析蛋白质的动态,而这正是AlphaFold所无法做到的。巧合的是,冷冻电镜这项技术于2017年

-

长春海谱润斯科技股份有限公司(海谱润斯)撤回IPO申请,深交所终止审核。12月3日,深交所发布公告,正式终止对海谱润斯创业板IPO的审核。此前,海谱润斯及其保荐人国金证券已提交申请,撤回上市申请文件。海谱润斯主要从事OLED蒸镀材料的研发、生产、销售及提纯服务,产品涵盖有机和无机材料两大类。其高纯度(4N级别)OLED蒸镀材料是OLED面板发光的核心材料,直接影响面板性能和良品率。公司客户包括京东方、天马集团等国内知名OLED面板厂商,其产品广泛应用于华为、苹果等知名品牌终端设备。尽管海谱润斯在OLED蒸

-

12月3日,丰元股份在接受机构调研时表示,目前公司已建成的磷酸铁锂产能共计22.5万吨,其中部分产能正处于试生产和爬坡阶段。在建磷酸铁锂产能共计7.5万吨,未来公司也会根据行业的发展趋势和下游客户的需求变化,在产能建设实施过程中对规划进行实时调整。丰元股份此前表示,公司正加快布局锂电池正极材料上游产业链,解决资源瓶颈、论证筛选产业链合作机会,巩固核心产业链的紧密性。减少原材料价格波动对公司的不利影响,降低产品生产成本,同时提高公司产品综合性能。优化公司产业布局,推动公司的长远稳健发展。公司对固态电池硫化物

-

南方科技大学深港微电子学院、北京大学东莞光电研究院、香港大学等机构组成的联合研究团队在金刚石薄膜材料领域取得突破性进展,成功研发了一种批量生产大尺寸、超光滑、超柔性金刚石薄膜的创新方法。这项成果具有里程碑意义,将显著推动金刚石薄膜的商业化应用。研究论文已发表于《Nature》期刊,题为“Scalableproductionofultraflatandultraflexiblediamondmembrane”。香港大学景纪祥博士为论文第一作者,南方科技大学李携曦助理教授、北京大学王琦研究员、香港大学林原教授

-

智源研究院提出了BAAIWorm天宝--一个全新的、基于数据驱动的生物智能模拟系统,首次实现秀丽线虫神经系统、身体与环境的闭环仿真。BAAIWorm天宝通过构建线虫的精细神经系统、身体和环境模型,为探索大脑与行为之间的神经机制提供重要研究平台。2024年12月16日,智源研究院理事长黄铁军和生命模拟研究中心马雷等共同关于BAAIWorm天宝的重要进展在国际著名科学期刊《自然·计算科学》(NatureComputationalScience)上发表,并于12月21日被选为期刊封面故事。BAAIWorm天宝的

-

欧盟委员会12月20日宣布,无条件批准英伟达公司收购Run:aiLabs的提议。欧盟委员会认为,该交易不会引发欧洲经济区的竞争问题。英伟达和Run:ai于今年4月底宣布达成交易,但未透露交易价格。Run:ai成立于2018年,致力于帮助企业高效管理和部署其AI工作负载。其核心技术基于深度学习和容器化,能够优化机器学习模型的训练和推理过程。随着人工智能的快速发展,对高性能计算资源的需求也日益增加,Run:ai的技术在这一背景下显得尤为重要。英伟达收购Run:ai后,预计将结合其强大的硬件优势与Run:ai的

-

最新一周汽车销量数据显示,特斯拉ModelY和Model3销量小幅下滑,但其市场地位依然稳固。特斯拉ModelY数据显示,上周ModelY销量为12200辆,Model3销量为5390辆,总销量为17590辆,与前一周相比略有下降。前一周ModelY销量为12870辆,Model3销量为5580辆,总销量为18450辆。尽管如此,特斯拉在中国豪华车市场仍占据重要地位。根据理想汽车公布的12月16日至22日销量排名,特斯拉以1.76万辆的成绩位居第二,仅次于宝马。具体排名如下:宝马:2.04万辆特斯拉:1.

-

比亚迪仰望U7携云辇-Z系统震撼来袭!3月7日,比亚迪正式宣布,其全新智能底盘系统云辇-Z将搭载于即将上市的仰望U7车型。云辇-Z拥有三大核心技术优势:全场景姿态稳定控制、全路面极致舒适平稳以及全数字底盘可OTA升级。仰望U7全球首创“全数字”底盘,并融合了云辇-Z和易四方两大核心技术,实现了横纵垂向控制的全面电动化。新车拥有5265x1998x1517mm的车身尺寸和3160mm的轴距,性能参数更是令人惊叹:1300匹马力,2.9秒零百加速,77次连续弹射无衰减,270km/h极速,33米级10

-

崔东树最新报告:商用车市场增速放缓,新能源逆势增长近日,汽车行业分析师崔东树发布报告,分析了中国商用车市场的最新发展趋势。报告指出,继2021年之前的快速增长后,国内商用车市场已进入低速增长阶段。2025年1月,受春节假期影响,商用车销量同比下降14%,环比下降42%,国内交强险数据显示销量仅为16万辆,创下历史同期新低。2024年全年,国内商用车保险数据显示销量约为285万辆,同比基本持平,反映出市场需求相对稳定。然而,2025年1月的低迷表现,凸显了市场面临的挑战。值得关注的是,新能源商用车

神经网络是一种强大的机器学习工具,适用于各种任务,包括数值方程的评估。本文将介绍构建神经网络评估简单数值方程的方法。让我们以一个简单的数值方程为例,如y=x^2。我们的目标是构建一个神经网络,能够输入一个x并预测输出y。第一步是准备数据集。我们需要生成一组输入和输出数据,以便训练神经网络。在这个简单的例子中,我们可以生成一些随机的x值,并计算对应的y值。例如,我们可以生成100个随机的x值,范围从-10到10,并计算对应的y值。这样就得到了一个包含100个输入和输出样本的数据集。在设计神经网络架构时,我们450 收藏

神经网络是一种强大的机器学习工具,适用于各种任务,包括数值方程的评估。本文将介绍构建神经网络评估简单数值方程的方法。让我们以一个简单的数值方程为例,如y=x^2。我们的目标是构建一个神经网络,能够输入一个x并预测输出y。第一步是准备数据集。我们需要生成一组输入和输出数据,以便训练神经网络。在这个简单的例子中,我们可以生成一些随机的x值,并计算对应的y值。例如,我们可以生成100个随机的x值,范围从-10到10,并计算对应的y值。这样就得到了一个包含100个输入和输出样本的数据集。在设计神经网络架构时,我们450 收藏 由于技术能力变得越来越重要,数字时代正在改变决策过程。大型语言模型(LLM)是一项值得注意的技术,因其能够在各个领域实现更好的决策而受到赞誉。但LLM能在多大程度上增强决策过程?如果可以,又是如何增强的呢?了解LLM最近的自然语言处理系统,如OpenAI的GPT系列和Google的BERT,都是非常复杂的人工智能程序,它们是在大量文本数据库上进行训练的。这些模型可以理解并输出类似人类的文本,这对于用于自然语言处理来说是一个很大的优势。信息综合LLM的一个主要优势是此类机器可以快速、完美地处理大量信息。LL450 收藏

由于技术能力变得越来越重要,数字时代正在改变决策过程。大型语言模型(LLM)是一项值得注意的技术,因其能够在各个领域实现更好的决策而受到赞誉。但LLM能在多大程度上增强决策过程?如果可以,又是如何增强的呢?了解LLM最近的自然语言处理系统,如OpenAI的GPT系列和Google的BERT,都是非常复杂的人工智能程序,它们是在大量文本数据库上进行训练的。这些模型可以理解并输出类似人类的文本,这对于用于自然语言处理来说是一个很大的优势。信息综合LLM的一个主要优势是此类机器可以快速、完美地处理大量信息。LL450 收藏 随着大模型的参数量日益增长,微调整个模型的开销逐渐变得难以接受。因此,北京大学的研究团队提出了一种名为PiSSA的参數高效微调方法,在主流数据集上都超过了目前广泛使用的LoRA的微调效果。论文:PiSSA:PrincipalSingularValuesandSingularVectorsAdaptationofLargeLanguageModels论文链接:https://arxiv.org/pdf/2404.02948.pdf代码链接:https://github.com/GraphPKU/PiSSA图450 收藏

随着大模型的参数量日益增长,微调整个模型的开销逐渐变得难以接受。因此,北京大学的研究团队提出了一种名为PiSSA的参數高效微调方法,在主流数据集上都超过了目前广泛使用的LoRA的微调效果。论文:PiSSA:PrincipalSingularValuesandSingularVectorsAdaptationofLargeLanguageModels论文链接:https://arxiv.org/pdf/2404.02948.pdf代码链接:https://github.com/GraphPKU/PiSSA图450 收藏 编辑|KX分子描述符的应用与挑战分子描述符广泛应用于分子建模。然而,在AI辅助分子发现领域,缺乏自然适用、完整且原始的分子表征,影响模型性能和可解释性。t-SMILES框架的提出基于片段的多尺度分子表征框架t-SMILES解决分子表征问题。该框架使用SMILES类型的字符串描述分子,支持序列模型作为生成模型。t-SMILES的代码算法t-SMILES具有三种代码算法:TSSA、TSDY和TSID。实验结果实验表明,t-SMILES模型生成分子具有100%理论有效性和高新颖性,优于基于SOTASMILES的450 收藏

编辑|KX分子描述符的应用与挑战分子描述符广泛应用于分子建模。然而,在AI辅助分子发现领域,缺乏自然适用、完整且原始的分子表征,影响模型性能和可解释性。t-SMILES框架的提出基于片段的多尺度分子表征框架t-SMILES解决分子表征问题。该框架使用SMILES类型的字符串描述分子,支持序列模型作为生成模型。t-SMILES的代码算法t-SMILES具有三种代码算法:TSSA、TSDY和TSID。实验结果实验表明,t-SMILES模型生成分子具有100%理论有效性和高新颖性,优于基于SOTASMILES的450 收藏 不管你来自哪个城市,相信在你的记忆中,都有自己的「家乡话」:吴语柔软细腻、关中方言质朴厚重、四川方言幽默诙谐、粤语古雅潇洒……某种意义上说,方言不只是一种语言习惯,也是一种情感连接、一种文化认同。我们「上网冲浪」遇到的新鲜词汇中,有不少就是来自各地方言。当然,有些时候,方言也是一种交流「壁垒」。在现实生活中,我们经常会看到方言导致的「鸡同鸭讲」,比如这个:如果你关注最近科技圈的动态就会知道,当前的AI语音助手已经能达到「实时回复」的水准,甚至比人类反应还快。而且,AI已经能够充450 收藏

不管你来自哪个城市,相信在你的记忆中,都有自己的「家乡话」:吴语柔软细腻、关中方言质朴厚重、四川方言幽默诙谐、粤语古雅潇洒……某种意义上说,方言不只是一种语言习惯,也是一种情感连接、一种文化认同。我们「上网冲浪」遇到的新鲜词汇中,有不少就是来自各地方言。当然,有些时候,方言也是一种交流「壁垒」。在现实生活中,我们经常会看到方言导致的「鸡同鸭讲」,比如这个:如果你关注最近科技圈的动态就会知道,当前的AI语音助手已经能达到「实时回复」的水准,甚至比人类反应还快。而且,AI已经能够充450 收藏 AIxiv专栏是本站发布学术、技术内容的栏目。过去数年,本站AIxiv专栏接收报道了2000多篇内容,覆盖全球各大高校与企业的顶级实验室,有效促进了学术交流与传播。如果您有优秀的工作想要分享,欢迎投稿或者联系报道。投稿邮箱:liyazhou@jiqizhixin.com;zhaoyunfeng@jiqizhixin.com本工作由中科大认知智能全国重点实验室IEEEFellow陈恩红团队与华为诺亚方舟实验室完成。陈恩红教授团队深耕数据挖掘、机器学习领域,在顶级期刊与会议上发表多篇论文,谷歌学术论文引用超两450 收藏

AIxiv专栏是本站发布学术、技术内容的栏目。过去数年,本站AIxiv专栏接收报道了2000多篇内容,覆盖全球各大高校与企业的顶级实验室,有效促进了学术交流与传播。如果您有优秀的工作想要分享,欢迎投稿或者联系报道。投稿邮箱:liyazhou@jiqizhixin.com;zhaoyunfeng@jiqizhixin.com本工作由中科大认知智能全国重点实验室IEEEFellow陈恩红团队与华为诺亚方舟实验室完成。陈恩红教授团队深耕数据挖掘、机器学习领域,在顶级期刊与会议上发表多篇论文,谷歌学术论文引用超两450 收藏 2024年的诺贝尔化学奖颁发给了在结构生物学领域取得重大成就的DavidBaker团队和AlphaFold团队,激发了AIforscience领域新的研究热潮。近两年科学界一个饱受争议的命题是:“AlphaFold是否终结了结构生物学?”首先,AlphaFold之类的结构预测模型的训练数据正是来自于以X射线、冷冻电镜(cryo-EM)等为代表的传统结构解析方法。其次,冷冻电镜技术非常擅长解析蛋白质的动态,而这正是AlphaFold所无法做到的。巧合的是,冷冻电镜这项技术于2017年450 收藏

2024年的诺贝尔化学奖颁发给了在结构生物学领域取得重大成就的DavidBaker团队和AlphaFold团队,激发了AIforscience领域新的研究热潮。近两年科学界一个饱受争议的命题是:“AlphaFold是否终结了结构生物学?”首先,AlphaFold之类的结构预测模型的训练数据正是来自于以X射线、冷冻电镜(cryo-EM)等为代表的传统结构解析方法。其次,冷冻电镜技术非常擅长解析蛋白质的动态,而这正是AlphaFold所无法做到的。巧合的是,冷冻电镜这项技术于2017年450 收藏 长春海谱润斯科技股份有限公司(海谱润斯)撤回IPO申请,深交所终止审核。12月3日,深交所发布公告,正式终止对海谱润斯创业板IPO的审核。此前,海谱润斯及其保荐人国金证券已提交申请,撤回上市申请文件。海谱润斯主要从事OLED蒸镀材料的研发、生产、销售及提纯服务,产品涵盖有机和无机材料两大类。其高纯度(4N级别)OLED蒸镀材料是OLED面板发光的核心材料,直接影响面板性能和良品率。公司客户包括京东方、天马集团等国内知名OLED面板厂商,其产品广泛应用于华为、苹果等知名品牌终端设备。尽管海谱润斯在OLED蒸450 收藏

长春海谱润斯科技股份有限公司(海谱润斯)撤回IPO申请,深交所终止审核。12月3日,深交所发布公告,正式终止对海谱润斯创业板IPO的审核。此前,海谱润斯及其保荐人国金证券已提交申请,撤回上市申请文件。海谱润斯主要从事OLED蒸镀材料的研发、生产、销售及提纯服务,产品涵盖有机和无机材料两大类。其高纯度(4N级别)OLED蒸镀材料是OLED面板发光的核心材料,直接影响面板性能和良品率。公司客户包括京东方、天马集团等国内知名OLED面板厂商,其产品广泛应用于华为、苹果等知名品牌终端设备。尽管海谱润斯在OLED蒸450 收藏 12月3日,丰元股份在接受机构调研时表示,目前公司已建成的磷酸铁锂产能共计22.5万吨,其中部分产能正处于试生产和爬坡阶段。在建磷酸铁锂产能共计7.5万吨,未来公司也会根据行业的发展趋势和下游客户的需求变化,在产能建设实施过程中对规划进行实时调整。丰元股份此前表示,公司正加快布局锂电池正极材料上游产业链,解决资源瓶颈、论证筛选产业链合作机会,巩固核心产业链的紧密性。减少原材料价格波动对公司的不利影响,降低产品生产成本,同时提高公司产品综合性能。优化公司产业布局,推动公司的长远稳健发展。公司对固态电池硫化物450 收藏

12月3日,丰元股份在接受机构调研时表示,目前公司已建成的磷酸铁锂产能共计22.5万吨,其中部分产能正处于试生产和爬坡阶段。在建磷酸铁锂产能共计7.5万吨,未来公司也会根据行业的发展趋势和下游客户的需求变化,在产能建设实施过程中对规划进行实时调整。丰元股份此前表示,公司正加快布局锂电池正极材料上游产业链,解决资源瓶颈、论证筛选产业链合作机会,巩固核心产业链的紧密性。减少原材料价格波动对公司的不利影响,降低产品生产成本,同时提高公司产品综合性能。优化公司产业布局,推动公司的长远稳健发展。公司对固态电池硫化物450 收藏 南方科技大学深港微电子学院、北京大学东莞光电研究院、香港大学等机构组成的联合研究团队在金刚石薄膜材料领域取得突破性进展,成功研发了一种批量生产大尺寸、超光滑、超柔性金刚石薄膜的创新方法。这项成果具有里程碑意义,将显著推动金刚石薄膜的商业化应用。研究论文已发表于《Nature》期刊,题为“Scalableproductionofultraflatandultraflexiblediamondmembrane”。香港大学景纪祥博士为论文第一作者,南方科技大学李携曦助理教授、北京大学王琦研究员、香港大学林原教授450 收藏

南方科技大学深港微电子学院、北京大学东莞光电研究院、香港大学等机构组成的联合研究团队在金刚石薄膜材料领域取得突破性进展,成功研发了一种批量生产大尺寸、超光滑、超柔性金刚石薄膜的创新方法。这项成果具有里程碑意义,将显著推动金刚石薄膜的商业化应用。研究论文已发表于《Nature》期刊,题为“Scalableproductionofultraflatandultraflexiblediamondmembrane”。香港大学景纪祥博士为论文第一作者,南方科技大学李携曦助理教授、北京大学王琦研究员、香港大学林原教授450 收藏 智源研究院提出了BAAIWorm天宝--一个全新的、基于数据驱动的生物智能模拟系统,首次实现秀丽线虫神经系统、身体与环境的闭环仿真。BAAIWorm天宝通过构建线虫的精细神经系统、身体和环境模型,为探索大脑与行为之间的神经机制提供重要研究平台。2024年12月16日,智源研究院理事长黄铁军和生命模拟研究中心马雷等共同关于BAAIWorm天宝的重要进展在国际著名科学期刊《自然·计算科学》(NatureComputationalScience)上发表,并于12月21日被选为期刊封面故事。BAAIWorm天宝的450 收藏

智源研究院提出了BAAIWorm天宝--一个全新的、基于数据驱动的生物智能模拟系统,首次实现秀丽线虫神经系统、身体与环境的闭环仿真。BAAIWorm天宝通过构建线虫的精细神经系统、身体和环境模型,为探索大脑与行为之间的神经机制提供重要研究平台。2024年12月16日,智源研究院理事长黄铁军和生命模拟研究中心马雷等共同关于BAAIWorm天宝的重要进展在国际著名科学期刊《自然·计算科学》(NatureComputationalScience)上发表,并于12月21日被选为期刊封面故事。BAAIWorm天宝的450 收藏 欧盟委员会12月20日宣布,无条件批准英伟达公司收购Run:aiLabs的提议。欧盟委员会认为,该交易不会引发欧洲经济区的竞争问题。英伟达和Run:ai于今年4月底宣布达成交易,但未透露交易价格。Run:ai成立于2018年,致力于帮助企业高效管理和部署其AI工作负载。其核心技术基于深度学习和容器化,能够优化机器学习模型的训练和推理过程。随着人工智能的快速发展,对高性能计算资源的需求也日益增加,Run:ai的技术在这一背景下显得尤为重要。英伟达收购Run:ai后,预计将结合其强大的硬件优势与Run:ai的450 收藏

欧盟委员会12月20日宣布,无条件批准英伟达公司收购Run:aiLabs的提议。欧盟委员会认为,该交易不会引发欧洲经济区的竞争问题。英伟达和Run:ai于今年4月底宣布达成交易,但未透露交易价格。Run:ai成立于2018年,致力于帮助企业高效管理和部署其AI工作负载。其核心技术基于深度学习和容器化,能够优化机器学习模型的训练和推理过程。随着人工智能的快速发展,对高性能计算资源的需求也日益增加,Run:ai的技术在这一背景下显得尤为重要。英伟达收购Run:ai后,预计将结合其强大的硬件优势与Run:ai的450 收藏 最新一周汽车销量数据显示,特斯拉ModelY和Model3销量小幅下滑,但其市场地位依然稳固。特斯拉ModelY数据显示,上周ModelY销量为12200辆,Model3销量为5390辆,总销量为17590辆,与前一周相比略有下降。前一周ModelY销量为12870辆,Model3销量为5580辆,总销量为18450辆。尽管如此,特斯拉在中国豪华车市场仍占据重要地位。根据理想汽车公布的12月16日至22日销量排名,特斯拉以1.76万辆的成绩位居第二,仅次于宝马。具体排名如下:宝马:2.04万辆特斯拉:1.450 收藏

最新一周汽车销量数据显示,特斯拉ModelY和Model3销量小幅下滑,但其市场地位依然稳固。特斯拉ModelY数据显示,上周ModelY销量为12200辆,Model3销量为5390辆,总销量为17590辆,与前一周相比略有下降。前一周ModelY销量为12870辆,Model3销量为5580辆,总销量为18450辆。尽管如此,特斯拉在中国豪华车市场仍占据重要地位。根据理想汽车公布的12月16日至22日销量排名,特斯拉以1.76万辆的成绩位居第二,仅次于宝马。具体排名如下:宝马:2.04万辆特斯拉:1.450 收藏 比亚迪仰望U7携云辇-Z系统震撼来袭!3月7日,比亚迪正式宣布,其全新智能底盘系统云辇-Z将搭载于即将上市的仰望U7车型。云辇-Z拥有三大核心技术优势:全场景姿态稳定控制、全路面极致舒适平稳以及全数字底盘可OTA升级。仰望U7全球首创“全数字”底盘,并融合了云辇-Z和易四方两大核心技术,实现了横纵垂向控制的全面电动化。新车拥有5265x1998x1517mm的车身尺寸和3160mm的轴距,性能参数更是令人惊叹:1300匹马力,2.9秒零百加速,77次连续弹射无衰减,270km/h极速,33米级10450 收藏

比亚迪仰望U7携云辇-Z系统震撼来袭!3月7日,比亚迪正式宣布,其全新智能底盘系统云辇-Z将搭载于即将上市的仰望U7车型。云辇-Z拥有三大核心技术优势:全场景姿态稳定控制、全路面极致舒适平稳以及全数字底盘可OTA升级。仰望U7全球首创“全数字”底盘,并融合了云辇-Z和易四方两大核心技术,实现了横纵垂向控制的全面电动化。新车拥有5265x1998x1517mm的车身尺寸和3160mm的轴距,性能参数更是令人惊叹:1300匹马力,2.9秒零百加速,77次连续弹射无衰减,270km/h极速,33米级10450 收藏 崔东树最新报告:商用车市场增速放缓,新能源逆势增长近日,汽车行业分析师崔东树发布报告,分析了中国商用车市场的最新发展趋势。报告指出,继2021年之前的快速增长后,国内商用车市场已进入低速增长阶段。2025年1月,受春节假期影响,商用车销量同比下降14%,环比下降42%,国内交强险数据显示销量仅为16万辆,创下历史同期新低。2024年全年,国内商用车保险数据显示销量约为285万辆,同比基本持平,反映出市场需求相对稳定。然而,2025年1月的低迷表现,凸显了市场面临的挑战。值得关注的是,新能源商用车450 收藏

崔东树最新报告:商用车市场增速放缓,新能源逆势增长近日,汽车行业分析师崔东树发布报告,分析了中国商用车市场的最新发展趋势。报告指出,继2021年之前的快速增长后,国内商用车市场已进入低速增长阶段。2025年1月,受春节假期影响,商用车销量同比下降14%,环比下降42%,国内交强险数据显示销量仅为16万辆,创下历史同期新低。2024年全年,国内商用车保险数据显示销量约为285万辆,同比基本持平,反映出市场需求相对稳定。然而,2025年1月的低迷表现,凸显了市场面临的挑战。值得关注的是,新能源商用车450 收藏