-

文心一言可通过明确岗位与问题类型、使用模板化提示词、结合真实场景调整、批量生成并筛选优化等技巧,高效生成结构清晰、内容实用的面试问题与答案解读。具体操作包括:1.指定岗位名称和问题类型以提升针对性;2.使用统一格式模板提高输出效率;3.结合实际工作场景优化问题与答案;4.批量生成后进行人工筛选与补充。

-

近日,2025年度中国香港特别行政区私家车新车首次登记统计结果正式公布。数据显示,比亚迪以领先特斯拉558辆的成绩位居品牌销量榜首,其中主力车型海狮07EV贡献显著,单款车型销量比ModelY高出636辆。特斯拉ModelY在车型销量TOP20排名中,比亚迪海狮07EV以5680辆的登记量高居第一,荣登香港最热卖车型宝座。特斯拉Model3与ModelY则分别以5044辆和4149辆位列第二、第三位;不过Model3销量同比下滑14.2%,反映出其市场空间正持续受到国产新能源车型的冲击。值得关注

-

在ObservableHQ中构建AI优化桑基图需五步:一、用ml5.js预处理数据并添加置信度;二、基于邻接矩阵与AI模型重排节点降交叉;三、调用LLM微服务生成悬停自然语言解释;四、依分布统计量动态切换带宽映射函数;五、通过用户行为日志闭环反馈优化AI策略。

-

若DeepSeek处理Rust代码不准确,主因是训练数据覆盖不足、类型系统建模弱及宏展开能力受限;需依四步排查:一验输入规范性,二调提示词锚定编译器视角,三用rustc/clippy协同验证,四换Rust专用微调模型比对。

-

豆包AI生成音乐卡点不准的解决方法有四:一、用“视频(音乐版)”功能同步生成音画;二、以“时长+情绪+动作触发”指令生成BGM;三、复用热榜BGM参数模板迁移风格;四、依豆包节拍分析手动校准时间轴。

-

可借助AI工具高效完成市场调研:一、明确目标并生成分析框架;二、多源实时采集清洗数据;三、自动生成用户画像标签体系;四、构建结构化竞品对比矩阵;五、输出岗位定制化AI增强报告。

-

DeepMotion可将人体动作视频转为AI驱动3D动画:一、准备全身入镜、480p以上、正面拍摄的5–15秒MP4/MOV视频;二、登录官网进入Animate3D工作区;三、上传视频并选择内置角色或ReadyPlayerMe头像;四、设置透明背景、Cinematic相机模式、启用阴影、1080p分辨率后生成;五、等待2–4倍时长处理,下载MP4动画。

-

注册豆包账号的步骤包括手机端和网页端两种方式,具体流程如下:1.手机端可通过手机号、抖音或苹果账号注册,输入手机号获取验证码并设置密码即可;2.网页端访问官网doubao.com,选择手机号或第三方登录方式完成注册;3.注册时需注意密码规范、填写真实联系方式、及时填写验证码并确认国家区号;4.如遇问题可切换网络环境或使用找回密码、客服咨询等功能辅助完成。整个过程几分钟即可完成,信息准确是关键。

-

构建高质量提示词需五步:一明确任务目标,二设定角色语境,三提供示例与约束,四分步拆解复杂指令,五迭代优化提示词。

-

使用Kaiber生成生动AI动画需五步优化:一、提示词嵌入连续动词、镜头指令及时序关键词;二、启用首尾帧控制并设插值强度75–85;三、配置非线性时间曲线、奇数时长与24fps输出;四、叠加MotionGrain、LensWarp及动态边缘辉光;五、音频驱动形变与微表情,手动对齐唇形帧。

-

BlueWillow角色定制需结构化提示词:一、按“基础身份+外观细节+风格语境”三层构建;二、用V指令迭代强化关键特征;三、以负向提示词排除干扰;四、通过U/V组合跨图层移植特征;五、调用参数化标签库提升精度。

-

豆包AI生成精准短视频脚本需结构化提示词:一、嵌入镜头语言参数;二、角色扮演分镜师;三、分段验证迭代;四、注入参考样例;五、用符号锚点锁定字段。

-

需用LineArt模型、反向蒸馏、自定义训练、Canvas强化或AI+矢量精修五种方法生成清晰线稿;首选启用LineArtModel并输入“blackandwhitelineart,boldoutlines...”等提示词,调高Contrast与Sharpness,禁用写实增强。

-

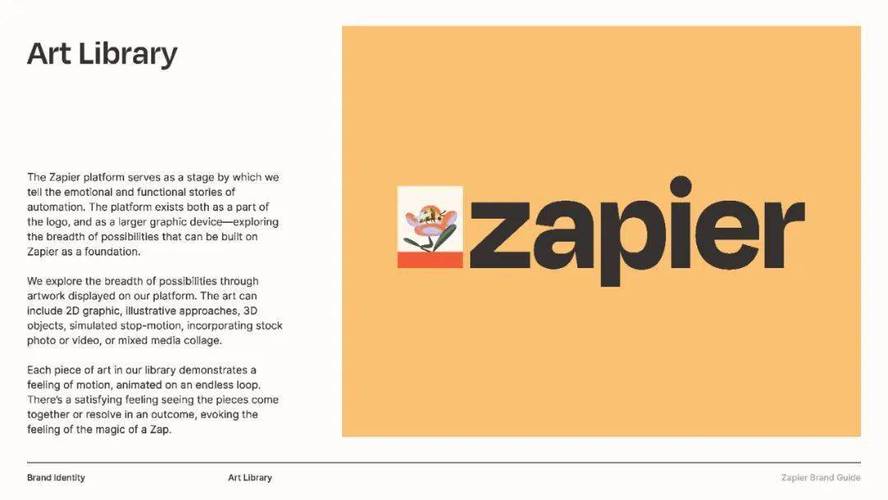

优化Zapier自动化效率需精简步骤、设置过滤条件、启用并发执行、调整触发频率并定期归档非活跃Zap,以提升响应速度与资源利用率。

-

可借助Excel内置“洞察”功能、PowerQuery+AI公式、第三方AI插件及LAMBDA函数四条路径实现零代码交互图表:一、用“分析数据”按钮自动生成可筛选图表;二、用PowerQuery建参数表并以FILTER动态驱动图表;三、安装ChartExpo等插件添加下拉/滑块控件;四、用LAMBDA函数封装图表类型识别逻辑,实现模板自适应。

文心一言可通过明确岗位与问题类型、使用模板化提示词、结合真实场景调整、批量生成并筛选优化等技巧,高效生成结构清晰、内容实用的面试问题与答案解读。具体操作包括:1.指定岗位名称和问题类型以提升针对性;2.使用统一格式模板提高输出效率;3.结合实际工作场景优化问题与答案;4.批量生成后进行人工筛选与补充。107 收藏

文心一言可通过明确岗位与问题类型、使用模板化提示词、结合真实场景调整、批量生成并筛选优化等技巧,高效生成结构清晰、内容实用的面试问题与答案解读。具体操作包括:1.指定岗位名称和问题类型以提升针对性;2.使用统一格式模板提高输出效率;3.结合实际工作场景优化问题与答案;4.批量生成后进行人工筛选与补充。107 收藏 近日,2025年度中国香港特别行政区私家车新车首次登记统计结果正式公布。数据显示,比亚迪以领先特斯拉558辆的成绩位居品牌销量榜首,其中主力车型海狮07EV贡献显著,单款车型销量比ModelY高出636辆。特斯拉ModelY在车型销量TOP20排名中,比亚迪海狮07EV以5680辆的登记量高居第一,荣登香港最热卖车型宝座。特斯拉Model3与ModelY则分别以5044辆和4149辆位列第二、第三位;不过Model3销量同比下滑14.2%,反映出其市场空间正持续受到国产新能源车型的冲击。值得关注356 收藏

近日,2025年度中国香港特别行政区私家车新车首次登记统计结果正式公布。数据显示,比亚迪以领先特斯拉558辆的成绩位居品牌销量榜首,其中主力车型海狮07EV贡献显著,单款车型销量比ModelY高出636辆。特斯拉ModelY在车型销量TOP20排名中,比亚迪海狮07EV以5680辆的登记量高居第一,荣登香港最热卖车型宝座。特斯拉Model3与ModelY则分别以5044辆和4149辆位列第二、第三位;不过Model3销量同比下滑14.2%,反映出其市场空间正持续受到国产新能源车型的冲击。值得关注356 收藏 在ObservableHQ中构建AI优化桑基图需五步:一、用ml5.js预处理数据并添加置信度;二、基于邻接矩阵与AI模型重排节点降交叉;三、调用LLM微服务生成悬停自然语言解释;四、依分布统计量动态切换带宽映射函数;五、通过用户行为日志闭环反馈优化AI策略。285 收藏

在ObservableHQ中构建AI优化桑基图需五步:一、用ml5.js预处理数据并添加置信度;二、基于邻接矩阵与AI模型重排节点降交叉;三、调用LLM微服务生成悬停自然语言解释;四、依分布统计量动态切换带宽映射函数;五、通过用户行为日志闭环反馈优化AI策略。285 收藏 若DeepSeek处理Rust代码不准确,主因是训练数据覆盖不足、类型系统建模弱及宏展开能力受限;需依四步排查:一验输入规范性,二调提示词锚定编译器视角,三用rustc/clippy协同验证,四换Rust专用微调模型比对。340 收藏

若DeepSeek处理Rust代码不准确,主因是训练数据覆盖不足、类型系统建模弱及宏展开能力受限;需依四步排查:一验输入规范性,二调提示词锚定编译器视角,三用rustc/clippy协同验证,四换Rust专用微调模型比对。340 收藏 豆包AI生成音乐卡点不准的解决方法有四:一、用“视频(音乐版)”功能同步生成音画;二、以“时长+情绪+动作触发”指令生成BGM;三、复用热榜BGM参数模板迁移风格;四、依豆包节拍分析手动校准时间轴。126 收藏

豆包AI生成音乐卡点不准的解决方法有四:一、用“视频(音乐版)”功能同步生成音画;二、以“时长+情绪+动作触发”指令生成BGM;三、复用热榜BGM参数模板迁移风格;四、依豆包节拍分析手动校准时间轴。126 收藏 可借助AI工具高效完成市场调研:一、明确目标并生成分析框架;二、多源实时采集清洗数据;三、自动生成用户画像标签体系;四、构建结构化竞品对比矩阵;五、输出岗位定制化AI增强报告。180 收藏

可借助AI工具高效完成市场调研:一、明确目标并生成分析框架;二、多源实时采集清洗数据;三、自动生成用户画像标签体系;四、构建结构化竞品对比矩阵;五、输出岗位定制化AI增强报告。180 收藏 DeepMotion可将人体动作视频转为AI驱动3D动画:一、准备全身入镜、480p以上、正面拍摄的5–15秒MP4/MOV视频;二、登录官网进入Animate3D工作区;三、上传视频并选择内置角色或ReadyPlayerMe头像;四、设置透明背景、Cinematic相机模式、启用阴影、1080p分辨率后生成;五、等待2–4倍时长处理,下载MP4动画。285 收藏

DeepMotion可将人体动作视频转为AI驱动3D动画:一、准备全身入镜、480p以上、正面拍摄的5–15秒MP4/MOV视频;二、登录官网进入Animate3D工作区;三、上传视频并选择内置角色或ReadyPlayerMe头像;四、设置透明背景、Cinematic相机模式、启用阴影、1080p分辨率后生成;五、等待2–4倍时长处理,下载MP4动画。285 收藏 注册豆包账号的步骤包括手机端和网页端两种方式,具体流程如下:1.手机端可通过手机号、抖音或苹果账号注册,输入手机号获取验证码并设置密码即可;2.网页端访问官网doubao.com,选择手机号或第三方登录方式完成注册;3.注册时需注意密码规范、填写真实联系方式、及时填写验证码并确认国家区号;4.如遇问题可切换网络环境或使用找回密码、客服咨询等功能辅助完成。整个过程几分钟即可完成,信息准确是关键。116 收藏

注册豆包账号的步骤包括手机端和网页端两种方式,具体流程如下:1.手机端可通过手机号、抖音或苹果账号注册,输入手机号获取验证码并设置密码即可;2.网页端访问官网doubao.com,选择手机号或第三方登录方式完成注册;3.注册时需注意密码规范、填写真实联系方式、及时填写验证码并确认国家区号;4.如遇问题可切换网络环境或使用找回密码、客服咨询等功能辅助完成。整个过程几分钟即可完成,信息准确是关键。116 收藏 构建高质量提示词需五步:一明确任务目标,二设定角色语境,三提供示例与约束,四分步拆解复杂指令,五迭代优化提示词。205 收藏

构建高质量提示词需五步:一明确任务目标,二设定角色语境,三提供示例与约束,四分步拆解复杂指令,五迭代优化提示词。205 收藏 使用Kaiber生成生动AI动画需五步优化:一、提示词嵌入连续动词、镜头指令及时序关键词;二、启用首尾帧控制并设插值强度75–85;三、配置非线性时间曲线、奇数时长与24fps输出;四、叠加MotionGrain、LensWarp及动态边缘辉光;五、音频驱动形变与微表情,手动对齐唇形帧。460 收藏

使用Kaiber生成生动AI动画需五步优化:一、提示词嵌入连续动词、镜头指令及时序关键词;二、启用首尾帧控制并设插值强度75–85;三、配置非线性时间曲线、奇数时长与24fps输出;四、叠加MotionGrain、LensWarp及动态边缘辉光;五、音频驱动形变与微表情,手动对齐唇形帧。460 收藏 BlueWillow角色定制需结构化提示词:一、按“基础身份+外观细节+风格语境”三层构建;二、用V指令迭代强化关键特征;三、以负向提示词排除干扰;四、通过U/V组合跨图层移植特征;五、调用参数化标签库提升精度。111 收藏

BlueWillow角色定制需结构化提示词:一、按“基础身份+外观细节+风格语境”三层构建;二、用V指令迭代强化关键特征;三、以负向提示词排除干扰;四、通过U/V组合跨图层移植特征;五、调用参数化标签库提升精度。111 收藏 豆包AI生成精准短视频脚本需结构化提示词:一、嵌入镜头语言参数;二、角色扮演分镜师;三、分段验证迭代;四、注入参考样例;五、用符号锚点锁定字段。496 收藏

豆包AI生成精准短视频脚本需结构化提示词:一、嵌入镜头语言参数;二、角色扮演分镜师;三、分段验证迭代;四、注入参考样例;五、用符号锚点锁定字段。496 收藏 需用LineArt模型、反向蒸馏、自定义训练、Canvas强化或AI+矢量精修五种方法生成清晰线稿;首选启用LineArtModel并输入“blackandwhitelineart,boldoutlines...”等提示词,调高Contrast与Sharpness,禁用写实增强。128 收藏

需用LineArt模型、反向蒸馏、自定义训练、Canvas强化或AI+矢量精修五种方法生成清晰线稿;首选启用LineArtModel并输入“blackandwhitelineart,boldoutlines...”等提示词,调高Contrast与Sharpness,禁用写实增强。128 收藏 优化Zapier自动化效率需精简步骤、设置过滤条件、启用并发执行、调整触发频率并定期归档非活跃Zap,以提升响应速度与资源利用率。231 收藏

优化Zapier自动化效率需精简步骤、设置过滤条件、启用并发执行、调整触发频率并定期归档非活跃Zap,以提升响应速度与资源利用率。231 收藏 可借助Excel内置“洞察”功能、PowerQuery+AI公式、第三方AI插件及LAMBDA函数四条路径实现零代码交互图表:一、用“分析数据”按钮自动生成可筛选图表;二、用PowerQuery建参数表并以FILTER动态驱动图表;三、安装ChartExpo等插件添加下拉/滑块控件;四、用LAMBDA函数封装图表类型识别逻辑,实现模板自适应。298 收藏

可借助Excel内置“洞察”功能、PowerQuery+AI公式、第三方AI插件及LAMBDA函数四条路径实现零代码交互图表:一、用“分析数据”按钮自动生成可筛选图表;二、用PowerQuery建参数表并以FILTER动态驱动图表;三、安装ChartExpo等插件添加下拉/滑块控件;四、用LAMBDA函数封装图表类型识别逻辑,实现模板自适应。298 收藏